LingBot-Map:蚂蚁灵波推出的实时流式3D重建AI模型

一、LingBot-Map是什么

LingBot-Map是蚂蚁集团旗下灵波科技(Robbyant)研发的纯自回归流式3D重建基础模型,核心定位是解决“边看边建图”的行业难题,填补实时空间感知领域的关键技术空白。

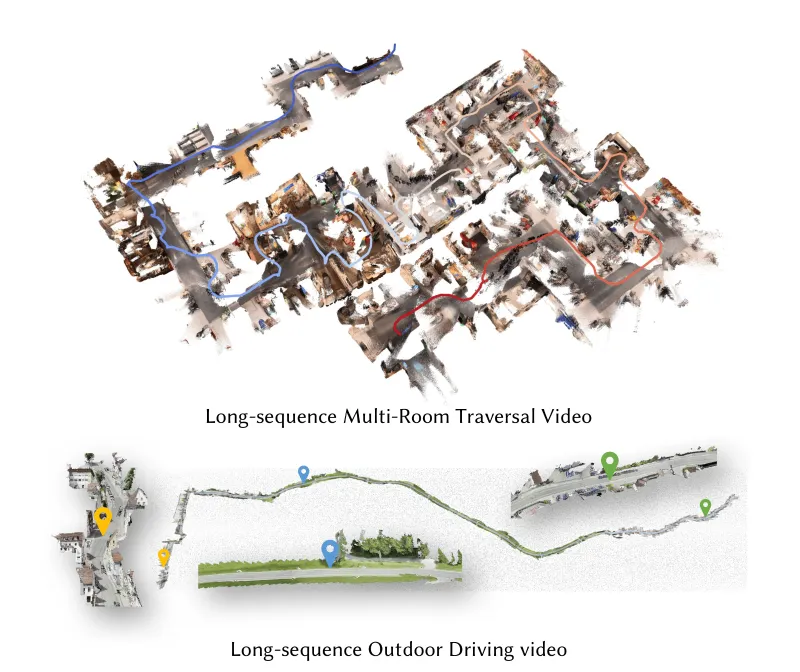

不同于传统3D重建“先采集、后处理”的离线模式,也区别于依赖深度相机、激光雷达(LiDAR)等复杂硬件的方案,LingBot-Map以单普通RGB摄像头为输入,采用纯自回归式建模,在不依赖未来帧信息的前提下,逐帧处理视频流,同步输出精准相机位姿、深度图与高质量3D点云,实时还原场景三维结构,真正实现“所见即所建”。

作为蚂蚁灵波具身智能技术版图的核心一环,LingBot-Map与此前开源的LingBot-Depth(单图深度估计)、LingBot-VLA/VA(具身决策控制)、LingBot-World(世界模型)形成完整技术栈,补齐从空间感知到决策控制的全链路能力,为智能体提供“感知-理解-行动”的统一支撑。

该模型于2026年4月16日正式开源,代码、预训练模型及论文同步发布于GitHub、Hugging Face、ModelScope等平台,采用Apache-2.0开源协议,支持商业与非商业场景自由使用、二次开发。

二、LingBot-Map功能特色

1. 极致硬件极简:单RGB摄像头实现专业级3D重建

无额外硬件依赖:仅需普通消费级RGB摄像头,无需深度相机、激光雷达、IMU等传感器,大幅降低部署成本与硬件门槛。

多源输入兼容:支持本地视频文件、实时摄像头流、网络视频流等多种输入形式,适配手机、相机、嵌入式设备等各类采集终端。

轻量化输出:同步生成三类核心空间数据——6DoF相机位姿(位置+姿态)、逐像素深度图、稠密3D点云,满足不同场景的空间感知需求。

2. 实时高效推理:20FPS万帧稳定,内存近乎恒定

超实时处理速度:在518×378分辨率下,推理速度达19.95FPS(≈20FPS),满足机器人、AR等实时交互场景的帧率要求。

超长序列稳定:支持10,000+帧连续视频处理,长序列运行精度几乎无衰减,解决传统流式重建“越长越不准”的漂移难题。

内存高效管控:采用64帧窗口设计+GCA记忆压缩机制,将历史帧信息压缩为6个极简Token,显存占用仅13.28GB(对比全历史帧方案36.06GB,降低63%),实现近乎恒定内存约束。

3. 行业领先精度:多基准SOTA,超越流式与离线方案

Oxford Spires(大尺度复杂场景):绝对轨迹误差(ATE)仅6.42米,较最优流式方法降低62%(提升2.8倍),显著优于离线方法DA3(12.87米)、VIPE(10.52米)。

ETH3D(高精度室内外场景):重建F1分数达98.98,较第二名提升超21个百分点;AUC@30达86.20,ATE低至0.22。

Tanks and Temples(复杂纹理场景):AUC@30高达92.80,ATE仅0.20,各项指标均为业内最优。

7-Scenes(小规模室内场景):位姿估计与重建质量全面领先现有流式方法,适配小尺度精细空间感知。

4. 纯自回归流式:端到端无优化,真正实时在线

无未来帧依赖:严格遵循流式因果规则,仅利用当前及历史帧信息,不回溯、不依赖后续数据,适配真实在线部署场景。

无测试时优化:摒弃传统SLAM的位姿图优化、Bundle Adjustment等后处理环节,纯前馈推理输出结果,降低延迟与计算开销。

无人工关键帧规则:模型自主学习帧间关联与关键信息筛选,无需手动设计关键帧选取逻辑,适配任意视频序列。

5. 开源开放生态:全栈代码开放,多平台适配

完整开源:核心模型代码、训练脚本、推理Demo、可视化工具、预训练权重全部开源,无功能限制。

多框架兼容:基于PyTorch开发,支持CUDA 11.7+、FlashInfer加速,可部署于云端服务器、边缘计算设备、嵌入式平台。

社区友好:提供详细文档、示例数据、交互式可视化Demo,支持开发者快速上手与二次开发。

三、LingBot-Map技术细节

1. 核心架构:几何上下文Transformer(GCT)

LingBot-Map的核心创新是几何上下文Transformer(Geometric Context Transformer,GCT),以纯自回归范式统一流式3D重建的坐标锚定、几何提取与漂移校正三大核心任务。

(1)三大核心设计模块

锚点上下文(Anchor Context):构建空间几何锚点,实现跨帧坐标统一与场景全局锚定,解决长序列坐标漂移问题。

姿态参考窗口(Pose-Reference Window):维护64帧局部历史窗口,提取密集几何线索与帧间位姿关联,保障短期精度与时序一致性。

轨迹记忆(Trajectory Memory):将超长历史信息压缩为6个记忆Token(相机Token、锚点Token、寄存器Token),结合时间戳位置编码,实现长程记忆与漂移校正。

(2)几何上下文注意力(GCA)机制

GCA是GCT的核心计算单元,突破传统Transformer注意力仅关注语义关联的局限,专门针对几何空间信息优化:

几何感知编码:将像素坐标、深度先验、位姿关系等几何信息嵌入注意力计算,让模型聚焦空间结构而非单纯纹理。

跨帧几何聚合:高效组织时序帧间的几何关联,过滤冗余纹理信息,保留关键空间结构,减少70%+无效计算。

分层空间管理:借鉴SLAM空间分层思路,将全局几何、局部几何、瞬时特征分层处理,平衡精度与效率。

2. 流式推理引擎:Paged KV缓存+FlashInfer加速

为实现实时高效推理,LingBot-Map集成工业级优化引擎:

Paged KV缓存注意力:借鉴大模型分页缓存技术,将注意力键值(KV)分块存储,动态复用历史帧缓存,大幅降低显存占用与计算量。

FlashInfer加速:集成FlashInfer高性能算子,在CUDA平台实现注意力计算的极致优化,推理速度较PyTorch原生SDPA提升3倍+。

双模式兼容:支持FlashInfer加速(推荐)与PyTorch原生SDPA回退模式,适配不同硬件环境。

3. 训练与数据:大规模多场景自监督学习

训练范式:采用自监督学习+弱监督微调,无需海量人工标注3D数据,降低训练成本。

数据集:融合Oxford Spires、ETH3D、Tanks and Temples、7-Scenes等权威公开数据集,覆盖室内、室外、大尺度、小尺度、弱纹理、强光照变化等全场景。

模型规格:提供基础版(lingbot-map)、长序列优化版(lingbot-map-long)、阶段训练版(lingbot-map-stage1)三类预训练模型,适配不同场景。

4. 技术对比:与传统SLAM、学习类方法的差异

| 技术维度 | LingBot-Map | 传统SLAM(ORB-SLAM3/VINS-Mono) | 学习类流式重建(CUT3R/StreamMap) |

|---|---|---|---|

| 核心范式 | 纯自回归学习+几何Transformer | 手工设计+几何优化+闭环检测 | 纯学习+时序建模 |

| 硬件依赖 | 单RGB摄像头 | RGB+IMU/深度/LiDAR | 单RGB/多模态 |

| 实时性 | 20FPS,纯前馈无优化 | 10-15FPS,需后处理优化 | 5-12FPS,显存占用高 |

| 长序列稳定性 | 万帧无漂移,精度恒定 | 易漂移,需闭环校正 | 严重漂移,长序列失效 |

| 场景泛化 | 强,数据驱动泛化 | 弱,依赖人工设计规则 | 中,易过拟合训练场景 |

| 部署难度 | 低,模型一键推理 | 高,需参数调优+硬件适配 | 中,依赖高性能GPU |

四、LingBot-Map应用场景

1. 机器人领域(核心场景)

自主导航与避障:为家用扫地机、商用服务机器人、工业AGV提供实时3D空间地图,实现无碰撞自主移动、动态障碍物规避。

空间理解与操作:助力机械臂、人形机器人感知环境三维结构,完成精准抓取、物体搬运、复杂场景操作。

巡检与测绘:适配管道巡检、厂区巡检、建筑测绘机器人,实时生成高精度3D地图与缺陷检测。

2. AR/VR与元宇宙

AR空间锚定:为AR眼镜、手机AR应用提供稳定6DoF位姿与3D场景重建,实现虚拟物体与真实世界精准叠加。

VR场景构建:快速将真实环境扫描为3D模型,用于VR虚拟场景搭建、数字孪生、沉浸式交互。

3D内容创作:为游戏、影视、动画提供低成本3D场景采集与重建工具,提升内容生产效率。

3. 自动驾驶与智能交通

车载环境感知:辅助自动驾驶系统实现道路、障碍物、行人的3D空间建模,提升复杂路况感知精度。

停车场/园区导航:为低速自动驾驶车辆、无人配送车提供室内外一体化3D地图与定位。

4. 工业与智慧城市

工业三维检测:生产线产品3D尺寸检测、缺陷识别、装配引导,替代传统高精度3D扫描仪。

建筑与施工:建筑工地实时3D测绘、进度监测、安全隐患排查,降低人工测绘成本。

数字孪生:城市街区、园区、楼宇的快速3D建模,支撑智慧城市管理、虚拟仿真。

5. 消费电子与日常应用

手机3D扫描:集成于手机APP,实现物品、房间的一键3D扫描,用于电商建模、家居设计、个人3D内容创作。

无人机测绘:无人机航拍视频实时重建地形、建筑3D模型,用于国土测绘、林业监测、灾害评估。

五、LingBot-Map使用方法

1. 环境部署(Conda+PyTorch)

(1)创建并激活虚拟环境

# 创建Python 3.10环境 conda create -n lingbot-map python=3.10 -y # 激活环境 conda activate lingbot-map

(2)安装核心依赖(CUDA 12.8推荐)

# 安装PyTorch(适配CUDA 12.8) pip install torch==2.9.1 torchvision==0.24.1 --index-url https://download.pytorch.org/whl/cu128 # 安装项目依赖 pip install -e . # 可选:安装FlashInfer加速(强烈推荐,提升3倍速度) pip install flashinfer-python -i https://flashinfer.ai/whl/cu128/torch2.9/ # 可选:安装可视化依赖(用于3D点云、轨迹可视化) pip install -e ".[vis]"

2. 预训练模型下载

从Hugging Face或ModelScope下载预训练权重,推荐lingbot-map(平衡版)或lingbot-map-long(长序列优化):

Hugging Face:https://huggingface.co/robbyant/lingbot-map

ModelScope:https://www.modelscope.cn/models/Robbyant/lingbot-map

下载后将权重文件(如lingbot-map.pt)存放至项目checkpoints/目录。

3. 快速运行Demo(示例场景)

项目提供demo.py交互式脚本,支持本地视频/摄像头流推理+浏览器3D可视化(默认端口8080):

(1)运行示例场景(Church教堂)

python demo.py \ --model_path checkpoints/lingbot-map.pt \ --image_folder example/church \ --mask_sky \ --port 8080

(2)参数说明

--model_path:预训练模型权重路径--image_folder:输入图片序列/视频帧目录--mask_sky:启用天空掩码(提升室外场景精度)--port:可视化服务端口--use_sdpa:禁用FlashInfer,使用PyTorch原生SDPA(无FlashInfer时启用)

(3)实时摄像头推理

python demo.py \ --model_path checkpoints/lingbot-map.pt \ --camera 0 \ --img_size 518 378 \ --port 8080

运行后访问http://localhost:8080即可查看实时3D重建结果(点云、相机轨迹、深度图)。

4. 自定义数据推理

(1)准备数据

图片序列:按帧序命名的RGB图片(如

frame_00001.jpg)视频文件:支持MP4/AVI等格式,需先转为帧序列

(2)执行推理

python demo.py \ --model_path checkpoints/lingbot-map-long.pt \ --image_folder /path/to/your/data \ --output_dir /path/to/output \ --save_pcd \ --save_pose

--output_dir:结果输出目录--save_pcd:保存3D点云(.pcd格式)--save_pose:保存相机位姿(.txt格式)

5. 二次开发与集成

核心推理接口简洁,可快速集成至自有项目:

from lingbot_map.models import LingBotMap

# 加载模型

model = LingBotMap.from_pretrained("checkpoints/lingbot-map.pt")

model.eval()

# 单帧推理(RGB图像:numpy数组/HWC格式)

import cv2

img = cv2.imread("frame.jpg")

pose, depth, pcd = model.inference(img)

# 输出结果

print("相机6DoF位姿:", pose) # (4,4)变换矩阵

print("深度图形状:", depth.shape) # (H,W)

print("3D点云数量:", len(pcd)) # N个3D点六、LingBot-Map竞品对比

选取传统SLAM代表(ORB-SLAM3)、学习类流式方法(CUT3R)、新兴流式方案(LongStream)三类主流竞品,从核心能力、性能、适用场景等维度全面对比:

| 对比维度 | LingBot-Map | ORB-SLAM3(传统SLAM) | CUT3R(学习类流式) | LongStream(新兴流式) |

|---|---|---|---|---|

| 开发主体 | 蚂蚁灵波科技(Robbyant) | 西班牙萨拉戈萨大学 | 斯坦福大学+NVIDIA | 香港科技大学(广州)+地平线 |

| 开源时间 | 2026年4月 | 2021年 | 2025年 | 2026年3月 |

| 核心技术 | 几何上下文Transformer(GCT)+GCA注意力 | 特征点法+位姿图优化+闭环检测 | 循环神经网络(RNN)+时序注意力 | 长序列自回归+尺度一致性建模 |

| 硬件要求 | 单RGB摄像头 | RGB+IMU(必选),可选深度/LiDAR | 单RGB摄像头 | 单RGB摄像头 |

| 推理速度 | 20FPS(518×378) | 12-15FPS(640×480) | 8-10FPS(518×378) | 18FPS(640×480) |

| 最大序列长度 | 10,000+帧(精度无衰减) | 1,000-2,000帧(需闭环校正) | 500-800帧(严重漂移) | 5,000+帧(稳定) |

| Oxford Spires ATE | 6.42米(最优) | 15.7米 | 17.1米 | 9.8米 |

| ETH3D F1分数 | 98.98%(最优) | 85.2% | 78.5% | 89.3% |

| 显存占用 | 13.28GB(64帧窗口) | 2-3GB(轻量) | 28.5GB(全历史缓存) | 15.7GB(长窗口) |

| 实时优化 | 纯前馈,无测试时优化 | 需实时位姿优化+闭环 | 需后处理深度优化 | 纯前馈,轻度优化 |

| 场景泛化 | 极强(室内外/大尺度/弱纹理) | 中(依赖纹理特征) | 弱(易过拟合) | 强(长序列适配) |

| 部署难度 | 低(一键推理,参数少) | 高(参数调优复杂) | 中(依赖高性能GPU) | 中(长序列配置复杂) |

| 核心优势 | 精度+速度+长稳+极简硬件全面领先 | 成熟稳定,轻量低耗 | 早期学习类流式代表 | 长序列尺度一致性优秀 |

| 适用场景 | 全场景(机器人/AR/自动驾驶/工业) | 室内小场景、无人机 | 实验室研究、短序列应用 | 长序列测绘、大场景重建 |

对比结论:LingBot-Map在精度、速度、长序列稳定性、硬件极简性、场景泛化五大核心维度全面领先竞品,是目前流式3D重建领域唯一实现“全维度最优”的方案,尤其适合对实时性、稳定性、部署成本有严苛要求的工业级与消费级场景。

七、常见问题解答

Q1:LingBot-Map支持哪些硬件平台?

A1:支持x86_64架构(Windows/Linux)、ARM64架构(NVIDIA Jetson、树莓派5);GPU需支持CUDA 11.7+(推荐RTX 3090/4090、A10、A100),无GPU时可CPU推理(速度≈1FPS,仅用于测试)。

Q2:没有FlashInfer会影响使用吗?

A2:不会。可通过--use_sdpa参数启用PyTorch原生SDPA注意力,推理速度会降至6-8FPS,但精度完全一致,适合无FlashInfer环境的测试与开发。

Q3:弱纹理、纯黑/纯白、动态模糊场景下重建效果如何?

A3:相比传统SLAM(完全失效),LingBot-Map通过几何上下文学习具备更强鲁棒性:弱纹理场景精度下降约15%-20%,仍可输出稳定位姿与基础点云;动态模糊场景建议降低帧率(10-15FPS),可保障基本精度。

Q4:如何处理室外强光、逆光、夜晚场景?

A4:启用--mask_sky参数可过滤室外天空干扰,提升强光场景精度;夜晚场景需保证基本光照(≥50lux),模型对低光噪声有一定鲁棒性,过暗场景建议补光后采集。

Q5:3D点云、位姿结果如何导出与后续使用?

A5:通过--save_pcd导出.pcd格式点云(可在MeshLab、CloudCompare、Open3D中查看编辑);通过--save_pose导出TUM格式位姿文件(可用于SLAM评估、轨迹可视化、3D重建后处理)。

Q6:可以训练自定义场景的LingBot-Map模型吗?

A6:可以。项目提供训练脚本与配置文件,支持基于自有数据集微调(需至少10+场景、10万+帧数据),但基础模型训练需大规模算力(A100 8卡×7天),普通开发者推荐直接使用官方预训练模型。

Q7:LingBot-Map与ORB-SLAM3、VINS-Mono等SLAM相比,核心优势是什么?

A7:核心优势有四点——①单RGB摄像头即可运行,无需IMU/深度硬件;②万帧长序列无漂移,精度恒定;③纯前馈推理无优化,延迟更低、实时性更强;④场景泛化性极强,弱纹理、大尺度场景表现碾压传统SLAM。

Q8:商用场景使用LingBot-Map需要授权吗?

A8:无需。项目采用Apache-2.0开源协议,允许商业使用、修改、分发,无需支付授权费用,仅需保留原版权声明即可。

八、相关链接

GitHub代码仓库:https://github.com/Robbyant/lingbot-map

官方论文(arXiv):https://arxiv.org/abs/2604.14141

Hugging Face模型库:https://huggingface.co/robbyant/lingbot-map

ModelScope模型库:https://www.modelscope.cn/models/Robbyant/lingbot-map

九、总结

LingBot-Map作为蚂蚁灵波科技开源的几何上下文Transformer流式3D重建模型,以纯自回归架构、几何上下文注意力、高效记忆压缩三大核心创新,突破了传统流式3D重建在精度、速度、长序列稳定性、硬件依赖间的平衡难题,仅靠单普通RGB摄像头即可实现20FPS实时推理与万帧级稳定高精度3D重建,在Oxford Spires、ETH3D等多项权威基准上全面超越现有流式与离线方法,同时凭借极简硬件、全栈开源、多平台适配的特性,大幅降低了3D空间感知技术的部署门槛与应用成本。该模型不仅补齐了蚂蚁具身智能技术栈的关键一环,更为机器人、AR/VR、自动驾驶、工业检测、智慧城市等领域提供了通用、高效、可靠的实时空间感知基座,推动3D重建技术从实验室走向规模化产业落地,成为当前流式3D重建领域的标杆级开源方案。

版权及免责申明:本文由@dotaai原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/lingbot-map.html