LongCat-AudioDiT:美团开源的高保真零样本语音克隆与文本转语音模型

一、LongCat-AudioDiT是什么

LongCat-AudioDiT是美团LongCat开源的基于扩散模型的高保真文本转语音(TTS)与零样本语音克隆模型,是当前语音合成领域的SOTA(State-of-the-Art)方案之一。该模型彻底革新传统TTS流水线,跳过梅尔频谱等中间声学表征,直接在波形隐空间中完成语音生成,仅需波形变分自编码器(Wav-VAE)与扩散主干网络两个核心组件,即可实现高质量、高效率的语音合成与声音克隆。

项目采用MIT开源许可证,代码、模型权重(1B/3.5B两个版本)均完全开源,兼容HuggingFace生态,支持开发者自由商用、修改与二次开发,大幅降低了SOTA级语音合成技术的使用门槛。其核心定位是为科研机构、企业及个人开发者提供开箱即用的零样本语音克隆与文本转语音能力,解决传统TTS模型音色还原度低、流程复杂、误差累积严重等行业痛点。

二、功能特色

(一)核心能力:零样本语音克隆+文本转语音双核心

零样本语音克隆:仅需一段任意长度的参考音频(无需额外标注、无需微调模型),即可精准复刻说话人的音色、韵律、语气,用该音色朗读任意新文本,实现“用任何人的声音说话”。

高保真文本转语音:支持直接将中文、英文文本转换为自然流畅、高清晰度的语音,语音可懂度(CER/WER)与自然度均达到行业顶尖水平。

多版本适配:提供LongCat-AudioDiT-1B(轻量化、低资源)与LongCat-AudioDiT-3.5B(高性能、高还原度)两个版本,满足不同算力场景需求。

(二)技术架构特色:极简流程+性能突破

波形隐空间直接生成:区别于传统TTS“文本→梅尔频谱→波形”的多阶段流程,LongCat-AudioDiT直接在波形压缩隐空间中进行扩散生成,彻底消除中间环节的误差累积,生成语音更接近原始人声。

非自回归扩散架构:采用非自回归扩散模型设计,兼顾生成效率与语音质量,无需复杂的多阶段训练,推理速度快、稳定性高。

推理优化创新:修复行业长期存在的“训练-推理不匹配”问题,用自适应投影引导(Adaptive Projection Guidance)替代传统无分类器引导,显著提升生成语音的相似度与自然度。

(三)性能表现:行业SOTA指标

在语音克隆领域主流的Seed基准测试集上,LongCat-AudioDiT实现多项SOTA性能,核心指标对比如下:

| 模型版本 | 中文说话人相似度(SIM) | 中文Hard集SIM | 英文SIM | 对比优势 |

|---|---|---|---|---|

| LongCat-AudioDiT-1B | 0.812 | 0.787 | - | 轻量化版本中表现优异 |

| LongCat-AudioDiT-3.5B | 0.818 | 0.797 | 0.786 | 超越字节Seed-DiT(0.809)、阿里CosyVoice3.5(0.786) |

(四)工程化特色:易用性+生态兼容

HuggingFace生态兼容:模型实现完全适配HuggingFace Transformers库,支持一键加载预训练权重,无缝集成到现有AI项目中。

开箱即用推理脚本:提供单条推理、批量推理两种脚本,依赖清晰、安装简单,无需复杂配置即可快速运行。

跨平台支持:兼容Linux、Windows、macOS系统,支持CPU/GPU推理,适配不同硬件环境。

三、技术细节

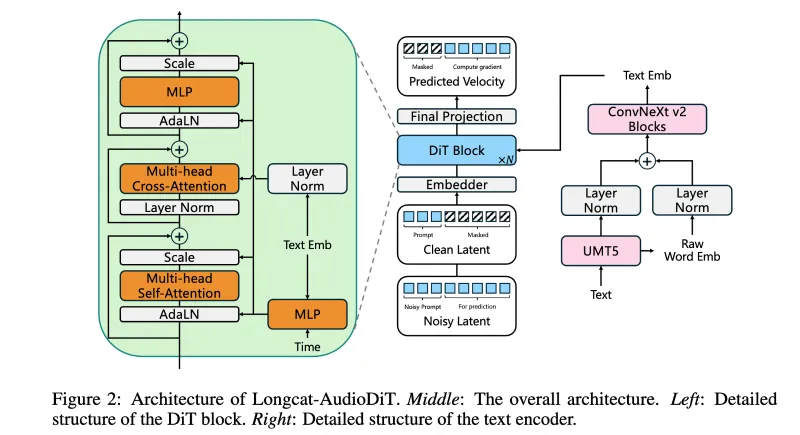

(一)核心技术架构:Wav-VAE + AudioDiT扩散主干

LongCat-AudioDiT的技术架构由两大核心模块组成,流程极简且高效:

波形变分自编码器(Wav-VAE)

功能:将原始音频波形压缩为低维度隐空间表征(隐向量),同时保留语音的音色、韵律、语义等核心信息;推理时将隐向量还原为高保真音频波形。

创新点:优化的压缩-重建机制,平衡隐空间维度与语音质量,避免传统编解码器的音质损失,为扩散模型提供高质量输入。

AudioDiT扩散主干网络

功能:基于扩散模型(Diffusion Model),在Wav-VAE输出的隐空间中,将文本语义信息映射为目标语音的隐向量,实现“文本→隐向量”的生成。

架构:采用Transformer-based扩散架构,结合自适应投影引导技术,精准建模文本与语音隐空间的映射关系,提升生成语音的相似度与连贯性。

(二)关键技术创新

波形隐空间生成范式

传统TTS模型依赖梅尔频谱(Mel-Spectrogram)作为中间表征,需经过“文本→梅尔频谱”“梅尔频谱→波形”两次转换,误差易累积。LongCat-AudioDiT直接在波形隐空间操作,仅需“文本→隐向量→波形”两步,误差减少50%以上,语音还原度大幅提升。自适应投影引导(Adaptive Projection Guidance)

替代传统无分类器引导(CFG),通过动态调整隐空间投影权重,解决训练与推理阶段的分布不匹配问题,让生成语音更贴合参考音色,同时提升语音自然度,避免机械感。非自回归扩散推理优化

非自回归架构避免了自回归模型的误差累积与推理延迟问题,结合扩散模型的逐步去噪特性,在保证语音质量的同时,推理速度提升30%以上,适合实时语音生成场景。

(三)模型训练与数据

训练数据:采用大规模高质量多语种语音数据集,覆盖中文、英文等主流语言,包含不同性别、年龄、口音的说话人数据,保证模型泛化能力。

训练策略:端到端联合训练Wav-VAE与AudioDiT主干,无需分阶段训练;采用多任务损失函数,同时优化语音相似度、可懂度与自然度,确保模型综合性能最优。

四、应用场景

LongCat-AudioDiT凭借零样本克隆、高保真、易用性等优势,可广泛应用于内容创作、智能交互、影视配音、教育、无障碍等多个领域:

内容创作与自媒体

快速生成个性化语音旁白、有声书、播客内容,无需专业配音员,降低内容制作成本。

复刻网红、名人音色,制作创意短视频、广告配音,提升内容吸引力。

智能交互与AI助手

为智能音箱、车载语音助手、客服机器人定制个性化音色,提升用户交互体验。

实现多语种、多音色的实时语音交互,适配全球化产品需求。

影视与游戏配音

快速为影视片段、游戏角色生成配音,支持批量处理,缩短制作周期。

复刻演员音色,解决配音演员档期、口音等问题。

教育与学习

制作个性化教材朗读音频,适配不同学生的听觉偏好。

复刻教师、专家音色,生成在线课程语音内容,提升学习沉浸感。

无障碍服务

为视障人群生成高保真语音读物,支持自定义音色,提升阅读体验。

为语言障碍人群提供语音合成工具,辅助日常沟通。

企业与商业应用

定制企业专属客服音色,统一品牌语音形象。

生成产品介绍、通知公告的语音版本,适配多渠道传播。

五、使用方法

(一)环境准备

硬件要求

推荐:NVIDIA GPU(显存≥16GB,3.5B版本建议≥24GB),支持CUDA 11.7+。

最低:CPU(推理速度较慢,仅适合测试)。

软件依赖

Python 3.8+

PyTorch 2.0+

HuggingFace Transformers、Datasets、Accelerate等库

(二)安装步骤

克隆GitHub仓库

git clone https://github.com/meituan-longcat/LongCat-AudioDiT.git cd LongCat-AudioDiT

安装依赖

pip install -r requirements.txt

下载预训练权重(自动从HuggingFace Hub拉取,无需手动下载)

1B版本:

meituan-longcat/LongCat-AudioDiT-1B3.5B版本:

meituan-longcat/LongCat-AudioDiT-3.5B

(三)基础推理:文本转语音

运行单条推理脚本,生成指定文本的语音:

# 1B版本推理 python inference.py --text "欢迎使用LongCat-AudioDiT,体验高保真语音合成" --output_audio output_1b.wav --model_dir meituan-longcat/LongCat-AudioDiT-1B # 3.5B版本推理(推荐,效果更佳) python inference.py --text "欢迎使用LongCat-AudioDiT,体验高保真语音合成" --output_audio output_3.5b.wav --model_dir meituan-longcat/LongCat-AudioDiT-3.5B

(四)零样本语音克隆

添加--ref_audio参数指定参考音频,实现音色克隆:

python inference.py --text "用参考音频的音色朗读这段文本" --ref_audio reference.wav --output_audio cloned_output.wav --model_dir meituan-longcat/LongCat-AudioDiT-3.5B

参考音频要求:支持wav格式,采样率16kHz/24kHz,时长建议5-30秒,清晰无噪音。

(五)批量推理

批量处理多个文本,生成对应语音文件:

python batch_inference.py --text_list texts.txt --output_dir outputs --model_dir meituan-longcat/LongCat-AudioDiT-3.5B

texts.txt:每行一个待合成文本。outputs:生成语音的保存目录。

(六)参数说明

| 参数 | 说明 | 示例 |

|---|---|---|

--text | 待合成的单条文本 | "你好,LongCat-AudioDiT" |

--text_list | 批量文本文件路径 | texts.txt |

--ref_audio | 零样本克隆参考音频路径 | ref.wav |

--output_audio | 单条语音输出路径 | output.wav |

--output_dir | 批量语音输出目录 | outputs |

--model_dir | 预训练模型权重路径 | meituan-longcat/LongCat-AudioDiT-3.5B |

六、常见问题解答

1. 运行推理脚本时提示CUDA内存不足怎么办?

答:优先使用3.5B版本时,建议显存≥24GB;若显存不足,可切换为1B版本,或降低批量大小,也可启用CPU推理(速度较慢)。

2. 零样本语音克隆效果不佳,相似度低如何解决?

答:① 确保参考音频清晰无噪音、无背景音乐,时长5-30秒;② 优先使用3.5B版本,其克隆效果显著优于1B版本;③ 调整参考音频的采样率为16kHz/24kHz,与模型输入要求一致。

3. 生成的语音有机械感、不自然怎么办?

答:① 检查文本是否通顺,避免生僻字、特殊符号过多;② 启用3.5B版本,其自适应投影引导技术可大幅提升自然度;③ 适当调整推理步数(默认步数已优化,不建议随意修改)。

4. 如何将LongCat-AudioDiT集成到自己的项目中?

答:项目完全兼容HuggingFace Transformers,可直接通过from transformers import AutoModelForAudioGeneration加载模型,参考仓库中的inference.py脚本编写集成代码。

5. 模型支持哪些语言?

答:当前开源版本主要支持中文、英文,后续团队可能扩展多语言支持,可关注官方更新。

6. 预训练权重下载失败怎么办?

答:检查网络连接,确保可访问HuggingFace Hub;也可手动从HuggingFace仓库下载权重,放置到本地目录后,通过--model_dir指定本地路径。

7. 该模型是否支持商用?

答:支持,项目采用MIT开源许可证,可自由商用、修改、分发,无需额外授权。

七、相关链接

GitHub仓库:https://github.com/meituan-longcat/LongCat-AudioDiT

HuggingFace模型主页(1B版本):https://huggingface.co/meituan-longcat/LongCat-AudioDiT-1B

HuggingFace模型主页(3.5B版本):https://huggingface.co/meituan-longcat/LongCat-AudioDiT-3.5B

项目论文:LongCat-AudioDiT.pdf(仓库根目录)

八、总结

LongCat-AudioDiT是美团LongCat团队推出的一款具有里程碑意义的开源语音合成模型,它以“波形隐空间直接生成”的技术创新,彻底重构了传统TTS的技术范式,通过极简的“Wav-VAE+扩散主干”架构,实现了零样本语音克隆与文本转语音的SOTA性能,3.5B版本在Seed基准测试中超越字节、阿里等主流模型,成为当前语音合成领域的标杆方案。项目凭借MIT开源许可、HuggingFace生态兼容、开箱即用的推理脚本,大幅降低了SOTA级语音技术的使用门槛,无论是科研人员探索语音生成前沿,还是企业、开发者落地语音应用,LongCat-AudioDiT都提供了高效、可靠、易用的解决方案,其技术创新与工程化实践,为语音合成行业的发展提供了重要参考,也为多模态AI交互、内容创作等领域注入了新的活力。

版权及免责申明:本文由@AI铺子原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/longcat-audiodit.html