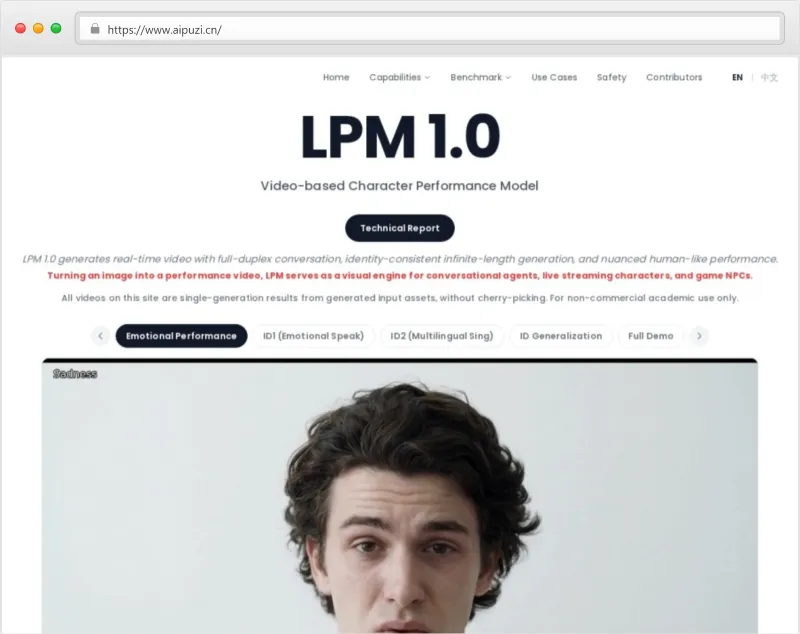

LPM 1.0:专注虚拟角色表演的高性能实时视频生成大模型

一、LPM 1.0是什么

LPM 1.0 全称为 Large Performance Model 1.0,是一款专注于虚拟角色拟人表演与实时视频生成的大模型项目,定位为面向虚拟数字人、对话智能体、虚拟主播、游戏NPC等场景的视觉生成引擎。该模型以单张静态图像为输入基础,无需复杂训练与微调,即可驱动角色完成自然对话、情绪表达、肢体微动作、多语种演唱等拟人化表演,同时支持全双工实时交互与无限时长稳定生成,核心目标是为各类虚拟角色提供高度拟真、身份统一、反应自然的视觉表现能力。

从项目定位来看,LPM 1.0 区别于普通文生视频、图生视频模型,其核心聚焦“表演”而非单纯画面生成,强调角色在对话过程中的倾听、回应、情绪变化、肢体配合等拟人行为,同时兼顾实时性与身份一致性,可作为对话大模型的视觉配套引擎,实现从语音对话到视觉表演的完整闭环。

项目目前定位为非商用学术研究用途,不对外开源代码、不开放API接口、不提供商用授权,所有演示与技术展示均用于学术交流与技术探索,生成内容严格遵循合规规范,禁止用于伪造身份、虚假宣传、冒充真人等违规场景。

二、LPM 1.0功能特色

LPM 1.0 围绕虚拟角色表演构建了完整的功能体系,兼顾生成质量、实时性、可控性与泛化能力,核心功能特色如下:

1. 单图驱动,零样本角色生成

仅需输入单张静态图片,即可驱动生成对应角色的动态表演视频,无需多帧素材、无需3D建模、无需微调训练。

支持写实人像、2D动漫角色、3D模型、非人生物等多种风格主体,具备极强的跨风格泛化能力。

2. 全双工实时对话表演

支持角色倾听、说话、静默三种状态智能切换,倾听时伴随点头、眼神移动、挑眉等自然反应,说话时精准唇形同步,静默时保持自然待机姿态。

实现实时端到端视频生成,可与语音对话模型联动,形成可面对面交互的虚拟对话角色。

3. 无限时长稳定生成

采用流式推理架构,突破传统视频生成的时长限制,支持数小时以上连续生成,且全程保持角色外观、身份、动作风格高度统一。

有效避免画面崩坏、角色变形、身份漂移等常见生成问题,保障长时交互稳定性。

4. 多模态精细可控

支持文本、音频、图像三类控制信号,可通过文本指令控制情绪,通过音频驱动唇形与节奏,通过参考图像约束角色外观。

可精准控制角色情绪类型、强度、微表情变化,支持悲伤、愤怒、愉悦、疑惑、惊讶等数十种情绪表达。

5. 多语种演唱与节奏匹配

支持中英文等多语种歌曲演唱生成,口型、呼吸节奏、肢体动作与旋律、歌词精准对齐。

可应对快节奏歌词、高音、转音等复杂演唱场景,具备较强的节奏把控能力。

6. 身份保真与角色一致性

通过多粒度身份约束机制,保障角色全局外观、面部特征、身体比例在生成过程中不发生偏离,杜绝模型无意义脑补与变形。

同一角色在不同动作、不同情绪、不同时长下保持统一视觉形象,适用于长期虚拟直播、剧情演绎等场景。

为更清晰展示核心功能与同类模型的差异,以下通过表格对比LPM 1.0核心能力维度:

| 能力维度 | LPM 1.0 | 普通图生视频模型 | 传统数字人方案 |

|---|---|---|---|

| 输入素材 | 单张图像 | 单图/多图/文本 | 3D模型/绑定骨骼 |

| 实时性 | 实时流式生成 | 多数离线渲染 | 实时渲染 |

| 对话交互 | 全双工拟人交互 | 无对话逻辑 | 需配合驱动系统 |

| 训练成本 | 零微调 | 部分需微调 | 高成本建模绑定 |

| 时长限制 | 无限时长稳定生成 | 短片段为主 | 无时长限制 |

| 风格泛化 | 写实/动漫/3D通用 | 以写实为主 | 固定风格 |

三、LPM 1.0技术细节

LPM 1.0 的优异表现依托于一套完整的高性能技术架构,从数据处理、模型结构到推理优化均围绕表演生成设计,核心技术细节如下:

1. 全栈实时视频生成流水线

项目构建了端到端的实时生成流水线,包含数据预处理、特征提取、时序建模、流式解码等模块,通过流水线协同优化,降低推理延迟,实现对话级实时响应。

流水线采用轻量化时序编码结构,在保证画面质量的前提下压缩计算量,使其具备在常规算力环境下运行的潜力。

2. 多粒度身份约束技术

为解决角色漂移问题,LPM 1.0 引入多层级身份约束:

全局外观约束:保持角色整体轮廓、服饰、色调统一;

面部精细约束:锁定五官结构、面部特征,避免表情扭曲;

身体姿态约束:保证肢体比例合理,动作自然不崩坏。

该机制使模型在长时间生成与复杂动作表演中,始终维持统一的角色形象。

3. 音频-视觉对齐算法

模型内置专用音频特征提取模块,可对输入语音、歌声进行韵律、节奏、音素级解析,并将音频特征与视觉唇形、面部动作、肢体律动精准绑定,实现音画高度同步,避免口型滞后或错位。

4. 情绪解耦与微表情生成

LPM 1.0 对情绪特征进行解耦建模,将情绪类型、强度、过渡状态独立控制,可生成细腻的微表情,而非夸张僵硬的面部变化,更贴近人类真实情绪表达习惯。

5. 流式推理与状态记忆机制

采用流式推理架构,逐帧生成并保留历史状态信息,既保证生成延迟可控,又能让角色动作连贯自然,不会出现帧间跳跃、动作断裂等问题,同时支撑无限时长连续生成。

6. 多风格统一生成 backbone

模型主干网络支持跨域风格建模,可同时适配真人、二次元、卡通、3D 等不同主体类型,无需针对单一风格重新训练,提升模型通用性与落地灵活性。

以下通过表格梳理核心技术模块与作用:

| 技术模块 | 核心作用 |

|---|---|

| 多粒度身份约束 | 防止角色漂移,保证身份统一 |

| 音频特征对齐 | 实现精准唇同步与节奏匹配 |

| 情绪解耦网络 | 精细控制表情与情绪变化 |

| 流式推理引擎 | 实时生成+无限时长支持 |

| 跨风格泛化模块 | 兼容写实、动漫、3D等主体 |

四、LPM 1.0应用场景

LPM 1.0 以其实时表演、单图驱动、拟人自然的特点,可广泛应用于需要虚拟角色视觉呈现的领域,典型场景如下:

1. 虚拟直播与虚拟主播

无需专业动捕设备与3D建模,使用单张形象图即可打造稳定直播的虚拟主播。

支持长时间连续直播,角色情绪、动作自然,可与观众实时互动对话。

2. 智能对话助手与数字人客服

作为语音助手的视觉形态,构建可面对面交流的数字客服,提升交互体验。

适用于政务咨询、金融客服、电商导购等场景,实现标准化、拟人化服务。

3. 游戏NPC与剧情角色

为游戏中的非玩家角色提供实时表演能力,使NPC具备自然表情与对话反应。

支持剧情演绎、任务对话、情感互动,增强游戏沉浸感。

4. 内容创作与短视频生成

快速生成角色对话、演唱、情景剧视频,降低视频制作成本与周期。

适合动漫解说、角色翻唱、短剧创作等内容形式。

5. 教育与科普虚拟讲师

打造虚拟教师、科普讲解员,以生动形象进行知识讲解。

支持多语种表达,适用于线上课程、公益科普、语言教学等场景。

6. 无障碍与陪伴场景

为有需求群体提供视觉化陪伴角色,通过对话与表演提供情绪价值。

可用于心理辅助、老年陪伴、特殊人群交互等正向场景。

五、常见问题解答(FAQ)

LPM 1.0是否对外开放下载或使用?

不开放。LPM 1.0目前仅作为学术研究项目进行技术展示,不提供模型下载、代码开源、API调用、在线体验入口等任何形式的公开使用渠道。

LPM 1.0可以用于商业直播、广告制作吗?

不可以。项目明确限定为非商用研究用途,禁止任何形式的商业使用、二次分发、商用改编与盈利行为。

使用LPM 1.0生成视频是否会侵犯肖像权?

项目官方演示均使用合成数据或公开合规数据集,不使用真实人脸与真实声音。用户若自行使用他人肖像输入,需自行承担肖像权相关法律责任,项目方不承担此类违规使用后果。

LPM 1.0支持本地部署吗?

目前不支持。项目未发布任何可部署的安装包、模型文件与运行环境,普通用户与企业均无法本地部署运行。

LPM 1.0生成的内容可以分辨出是AI生成吗?

当前版本生成视频仍存在一定细节瑕疵,与真实拍摄视频存在可识别差异,项目方也明确不追求完全伪造真人,以合规研究为前提。

LPM 1.0支持哪些语言的对话与演唱?

从官方演示来看,模型主要支持中文与英文的对话、演唱生成,暂未展示其他语种相关能力。

LPM 1.0对硬件算力有要求吗?

作为高性能大模型,LPM 1.0推理需要较高算力支撑,但其具体硬件配置未对外公开,且因不开放使用,暂无标准化配置参考。

六、相关链接

LPM 1.0 项目官方展示页面:https://large-performance-model.github.io/

七、总结

LPM 1.0作为一款聚焦虚拟角色表演的大型实时视频生成模型,以单张图像为驱动核心,实现了全双工对话交互、无限时长稳定生成、多模态精细控制与跨风格泛化表演,在技术架构上通过多粒度身份约束、音频视觉对齐、流式推理等方案解决了角色漂移、音画不同步、时长受限等行业常见问题,其轻量化使用方式与拟人化交互能力使其在虚拟直播、数字客服、游戏NPC、教育科普等场景具备显著应用潜力,同时项目始终坚守非商用学术研究定位,严格规范使用边界,避免违规滥用风险,整体呈现出一款专注表演、注重实时性、强调合规性的专业级AI视觉生成模型特征,也为轻量级虚拟数字人技术发展提供了清晰的研究方向与技术参考。

版权及免责申明:本文由@人工智能研究所原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/lpm-1-0.html