Moonshine Voice:Moonshine-AI开源的端侧实时AI语音识别工具包

一、Moonshine Voice是什么

Moonshine Voice是一款面向端侧/边缘设备研发的开源自动语音识别工具包,由moonshine-ai团队开发并开源,核心定位是解决传统云端语音服务依赖网络、存在隐私泄露风险、调用成本高,以及现有开源语音模型在端侧设备运行卡顿、延迟过高、精度不足等行业痛点。

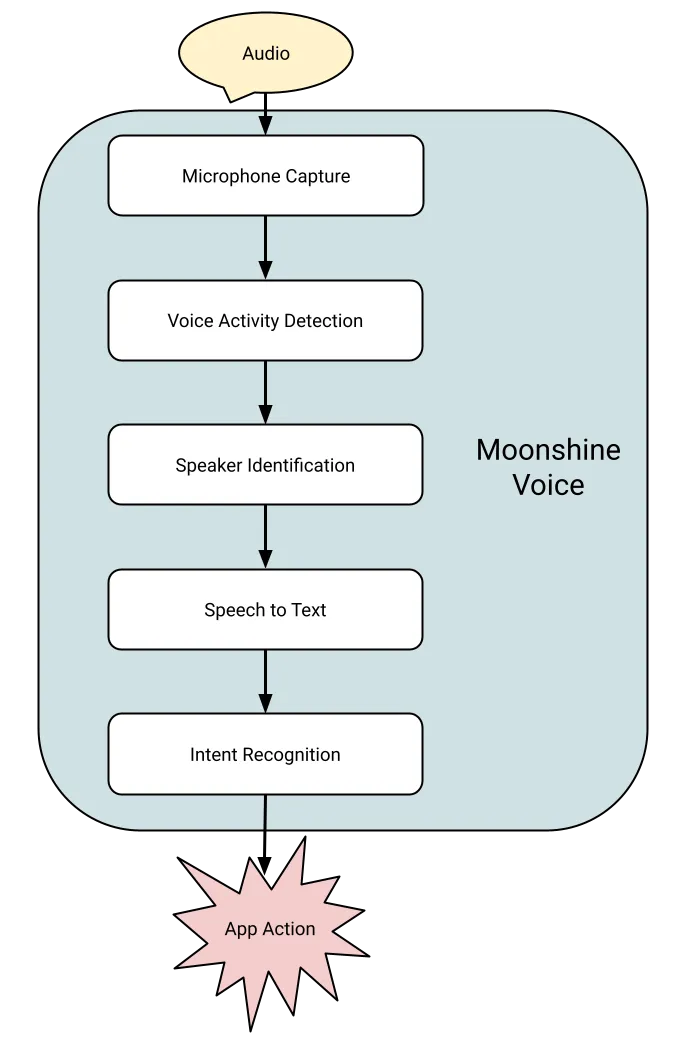

不同于仅能实现基础语音转文本的单一模型,Moonshine Voice是一套全链路端侧语音交互解决方案,底层基于优化后的Transformer架构构建,上层封装了语音活动检测(VAD)、流式实时推理、说话人分割、语音指令意图识别等高阶功能模块,所有音频处理与模型计算均在用户设备本地完成,全程不上传云端、无需联网、无需注册账号、无需申请API密钥,从架构层面实现隐私原生设计。

该项目最具竞争力的核心亮点,是在模型轻量化与识别精度上实现了突破性平衡:其Medium版本模型参数仅2.45亿,远低于Whisper Large V3的15亿参数,但在权威语音识别榜单OpenASR上,词错误率(WER)低至6.65%,优于Whisper Large V3的7.44%,同时推理速度提升数十倍,可在树莓派5这类低算力嵌入式设备上实现稳定实时识别,填补了端侧高精度离线语音识别的市场空白。

从产品定位来看,Moonshine Voice既面向个人开发者快速搭建语音小工具,也支持企业级集成部署,可广泛应用于智能硬件、车载设备、工业终端、办公工具、隐私敏感场景等领域,凭借跨平台兼容性、极简接入方式与商用友好的开源协议,成为当前端侧语音技术领域极具代表性的开源项目。

二、功能特色

1. 纯离线端侧运行,隐私安全无风险

Moonshine Voice所有语音处理逻辑均在用户设备本地执行,音频数据不会离开设备,也无需与云端服务器通信,从根本上杜绝了语音隐私泄露的可能。无论是个人敏感对话、企业会议录音,还是医疗、金融等涉密语音信息,都能在本地完成转录与处理,完全符合数据安全与隐私保护规范,适配无网、弱网、涉密等特殊使用环境。

2. 毫秒级低延迟,实时流式语音识别

项目摒弃了传统ASR模型固定30秒音频填充的低效机制,采用动态音频窗口推理技术,根据实际语音长度按需计算,无冗余运算。在普通PC设备上,Tiny模型识别延迟仅50ms,Medium模型延迟258ms;即便在树莓派5这类低算力硬件上,延迟也可控制在800ms以内,真正实现边说话边转写,满足语音助手、实时字幕、即时指令控制等对延迟要求极高的场景。

3. 多语言全覆盖,口音与嘈杂环境适配

Moonshine Voice官方支持英语、中文、日语、韩语、西班牙语、越南语、乌克兰语、阿拉伯语等8种以上主流语言,针对不同语言的发音特点单独优化模型,对普通话、英语通用口音适配性极佳。同时,模型内置环境噪音滤波与语音增强逻辑,在轻度嘈杂环境下仍能保持高识别准确率,无需额外搭配音频预处理工具。

4. 轻量化模型分级,全硬件平台适配

项目提供三级模型规格,覆盖从超轻量到高精度的全场景需求,最小Tiny模型仅26MB,可轻松部署于各类低算力设备:

分级模型可根据硬件算力自由切换,无需复杂配置;

兼容Windows、macOS、Linux全桌面系统,iOS、Android全移动平台,以及树莓派、IoT模组、车载终端、可穿戴设备等嵌入式硬件;

无需GPU依赖,普通CPU即可流畅运行,高端设备可自动启用硬件加速进一步提升效率。

5. 开箱即用高阶语音能力

除基础语音转文本外,Moonshine Voice内置多项开箱即用的高阶功能,无需额外开发即可使用:

实时麦克风转录:一键调用设备麦克风,实现流式语音转写;

说话人分割:自动识别并区分不同说话人,适配多人会议、对话录音场景;

语音意图识别:内置语义匹配引擎,可直接理解“打开灯光”“播放音乐”等语音指令变体,无需对接大模型;

批量音频处理:支持本地音频文件批量转写,自动导出文本结果,提升办公效率。

6. 商用友好开源协议,降低落地成本

Moonshine Voice采用分层开源许可模式,核心代码与英文模型基于MIT协议开源,可自由修改、分发、商用;多语言模型对年收入低于100万美元的中小企业完全免费商用,仅超大规模企业需申请企业授权,极大降低了语音技术的商用落地成本。同时,项目提供完善的多语言API与示例代码,开发者无需深度学习背景即可快速集成。

三、技术细节

1. 核心模型架构优化

Moonshine Voice基于编码器-解码器Transformer架构重构,针对端侧推理做了深度定制优化:

替换传统绝对位置嵌入为旋转位置嵌入(RoPE),提升长语音序列的特征建模能力,同时减少计算开销;

移除无效音频填充逻辑,采用动态音频分片处理,计算量与语音长度正相关,短指令推理效率大幅提升;

精简注意力机制层数与参数量,采用分层特征提取结构,在保证识别精度的前提下,将模型体积压缩至传统大模型的1/6以下。

2. 推理引擎与底层实现

项目底层核心采用C++编写,兼顾执行效率与跨平台兼容性,上层提供Python、Java、Swift等多语言封装接口:

推理引擎基于ONNX Runtime构建,支持CPU、NPU、GPU自动硬件加速,适配不同设备算力;

内置轻量级语音活动检测(VAD)模块,自动过滤静音片段,减少无效推理,进一步降低延迟;

采用流式推理架构,支持音频流实时分片处理,无需等待完整音频录制完成即可开始识别。

3. 模型规格与性能对比

| 模型版本 | 参数规模 | 词错误率(WER) | PC端推理延迟 | 适用硬件类型 |

|---|---|---|---|---|

| Moonshine Tiny | 3400万 | 12.00% | 50ms | IoT设备、可穿戴、低算力嵌入式硬件 |

| Moonshine Base | 约1亿 | 8.20% | 120ms | 手机、平板、中端嵌入式设备 |

| Moonshine Medium | 2.45亿 | 6.65% | 258ms | PC、高端平板、工业控制设备 |

| Whisper Large V3 | 15亿 | 7.44% | 11286ms | 云端服务器、高性能工作站 |

4. 关键技术创新点

动态音频窗口技术:告别固定时长音频处理,按需推理,短语音速度提升10倍以上;

端侧模型量化压缩:通过INT8量化将模型体积缩减50%,内存占用大幅降低,运行更流畅;

跨平台统一API:一套核心逻辑适配所有平台,开发者无需针对不同系统重复开发;

语音理解一体化:将ASR与意图识别融合,端侧直接完成语音到指令的转换,减少链路损耗。

四、应用场景

1. 智能硬件语音交互

Moonshine Voice轻量化离线特性,使其成为智能硬件的首选语音方案:智能家居设备可实现离线语音控制灯光、空调、窗帘等;车载车机在无网环境下支持语音导航、多媒体操控;智能手表、蓝牙耳机等可穿戴设备,能实现本地语音转录与指令响应,无需依赖手机联网。

2. 办公与内容生产工具

在办公场景中,可基于Moonshine Voice开发离线会议字幕工具,本地实时生成字幕,保护会议隐私;采访、讲座、课程录音可批量转写为文本,无需上传至第三方平台;电脑、手机端可搭建离线语音笔记,边说边记录,提升内容创作效率。

3. 工业与嵌入式终端

工业领域的产线设备、巡检机器人、户外勘探设备,常处于无网或弱网环境,Moonshine Voice可实现本地语音指令控制,避免网络中断导致功能失效;嵌入式工控机、边缘计算盒子搭载该框架,可快速实现语音交互升级,降低硬件改造成本。

4. 隐私敏感行业应用

医疗行业的患者语音病历、法律行业的庭审录音、金融行业的客户语音沟通,均属于高度敏感数据,使用Moonshine Voice本地处理,可避免数据上传云端带来的泄露风险,同时符合医疗数据安全、金融隐私监管等行业规范。

5. 多语言跨境场景

针对出海智能设备、跨境沟通工具,Moonshine Voice支持多语言离线识别,可实现海外设备本地语音指令理解、国际会议离线多语言字幕生成,无需依赖云端翻译服务,提升跨境使用的稳定性与安全性。

五、使用方法

1. Python环境快速部署(推荐入门方式)

安装方式

# 方式一:PyPI直接安装稳定版 pip install moonshine-voice # 方式二:GitHub源码安装最新版 git clone https://github.com/moonshine-ai/moonshine.git cd moonshine pip install .

核心功能调用命令

# 实时麦克风语音转录(英文) python -m moonshine_voice.mic_transcriber --language en # 实时麦克风语音转录(中文) python -m moonshine_voice.mic_transcriber --language zh # 启动语音指令意图识别 python -m moonshine_voice.intent_recognizer # 批量音频文件转写并导出结果 python -m moonshine_voice.transcribe --input ./audio_files/*.wav --output ./transcript_result.txt

2. 移动端部署使用

iOS平台:下载官方预编译示例工程包,使用Xcode导入后直接编译运行,支持真机与模拟器调试

下载地址:https://github.com/moonshine-ai/moonshine/releases/latest/download/ios-examples.tar.gzAndroid平台:下载官方示例压缩包,通过Android Studio导入项目,配置签名后即可安装运行

下载地址:https://github.com/moonshine-ai/moonshine/releases/latest/download/android-examples.tar.gz

3. 嵌入式设备(树莓派)部署

# 树莓派系统安装依赖 sudo pip install --break-system-packages moonshine-voice # 启动实时语音转录 python -m moonshine_voice.mic_transcriber --language en

4. 桌面端原生部署

macOS:下载官方示例包,使用Xcode编译生成独立应用,支持Intel与Apple Silicon全架构;

Windows:下载官方示例工程,通过Visual Studio编译,可生成exe可执行文件;

Linux:编译项目C++核心代码,调用原生推理接口,适配Ubuntu、Debian等主流发行版。

六、竞品对比

当前开源语音识别领域主流产品为OpenAI的Whisper、优化版Faster-Whisper,与Moonshine Voice核心对比如下:

| 对比维度 | Moonshine Voice | Whisper | Faster-Whisper |

|---|---|---|---|

| 运行模式 | 端侧本地离线 | 云端/本地 | 本地优化运行 |

| 识别精度 | Medium版WER 6.65%(最优) | Large v3 WER 7.44% | 接近原版Whisper |

| 推理延迟 | 最低50ms | Large v3约11286ms | 较Whisper快5-10倍 |

| 模型体积 | 最大2.45亿参数 | 15亿参数 | 与Whisper一致 |

| 端侧适配 | 全平台深度优化 | 端侧运行卡顿 | 轻度优化 |

| 高阶功能 | 意图识别、说话人分割 | 仅基础转录 | 仅基础转录 |

| 隐私性 | 纯本地无泄露风险 | 云端部署存在风险 | 本地无隐私风险 |

从对比结果可以看出,Moonshine Voice的核心优势集中在端侧适配性与实时性,精度优于Whisper的同时,速度提升超40倍,且自带完整语音交互功能,更适合产品化落地;Whisper更适合云端批量处理长语音,Faster-Whisper仅为Whisper的加速版本,无功能拓展与架构创新。

七、常见问题解答

Q1:Moonshine Voice是否支持中文离线识别?

支持,项目官方提供专门的中文模型权重,调用时通过--language zh参数即可切换中文识别,对普通话、常见口音均有良好适配效果。

Q2:运行该项目必须需要GPU吗?

不需要。Moonshine Voice针对CPU做了深度优化,Tiny、Base版本在普通笔记本、台式机CPU上均可流畅运行,Medium版本在主流PC CPU上也能实现实时推理,GPU仅用于进一步加速,非必需硬件。

Q3:项目支持哪些音频格式的文件转写?

支持WAV、MP3、FLAC、OGG等主流音频格式,其中16kHz单声道WAV格式为最优输入格式,识别效率与准确率最高。

Q4:商业项目使用Moonshine Voice需要付费吗?

核心代码与英文模型采用MIT协议,可免费商用;多语言模型对年收入低于100万美元的企业完全免费,超过该规模需联系官方申请企业商业授权。

Q5:识别准确率不理想时,有哪些优化方法?

可切换至Medium高精度模型;保证输入音频清晰,减少环境噪音;使用16kHz采样率的音频输入;针对特定行业场景可对模型进行微调训练。

Q6:能否将Moonshine Voice集成到自研软件或硬件中?

完全可以。项目提供Python、C++、Java、Swift等多语言API接口,支持二次开发集成到桌面软件、手机APP、嵌入式系统、智能硬件中。

Q7:低算力设备运行出现卡顿该如何解决?

建议切换至Tiny轻量级模型,关闭说话人分割、意图识别等高阶功能,降低音频采样率,可显著提升运行流畅度。

Q8:如何更新到最新版本的模型与代码?

PyPI安装用户可执行pip install --upgrade moonshine-voice更新;源码安装用户通过git pull拉取最新代码后重新安装即可。

八、相关链接

GitHub开源主仓库:https://github.com/moonshine-ai/moonshine

九、总结

Moonshine Voice作为一款专注端侧场景的开源语音识别框架,以离线运行、低延迟、轻量化、高精度为核心优势,在识别精度上超越行业主流的Whisper Large V3模型,同时将推理延迟压缩至毫秒级,模型体积大幅缩减,可无缝适配从PC、手机到嵌入式设备、IoT硬件的全品类终端,无需联网即可实现多语言语音转录、说话人分割、意图识别等完整功能,既保障了语音数据的隐私安全,又降低了语音技术的部署门槛与硬件成本,搭配商用友好的开源协议与完善的开发文档,成为个人开发者与企业搭建离线语音交互应用的优质选择,整体方案兼具实用性、兼容性与安全性,是当前端侧语音技术领域的标杆级开源项目。

版权及免责申明:本文由@AI工具集原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/moonshine-voice.html