SkyReels-V3:昆仑天工开源的全能多模态视频生成模型,覆盖图生视频、音生视频与视频扩展

一、SkyReels V3是什么

SkyReels V3是昆仑万维旗下Skywork AI团队自主研发的第三代旗舰多模态视频生成模型,基于统一多模态上下文学习框架与扩散Transformer架构打造,原生集成参考图像生成视频、音频引导数字人说话、视频到视频扩展三大核心能力,在参考一致性、视觉质量、音视频同步等核心评测指标达到行业SOTA水准,支持720P高清、多画幅比例、多人交互、电影级镜头转场与分钟级长视频生成。

该项目定位为一站式多模态视频生成解决方案,打破传统视频生成模型单任务、弱兼容的局限,在单一架构体系内原生支持三大核心生成范式,分别是多参考图像生成视频、音频驱动数字人说话、视频时序扩展,实现图像、音频、视频、文本多模态信号的统一编码与协同生成,无需切换模型即可完成全流程视频创作。

作为SkyReels系列的迭代升级版本,V3在V1以人为中心视频生成、V2 720P无限长度自回归生成的基础上,完成架构重构与能力整合,通过图像-视频混合训练、多分辨率联合优化、时空一致性建模、音视频精准对齐等核心技术优化,在参考主体保真、运动连贯性、叙事逻辑、画面质感等维度全面提升,核心指标超越多款主流商用闭源模型,同时保持开源项目的可部署、可定制、可二次开发特性,面向个人创作者、企业研发团队、科研机构提供无门槛的高性能视频生成能力。

从项目属性来看,SkyReels V3属于完全开源的商用友好型AI模型项目,代码托管于GitHub平台,模型权重同步发布在Hugging Face与ModelScope两大主流模型社区,支持本地私有化部署、云端容器化部署、API服务封装,同时配套在线演示空间与开放API平台,兼顾科研实验、个人创作、企业级工业化生产全场景需求,是当前开源AI视频领域覆盖能力最完整、落地性最强的标杆项目之一。

二、功能特色

SkyReels V3的核心特色围绕多模态统一生成、高保真效果、专业级可控性、全场景适配四大维度展开,三大核心功能模块均具备行业顶尖的效果与实用性,具体功能细节如下:

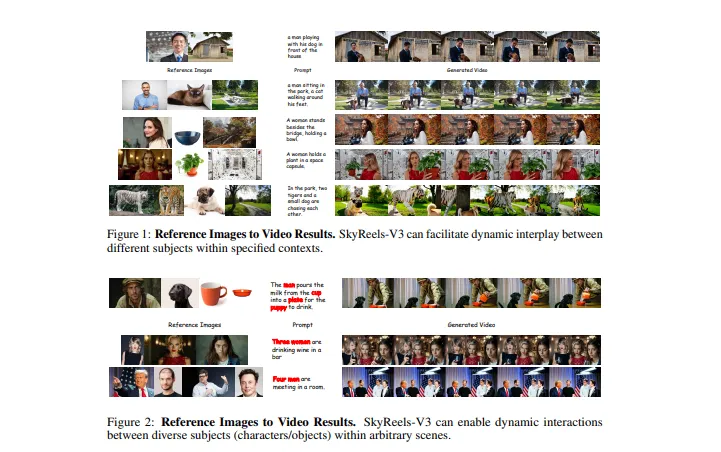

(一)多参考图像生成视频(Reference to Video)

这是SkyReels V3的基础核心功能,也是项目最具竞争力的能力之一,支持输入1-4张任意类型参考图像,结合文本提示词生成时序连贯、主体高度保真的视频序列。

参考素材兼容:支持人物肖像、动物、静物、场景背景等全部视觉元素,单任务可同时融合人物、物体、环境多张参考图,无需手动构图即可生成复杂多主体场景。

主体一致性保障:参考一致性指标达0.6698,为行业顶尖水平,人物面部、服饰纹理、物体形态、场景结构在视频全程无畸变、无漂移,彻底解决传统图生视频的“粘贴感”与身份失真问题。

画幅与规格灵活:原生支持1:1、3:4、4:3、16:9、9:16全主流画幅,默认输出720P/24fps高清视频,适配短视频平台、社交平台、广告投放等全部发布场景。

叙事与运动自然:生成视频具备符合物理规律的动态效果,光影变化、物体运动、人物动作流畅自然,支持复杂交互场景,可直接用于电商产品展示、短剧片段、创意短视频制作。

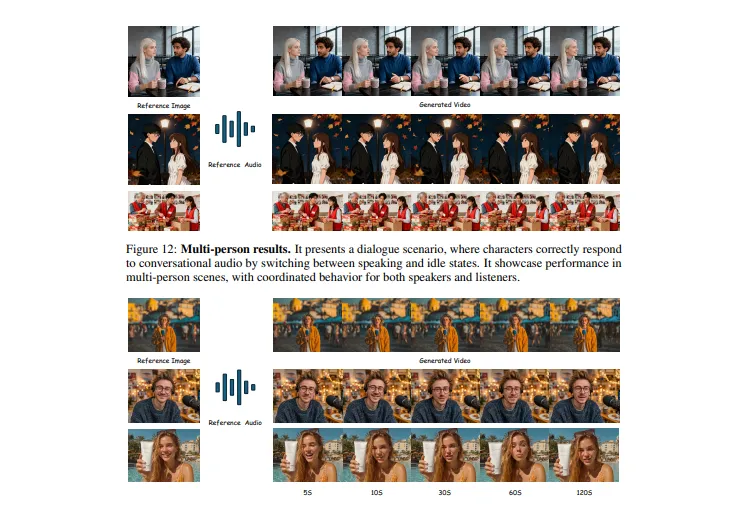

(二)音频驱动数字人说话(Talking Avatar)

该功能专注于虚拟形象音视频同步生成,单张肖像图+一段音频即可生成分钟级口型精准、表情自然的数字人视频,是虚拟主播、知识科普、新闻播报场景的核心工具。

音视频精准对齐:音视频同步评分达8.18,接近行业顶尖水平,支持中文、英文、韩语等多语种,适配日常说话、快速播报、歌唱等多种语音形态,口型与音素严格匹配,无违和感。

长视频稳定生成:单次推理可生成最长200秒的连贯视频,全程保持人物身份一致、面部无扭曲、动作无卡顿,满足长课程、长播报、长访谈的创作需求。

多风格形象兼容:覆盖真人写实、卡通动漫、艺术风格、动物形象等全部视觉类型,可快速将静态IP形象转化为可发声的动态数字人。

多人对话支持:行业首创多角色数字人对话生成能力,可通过掩码指定说话角色,生成访谈、双人对话、多人交流等复杂场景,角色动作与表情符合对话逻辑。

(三)视频到视频扩展(Video Extension)

该功能用于对现有短视频进行时序延长与镜头拓展,分为单镜头无缝延续与多镜头智能切换两种模式,解决短视频内容延展、长视频制作的痛点。

双模式扩展:单镜头模式可将5秒视频无缝延长至30秒,保持运动、场景、风格完全一致;镜头切换模式内置切入、切出、多角度、正反打、切离5种电影级转场,自动生成专业影视化镜头语言。

风格严格继承:完整保留原视频的画质风格、光影色调、镜头质感,无论是写实、电影感、二次元风格,均无风格漂移问题。

复杂场景适配:可处理快速运动、多人物互动、场景突变等高难度视频,严格遵循物理规律,延长内容具备叙事逻辑性,而非单纯的帧插值。

规格统一:延长后视频保持720P分辨率与原画幅比例,输出文件可直接剪辑拼接,适配长视频工业化生产流程。

(四)通用基础特色

开源完整度高:开放全部推理代码、模型权重、部署脚本、示例命令,无功能阉割,支持本地全功能运行。

硬件适配友好:提供低显存优化方案,支持24GB以下显存显卡运行,同时兼容单GPU与多GPU分布式推理,搭配xDiT USP技术提升生成速度。

量化与加速:支持FP8权重量化、模块卸载(offload)等优化手段,平衡生成速度与硬件占用。

生态配套完善:同步提供在线演示空间、开放API、技术报告、演示视频,降低上手门槛,支持快速集成到自有产品。

为直观呈现核心性能优势,整理官方权威评测对比表如下:

| 评测维度 | 核心指标 | SkyReels-V3 | 主流对比模型 | 行业定位 |

|---|---|---|---|---|

| 参考图生视频 | 参考一致性 | 0.6698 | Vidu Q2(0.5961)、Kling 1.6(0.6630) | 行业第一 |

| 参考图生视频 | 视觉质量 | 0.8119 | Vidu Q2(0.7877)、Kling 1.6(0.8034) | 行业第一 |

| 数字人生成 | 音视频同步 | 8.18 | OmniHuman 1.5(8.25)、KlingAvatar(8.01) | 行业顶尖 |

| 数字人生成 | 视觉质量 | 4.60 | OmniHuman 1.5(4.60)、KlingAvatar(4.55) | 行业顶尖 |

| 数字人生成 | 角色一致性 | 0.80 | OmniHuman 1.5(0.81)、KlingAvatar(0.78) | 行业顶尖 |

三、技术细节

SkyReels V3的优异效果源于底层架构、训练策略、数据处理、推理优化四大维度的技术创新,整体采用“一核多支”设计,即统一多模态上下文学习基座+三大子任务精调分支,兼顾架构通用性与任务专业性,核心技术细节如下:

(一)整体架构:统一多模态上下文学习框架

项目以扩散Transformer为基础架构,构建统一的多模态编码与生成体系,将图像、音频、视频、文本四类输入信号映射到同一隐空间进行联合建模,打破不同模态的生成壁垒。

多模态编码器:独立设计视觉编码器、音频编码器、文本编码器,将参考图像、输入视频、驱动音频、文本提示词转化为统一维度的隐特征,实现跨模态信息融合。

时空联合建模:在Transformer结构中融入空间位置编码与时序位置编码,同时建模画面空间结构与视频时序变化,解决传统模型运动模糊、时序混乱的问题。

模块化分支设计:基座模型完成通用多模态理解与视频生成能力预训练,再针对图生视频、音生视频、视频扩展三个任务进行专属精调,既保证架构统一,又实现各任务效果最优。

(二)训练策略:图像-视频混合与多分辨率联合优化

图像-视频混合训练:同步使用大规模高质量图像数据集与视频数据集训练,让模型同时学习静态视觉特征与动态运动规律,提升静态主体保真度与动态流畅度。

多分辨率联合训练:训练过程覆盖从低分辨率到720P的多尺度数据,增强模型对不同画幅、不同尺寸素材的泛化能力,原生支持多比例输出无需后处理裁剪。

专属任务训练范式:针对图生视频设计跨帧配对数据构建流程,针对音生视频采用音素级对齐训练,针对视频扩展使用分层时序数据训练,匹配各任务的核心需求。

(三)数据处理:高保真训练样本构建

参考图生视频数据 pipeline:采用跨帧配对策略从高质量视频中选取参考帧,结合图像编辑模型完成主体提取与背景补全,通过语义重写避免帧复制伪影,构建无粘贴感的训练样本。

音视频对齐数据:采集多语种、多风格语音数据,精准标注音素与面部运动对应关系,构建高质量音视频同步训练集,提升口型匹配精度。

视频扩展数据:构建包含单镜头、多镜头转场的长视频数据集,训练镜头检测与转场生成能力,让模型理解影视镜头语言逻辑。

(四)推理优化:速度与显存平衡

低显存适配:提供

--low_vram参数开启FP8权重量化与模块卸载,支持消费级显卡运行,降低硬件门槛。多GPU加速:兼容torchrun分布式推理,结合xDiT USP技术实现多卡并行生成,大幅缩短生成时间。

关键帧约束生成:针对长视频数字人生成,采用关键帧先确定结构、再平滑过渡的方式,保证长时序稳定性。

分辨率动态调节:支持540P、480P等低分辨率输出,进一步降低硬件要求,适配不同配置设备。

(五)模型规格

项目提供三个专属任务模型,均为开源可下载版本,具体规格如下:

参考图生视频模型:14B参数,720P分辨率,支持1-4张参考图输入。

视频扩展模型:14B参数,720P分辨率,支持单镜头与多镜头切换扩展。

音频驱动数字人模型:19B参数,720P/24fps,支持最长200秒音频输入。

四、应用场景

SkyReels V3的全能型特性使其覆盖个人创作、商业生产、企业服务、科研教育全场景,核心落地方向如下:

(一)内容创作与新媒体

短视频创作:使用单张图片生成带货视频、创意短片、风景动态视频,无需拍摄即可快速产出平台内容。

短剧与影视创作:通过视频扩展功能将短镜头延长为完整片段,结合多角色数字人生成对话场景,降低短剧拍摄成本。

社交内容:生成个性化动态头像、节日祝福视频、创意特效视频,满足社交平台分享需求。

(二)虚拟形象与直播电商

虚拟主播:将品牌IP、真人肖像转化为24小时在线的数字人主播,完成直播带货、商品讲解。

客服数字人:制作企业专属虚拟客服,通过音频驱动生成讲解视频,用于产品说明、售后指导。

产品展示:单张产品图生成动态展示视频,呈现产品细节、使用场景、运动效果,提升电商转化率。

(三)教育培训与知识科普

在线课程:教师肖像+课程音频生成教学视频,快速制作系列课程,降低录课成本。

科普内容:用卡通/写实形象生成科普讲解视频,适配少儿教育、专业知识普及场景。

企业内训:制作标准化培训视频,统一讲解口径,适用于员工技能培训、制度宣讲。

(四)影视与广告制作

镜头预演:快速生成分镜视频,用于影视项目前期策划、镜头效果验证。

广告素材:批量生成产品广告短片、品牌宣传视频,适配多平台投放规格。

素材补全:对现有影视素材进行时长扩展、镜头补充,减少拍摄工作量。

(五)科研与二次开发

学术研究:作为视频生成、多模态建模、数字人技术的研究基座,用于算法创新、指标验证。

企业二次开发:集成到自有内容平台、设计工具、直播系统,定制专属视频生成功能。

工具开发:基于开源代码封装可视化界面、批量生成工具,打造垂直领域视频创作产品。

五、使用方法

SkyReels V3提供标准化部署与推理流程,全程基于Python环境,支持Linux、Windows WSL2系统,官方推荐配置为Python 3.12+、CUDA 12.8+,具体步骤如下:

(一)环境准备与代码克隆

安装Git与Python环境,配置CUDA显卡驱动与PyTorch依赖。

克隆项目仓库到本地:

git clone https://github.com/SkyworkAI/SkyReels-V3 cd SkyReels-V3

安装项目依赖包:

pip install -r requirements.txt

(二)模型下载

模型权重自动从Hugging Face下载,也可手动从ModelScope下载后指定本地路径,三大模型下载入口如下:

参考图生视频(SkyReels-V3-R2V-14B):Hugging Face、ModelScope

视频扩展(SkyReels-V3-V2V-14B):Hugging Face、ModelScope

音频数字人(SkyReels-V3-A2V-19B):Hugging Face、ModelScope

使用--model_id参数可指定本地模型路径,避免重复下载。

(三)核心任务推理命令

1. 参考图生成视频(单GPU)

python3 generate_video.py \ --task_type reference_to_video \ --ref_imgs "参考图1链接/路径,参考图2链接/路径" \ --prompt "视频内容文本描述" \ --duration 5 \ --offload

参数说明:--ref_imgs支持1-4张图,逗号分隔;--duration为视频时长,单位秒;--offload开启显存卸载优化。

2. 参考图生成视频(4GPU加速)

torchrun --nproc_per_node=4 generate_video.py \ --task_type reference_to_video \ --ref_imgs "参考图1,参考图2" \ --prompt "文本描述" \ --duration 5 \ --offload --use_usp

3. 单镜头视频扩展

python3 generate_video.py \ --task_type single_shot_extension \ --input_video "原视频路径" \ --duration 30 \ --offload

4. 镜头切换视频扩展

torchrun --nproc_per_node=4 generate_video.py \ --task_type shot_switching_extension \ --input_video "原视频路径" \ --duration 5 \ --offload --use_usp

5. 音频驱动数字人生成

python3 generate_video.py \ --task_type talking_avatar \ --input_image "肖像图路径/链接" \ --input_audio "音频路径/链接" \ --prompt "场景描述" \ --seed 42 \ --offload

参数说明:音频支持mp3、wav格式,时长≤200秒;图片支持jpg、png、bmp等格式。

(四)低显存设备优化

针对显存低于24GB的显卡,添加优化参数:

export PYTORCH_CUDA_ALLOC_CONF="expandable_segments:True" python3 generate_video.py --low_vram --resolution 540P 其他参数

--low_vram开启量化优化,--resolution降低输出分辨率,提升运行成功率。

六、常见问题解答

1. 运行时提示显存不足如何解决

优先添加--low_vram参数开启低显存模式,同时将--resolution设置为540P或480P,减少生成分辨率;也可开启--offload参数将部分模型模块卸载到内存,降低显卡显存占用;条件允许时使用多GPU分布式推理,分摊单卡显存压力。

2. 支持的输入文件格式有哪些

参考图像支持jpg、jpeg、png、gif、bmp格式;输入视频支持主流mp4、mov格式;驱动音频支持mp3、wav格式,且音频时长不能超过200秒,超过会被自动截断。

3. 生成视频出现主体失真、运动模糊怎么办

检查参考图清晰度,优先使用高清、无遮挡、光线均匀的参考图像;优化文本提示词,描述更具体的场景、动作、镜头要求,减少模糊表述;单任务参考图不超过4张,避免过多素材导致模型融合混乱;保持默认720P分辨率,低分辨率会降低细节质感。

4. 数字人口型与音频对不准的调整方法

使用清晰、无噪音、无背景音乐的纯人声音频,避免音频干扰导致对齐偏差;提示词中明确说明镜头类型、人物状态,如“固定镜头、正面说话、表情自然”;使用官方推荐的音频格式与采样率,避免转码导致的音频特征丢失;多人物场景必须添加掩码指定说话角色,否则会出现角色口型错乱。

5. 视频扩展时风格与原视频不一致如何处理

提示词中补充原视频的风格描述,如“写实电影感、暖色调、高清质感”,引导模型继承原视频风格;仅使用单镜头扩展模式,避免镜头切换带来的风格波动;原视频避免过度模糊、低画质、强滤镜的素材,高质量原视频才能保证扩展效果一致。

6. Windows系统能否本地运行

原生支持Windows WSL2环境,完整复刻Linux部署流程;不支持原生Windows命令行直接运行,建议安装WSL2 Ubuntu子系统后按照官方步骤部署,可获得与Linux一致的运行效果。

7. 模型权重下载缓慢或失败

可切换至ModelScope镜像下载,下载后通过--model_id指定本地文件夹路径;使用网络代理提升Hugging Face下载速度;避免断点续传异常,完整下载模型权重文件后再启动推理。

8. 能否用于商业项目,是否有版权限制

项目遵循官方开源协议,允许个人非商用与商用使用,具体授权条款以GitHub仓库LICENSE文件为准;生成内容的版权遵循当地法律法规,使用真人肖像、受版权保护的素材需提前获得授权,项目本身不承担素材版权相关责任。

9. 生成速度慢如何提升

使用NVIDIA高性能显卡,如RTX 4090、A10、A100等;开启多GPU分布式推理,搭配--use_usp参数启用xDiT加速;适当降低视频时长与分辨率,缩短单轮推理时间;关闭不必要的后台程序,释放系统内存与显存资源。

10. 能否修改模型代码、添加自定义功能

项目完全开源推理代码,支持二次修改、功能拓展、界面封装,可根据自身需求添加批量生成、可视化界面、格式转换、任务调度等功能,适合开发者搭建专属视频生成工具。

七、相关链接

项目官方GitHub代码仓库:https://github.com/SkyworkAI/SkyReels-V3

Hugging Face模型地址:

ModelScope模型仓库:

https://www.modelscope.cn/models/Skywork/SkyReels-V3-R2V-14B

https://www.modelscope.cn/models/Skywork/SkyReels-V3-V2V-14B

https://www.modelscope.cn/models/Skywork/SkyReels-V3-A2V-19B

官方在线演示Playground:https://huggingface.co/spaces/Skywork/SkyReels-V3

官方技术报告文档:https://arxiv.org/pdf/2601.17323

八、总结

SkyReels-V3是昆仑万维Skywork AI团队打造的成熟开源多模态视频生成项目,以统一多模态上下文学习框架为核心,整合参考图生视频、音频驱动数字人、视频扩展三大核心能力,凭借行业顶尖的参考一致性、视觉质量、音视频同步效果,以及完整的开源代码、模型权重与部署方案,兼顾高性能生成效果与低门槛落地使用,既满足个人创作者快速产出视频的需求,也支持企业进行私有化部署与二次开发,覆盖新媒体创作、电商直播、教育培训、影视制作、科研实验等全场景,是当前开源生态中功能完整、效果优异、实用性极强的视频生成基座,为AI视频技术的普及与工业化应用提供了可靠的开源方案。

版权及免责申明:本文由@AI工具集原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/skyreels-v3.html