Story Flicks:开源AI故事视频生成神器,一键制作高清短视频

一、Story Flicks 是什么?

Story Flicks是一款基于 多模态AI大模型 的开源视频生成工具,用户只需输入一个故事主题,系统就能自动生成包含 高清图像、动态分镜、多语言配音、智能字幕 的完整短视频。它通过集成多种AI模型(如GPT-4、DeepSeek、阿里云Bailian等)实现全流程自动化,将传统视频制作的繁琐流程简化为“一键完成”。

核心特点

零门槛操作:无需视频剪辑经验,输入主题即可生成视频。

全流程AI生成:自动完成故事脚本、配图、配音、字幕及视频合成。

多模型支持:兼容OpenAI、阿里云、DeepSeek等主流AI服务商。

高度可定制:可调整故事长度、风格(卡通/写实/3D动画)、语言及配音情感。

开源免费:代码完全公开,支持二次开发,无商业授权风险。

二、功能特色

Story Flicks 的核心功能可概括为 “输入文字,输出电影”,具体包括以下亮点:

1. 自动化故事生成

输入一个主题(如“太空小猫拯救火星”),AI自动生成完整故事情节,并拆解为分镜脚本。

支持调整段落数量,每个段落对应一张AI生成的图片,段落越多,视频越长。

2. 多模态内容生成

| 模块 | 技术实现 | 功能描述 |

|---|---|---|

| 文本生成 | 集成GPT-4、DeepSeek、阿里云Bailian等模型 | 自动生成故事脚本,支持中英日韩等12种语言。 |

| 图像生成 | 调用Stable Diffusion、阿里云FLUX-1等模型 | 生成4K画质图片,支持动态场景(如火箭升空、角色互动)。 |

| 音频合成 | 使用OpenAI TTS、Google TTS、Whisper等技术 | 提供30种语言及方言配音(如四川话、粤语),可调节语速和情感。 |

| 视频合成 | 基于FFmpeg和OpenCV | 自动对齐音画、添加字幕及转场特效,输出MP4/GIF格式。 |

3. 用户友好设计

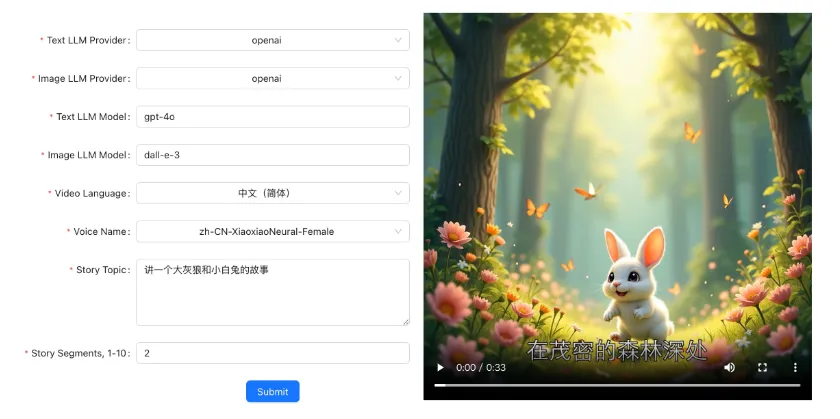

简洁界面:React + Ant Design 前端,支持参数实时调整和视频预览。

多平台适配:一键输出横屏/竖屏格式,适配抖音、B站、YouTube等平台。

智能分析:生成视频效果预测报告,包括完播率、爆点预判等数据指标。

三、技术细节

Story Flicks 的技术架构分为 前端、后端 和 AI模型集成 三部分:

1. 后端技术栈

框架:Python + FastAPI,高效处理AI模型调用和视频合成任务。

视频渲染:FFmpeg + OpenCV,实现多轨道合成与特效添加。

异步任务:使用Celery或类似工具管理耗时任务(如长视频生成)。

2. 前端技术栈

框架:React + Ant Design + Vite,提供响应式交互界面。

功能模块:

模型选择(文本/图像/语音提供商)

故事主题与段落设置

生成进度实时显示

3. AI模型集成

支持以下主流AI服务商,用户可自由切换或组合使用:

| 服务类型 | 支持模型 | 备注 |

|---|---|---|

| 文本生成 | GPT-4、DeepSeek、阿里云Qwen、Ollama(需14B以上参数模型) | Ollama需本地部署,推荐qwen2.5:14b。 |

| 图像生成 | OpenAI DALL-E 3、阿里云FLUX-1、SiliconFlow FLUX.1-dev | 阿里云FLUX-1提供500张免费额度。 |

| 语音合成 | OpenAI TTS、Google TTS、Whisper | 中文配音推荐阿里云语音合成。 |

四、应用场景

Story Flicks 适用于多种创作需求:

自媒体涨粉:3分钟生成热点解说视频(如“淄博烧烤经济学”),效率提升10倍。

教育培训:将课文《孔乙己》转化为动画短片,学生“追剧式”学习。

商业推广:宠物店定制“萌宠大片”,收费99元/部。

个人创作:将聊天记录变成情侣微电影,作为纪念日礼物。

五、使用方法

1. 安装部署

推荐Docker一键部署(适合小白):

git clone https://github.com/alecm20/story-flicks.git cd story-flicks docker-compose up --build

手动安装(适合开发者):

后端启动:

cd backend conda create -n story-flicks python3.10 conda activate story-flicks pip install -r requirements.txt uvicorn main:app --reload

前端启动:

cd frontend npm install npm run dev

启动后访问 http://localhost:5173。

2. 配置API密钥

复制backend/.env.example为.env,填写以下关键信息:

text_provider="openai" # 可选:openai/aliyun/deepseek/ollama image_provider="aliyun" # 可选:openai/aliyun/siliconflow openai_api_key="sk-xxx" # OpenAI密钥 aliyun_api_key="xxx" # 阿里云百炼密钥

注意:阿里云FLUX-1需在控制台授权。

3. 生成视频

在界面输入故事主题(如“兔子和狐狸的冒险”)。

选择模型、语言、声音及段落数量。

点击“生成”,等待3-10分钟即可下载视频。

六、常见问题解答

Q1:硬件要求是什么?

本地部署:需RTX 3080以上显卡,推荐使用云服务或Docker在线版。

API依赖:若使用Ollama等本地模型,需至少16GB内存。

Q2:如何优化中文生成效果?

添加风格关键词(如“古风武侠”“现代职场”),或选择阿里云Qwen模型。

Q3:生成的视频能否商用?

遵循Apache 2.0协议,可免费商用,但需遵守AI模型的版权规则(如DALL-E 3的商用限制)。

Q4:生成速度慢怎么办?

减少段落数量(每段对应一张图)。

使用高性能云API(如阿里云Bailian)。

七、相关链接

总结

Story Flicks 通过多模态AI技术,将短视频创作从“专业团队专利”变为“全民可玩”。无论是自媒体、教育还是商业场景,用户只需一个创意,即可在几分钟内生成高质量视频,彻底解放创作生产力。其开源特性与灵活配置,进一步降低了技术门槛,成为内容创作者的高效利器。

版权及免责申明:本文由@AI铺子原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/story-flicks.html