Tiny Aya:轻量级多语言文本生成模型,实现规模与多语言深度平衡且适配CPU运行

一、Tiny Aya是什么

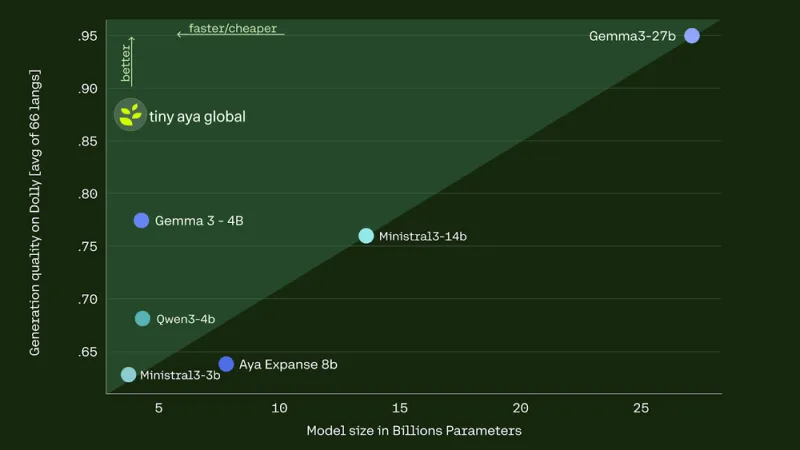

Tiny Aya是由CohereLabs开发并开源的轻量级多语言文本生成模型系列,核心研发理念为Bridging Scale and Multilingual Depth(桥接模型规模与多语言深度处理)。作为一款聚焦于文本生成的专用AI模型,其核心能力是实现任意语言的对话交互与文本生成,区别于传统多语言大模型对高算力GPU硬件的强依赖,Tiny Aya全系列均采用3B参数量的轻量级设计,原生支持CPU端运行,让普通用户也能在消费级硬件上体验多语言AI能力。

该模型以开源形式在Hugging Face平台发布,无商业使用壁垒,开发者和普通用户均可免费获取、使用和二次开发。为了适配不同的多语言使用场景和部署需求,CohereLabs为Tiny Aya打造了双版本体系:一是原生文本生成版本,包含基础通用版和四款针对不同语言区域优化的版本;二是GGUF格式版本,对应四款区域优化版打造,专为本地轻量化离线部署设计。两款版本均完成了近期的迭代更新,保证了模型功能的新鲜度和使用的流畅性,是一款面向个人开发者、中小企业、教育机构等主体的普惠型多语言AI模型。

二、Tiny Aya功能特色

Tiny Aya凭借轻量级设计、多语言适配、双版本体系等核心特性,成为消费级硬件场景下多语言文本生成的优选模型,其核心功能特色围绕低门槛、多语言、高适配、易获取四大核心展开,具体特性如下表所示:

| 功能特色 | 具体说明 |

|---|---|

| 轻量级低算力门槛 | 全系列统一3B参数量,原生支持CPU端运行,无需高算力GPU硬件,可在8GB内存以上的笔记本、台式机等消费级硬件上流畅运行,大幅降低使用的硬件成本 |

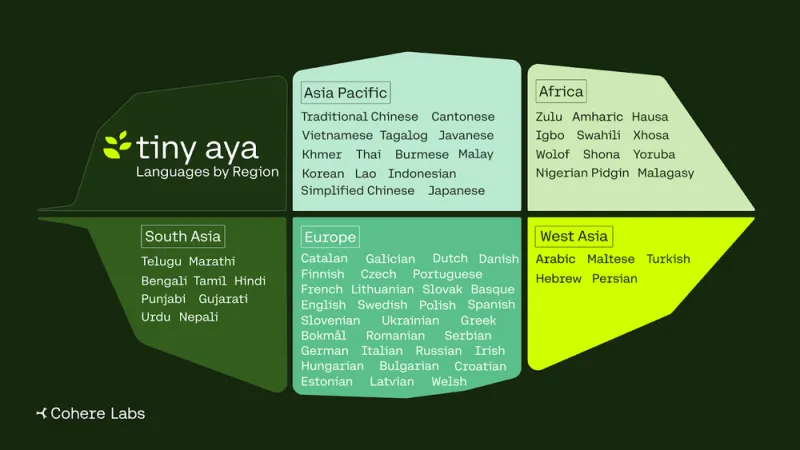

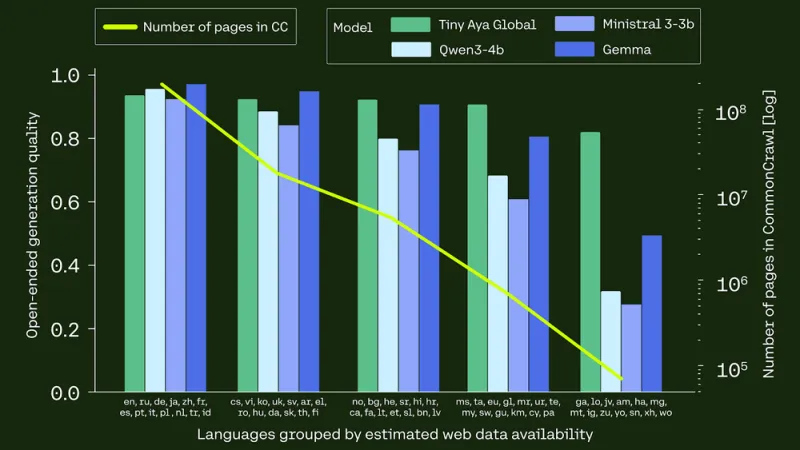

| 多语言深度处理能力 | 核心支持“任意语言对话与文本生成”,并推出多款区域优化版模型,针对性适配不同语言区域的使用需求,实现多语言处理的精准化与深度化 |

| 双版本体系适配多元需求 | 同时提供原生文本生成版本和GGUF格式版本,原生版适配Hugging Face生态的常规开发与部署,GGUF版适配本地轻量化离线部署,覆盖不同用户的使用场景 |

| 高效的版本迭代更新 | 核心原生版本在3天前完成最新更新,GGUF格式版本在5天前完成更新,迭代节奏紧凑,能及时优化模型性能、修复使用问题 |

| 开源无壁垒易获取 | 在Hugging Face平台完全开源,用户无需复杂的认证流程即可访问、下载和使用,个人开发者、中小企业、教育机构等各类主体均能零门槛获取模型资源 |

| 数据安全的离线运行能力 | 支持本地CPU端离线部署,无论是原生版本还是GGUF格式版本,均可脱离网络和云端算力运行,有效保障用户的文本数据隐私与安全 |

除上述核心特色外,Tiny Aya的GGUF格式版本还继承了GGUF格式的天然优势,支持模型量化、单文件部署、内存映射秒级加载等特性,进一步提升了本地部署的灵活性和运行效率;而原生版本则深度兼容Hugging Face生态的transformers、pipeline等工具库,让开发者能快速融入现有开发流程,降低二次开发的学习成本。

三、Tiny Aya技术细节

Tiny Aya的技术设计围绕“轻量级、CPU友好、多语言适配”三大核心目标展开,从参数量、模型类型、格式设计、版本划分等多个维度进行了针对性优化,其全系列模型的核心技术参数与版本信息如下表所示:

| 模型名称 | 模型类型 | 参数量 | 更新时间 | 格式类型 | 核心定位 |

|---|---|---|---|---|---|

| CohereLabs/tiny-aya-base | 文本生成 | 3B | 3天前 | 原生格式 | 基础通用版,适配多语言通用文本生成与对话 |

| CohereLabs/tiny-aya-global | 文本生成 | 3B | 3天前 | 原生格式 | 全球多语言优化版,适配国际通用多语言场景 |

| CohereLabs/tiny-aya-earth | 文本生成 | 3B | 3天前 | 原生格式 | 区域优化版,适配特定区域语言处理需求 |

| CohereLabs/tiny-aya-fire | 文本生成 | 3B | 3天前 | 原生格式 | 区域优化版,适配特定区域语言处理需求 |

| CohereLabs/tiny-aya-water | 文本生成 | 3B | 3天前 | 原生格式 | 区域优化版,适配特定区域语言处理需求 |

| CohereLabs/tiny-aya-global-GGUF | 文本生成 | 3B | 5天前 | GGUF格式 | global版轻量化部署版本,适配本地CPU离线推理 |

| CohereLabs/tiny-aya-earth-GGUF | 文本生成 | 3B | 5天前 | GGUF格式 | earth版轻量化部署版本,适配本地CPU离线推理 |

| CohereLabs/tiny-aya-fire-GGUF | 文本生成 | 3B | 5天前 | GGUF格式 | fire版轻量化部署版本,适配本地CPU离线推理 |

| CohereLabs/tiny-aya-water-GGUF | 文本生成 | 3B | 5天前 | GGUF格式 | water版轻量化部署版本,适配本地CPU离线推理 |

结合上述参数表,Tiny Aya的核心技术细节可分为以下五大方面:

(一)3B轻量级参数量的标准化设计

Tiny Aya全系列模型均采用3B参数量设计,这一参数量级是兼顾模型能力与硬件适配性的最优解:相比1B及以下的超轻量模型,3B参数量能保证多语言文本生成的准确性和流畅性,满足日常对话、内容生成、文本续写等需求;相比7B及以上的模型,3B参数量的内存占用大幅降低,无需GPU显存支撑,仅依靠CPU的内存即可完成模型加载和推理,适配8GB内存以上的消费级硬件,这也是该模型能实现CPU端运行的核心技术基础。

(二)纯文本生成的模型类型定位

Tiny Aya的模型类型为纯Text Generation(文本生成),聚焦于自回归文本生成与对话交互能力,未集成视觉、语音等多模态模块。这一设计的核心目的是精简模型体积、降低算力消耗,避免多模态模块带来的额外硬件负担,让模型能更专注于多语言文本处理的核心需求,同时也让模型的推理速度更快,在CPU端能实现流畅的文本生成与对话响应。

(三)双格式的部署技术支撑

Tiny Aya推出了原生格式和GGUF格式双版本,分别适配不同的部署场景,两种格式的技术设计各有侧重:

原生格式:深度兼容Hugging Face生态的transformers库,采用Hugging Face标准的模型文件结构,包含config.json、tokenizer.json、模型权重文件等,支持通过AutoModelForCausalLM、AutoTokenizer等工具快速加载,适合熟悉Python开发、需要进行模型二次开发或融入现有Hugging Face开发流程的用户;

GGUF格式:是llama.cpp推理框架的核心二进制文件格式,专为CPU端推理场景深度优化,模型所有的权重、元数据、架构信息均封装在单个文件中,支持模型量化、内存映射(mmap)、多线程并行等特性,能大幅降低内存占用、提升加载速度,适合追求轻量化部署、无需二次开发、仅需离线使用模型推理能力的用户。

(四)GGUF格式的核心技术优势

Tiny Aya的GGUF格式版本继承了GGUF格式的五大核心技术特性,也是该版本能实现高效CPU端离线推理的关键:

单文件部署:模型所有信息均封装在单个.gguf文件中,分发和部署如同传输普通文件般简单,无需配套的配置文件和权重文件,降低了本地部署的操作难度;

量化支持:支持Q4_0、Q5_K_M、Q8_0等多种量化方式,可将模型参数压缩至原大小的1/4-1/2,进一步降低内存占用,适配低内存的消费级硬件;

内存映射秒级加载:采用mmap内存映射技术,支持GB级模型的秒级加载,无需将模型完整加载至内存,大幅降低模型启动延迟;

跨语言兼容:支持Python、C++等多种编程语言,用户可通过少量代码实现模型的读写和推理,适配不同的开发语言环境;

自包含信息设计:模型的架构信息、训练参数、分词器信息等均嵌入文件中,用户拿到文件后可直接运行,无需额外提供架构定义和配置信息。

(五)版本更新的技术时效性

Tiny Aya的原生版本和GGUF格式版本均完成了近期的迭代更新,其中原生版本(包括base版和四款区域优化版)在3天前完成更新,GGUF格式版本在5天前完成更新。紧凑的迭代节奏能及时优化模型的多语言处理能力、修复模型推理中的BUG、提升CPU端的运行效率,保证用户使用的是最新、最稳定的模型版本,同时也体现了CohereLabs对该开源项目的持续维护能力。

四、Tiny Aya应用场景

Tiny Aya凭借CPU运行、轻量级、多语言、开源、支持离线部署等特性,打破了多语言AI模型对高算力硬件的依赖,其应用场景覆盖个人用户、中小企业、教育机构、开发者等各类主体,核心聚焦于低算力环境、消费级硬件、多语言日常使用等场景,具体的典型应用场景如下:

(一)个人端跨语言日常对话与沟通

对于有跨境出行、跨境交流需求的个人用户,Tiny Aya可在笔记本、台式机等消费级硬件上离线部署,实现任意语言的实时对话、翻译和文本生成。比如出国旅游时,可通过模型快速生成当地语言的问路、点餐、住宿等对话内容;与海外亲友沟通时,可实现实时的跨语言文本翻译,无需依赖网络和云端翻译工具,既保证了使用的便捷性,又能避免网络环境不佳导致的使用问题。

(二)中小企业轻量级多语言内容生成

对于无高算力GPU硬件的中小企业,尤其是跨境电商、小微外贸企业,Tiny Aya可用于多语言产品文案、宣传语、邮件、客服回复等内容的生成。比如跨境电商商家可通过模型快速生成多语言的产品标题、详情页描述;小微外贸企业可生成多语言的商务邮件、客户咨询回复,无需聘请专业的多语言文案人员,大幅降低跨境业务的沟通和内容制作成本,且模型支持本地离线运行,能有效保障商业数据的隐私安全。

(三)教育机构的多语言教学教研

中小学、培训机构等教育机构可利用Tiny Aya开展多语言教学教研工作,比如生成多语言的教学素材、练习题、双语阅读文本,或为学生提供多语言对话练习、单词讲解等辅助教学服务。模型支持CPU端运行,学校无需搭建高算力的AI机房,仅通过普通的教学电脑即可部署和使用,能让多语言AI教学走进普通课堂,提升教学的趣味性和效率。

(四)开发者的多语言AI原型快速验证

对于AI开发者,尤其是个人开发者和小型开发团队,Tiny Aya的开源特性和生态兼容性使其成为多语言AI产品原型快速验证的优选模型。开发者可通过Hugging Face的在线推理界面快速验证多语言文本生成、对话等需求,也可通过原生版本快速融入Hugging Face开发流程,搭建多语言AI产品的原型系统,无需投入大量的算力资源进行模型训练和调试,大幅降低了多语言AI产品的开发成本和周期。

(五)低算力环境下的本地化多语言文本处理

对于政府基层单位、社区服务中心等有多语言服务需求但算力资源有限的机构,Tiny Aya可实现本地化的多语言文本处理,比如生成多语言的政策宣传文案、服务指南,或为外籍居民提供多语言的咨询解答服务。模型支持离线部署,数据无需上传至云端,能有效保障政务数据和居民信息的安全,同时纯CPU运行的特性也让机构无需额外投入算力硬件,降低了政务服务的信息化成本。

(六)边缘设备的多语言AI功能集成

对于边缘设备开发者,Tiny Aya的GGUF格式版本可轻松集成至智能音箱、平板电脑、便携式翻译机等边缘设备中,为设备添加多语言文本生成、对话、翻译等AI功能。GGUF格式的单文件部署、量化支持等特性让模型能适配边缘设备的低算力、低内存特性,而CPU运行的特性则无需为设备配备独立的GPU模块,大幅降低了边缘设备的硬件设计和生产成本。

五、Tiny Aya使用方法

Tiny Aya的使用方法根据使用场景和模型格式可分为三大类:Hugging Face在线快速使用(无需代码、适合所有用户)、原生格式版本本地部署(基于Python、适合开发者)、GGUF格式版本本地部署(基于llama.cpp、适合轻量化离线部署用户)。三种方法的操作难度由低到高,覆盖了普通用户到专业开发者的所有使用需求,具体操作步骤如下:

(一)Hugging Face在线快速使用

该方法是最简单的使用方式,无需下载模型、无需编写代码,无需本地硬件支持,仅通过浏览器即可使用Tiny Aya的多语言文本生成和对话能力,适合普通用户和快速验证需求的开发者,具体步骤:

打开浏览器,访问Hugging Face平台Tiny Aya的官方集合页面(https://huggingface.co/collections/CohereLabs/tiny-aya);

在集合页面中选择需要使用的模型版本(如tiny-aya-base、tiny-aya-global),点击模型名称进入对应的模型详情页;

在模型详情页中找到Inference Widget(在线推理窗口),在输入框中输入需要生成/对话的文本指令(支持任意语言);

点击输入框右侧的Generate(生成)按钮,等待几秒后,页面即可输出模型的生成结果,用户可根据需求调整生成的最大长度、温度等参数。

注意:在线使用为匿名访问模式,Hugging Face平台会对请求速率进行限制,适合日常小量使用,不适合大规模的商业应用。

(二)原生格式版本本地部署(基于Python+transformers)

该方法适合熟悉Python开发的用户,需将模型下载至本地,通过Hugging Face的transformers库加载和推理,支持二次开发和定制化使用,可在本地CPU端离线运行,具体步骤:

1. 环境准备

首先在本地电脑安装Python环境(建议3.8及以上版本),然后通过pip命令安装所需的依赖库,核心依赖库包括transformers、torch、tokenizers,打开命令行终端,执行以下安装命令:

pip install transformers torch tokenizers

2. 模型下载与加载

创建Python脚本文件(如tiny_aya_demo.py),通过transformers库的AutoModelForCausalLM(加载文本生成模型)和AutoTokenizer(加载分词器)工具加载模型,代码示例如下(以tiny-aya-base为例):

# 导入依赖库 from transformers import AutoModelForCausalLM, AutoTokenizer # 定义模型ID(Hugging Face平台的模型名称) model_id = "CohereLabs/tiny-aya-base" # 加载分词器 tokenizer = AutoTokenizer.from_pretrained(model_id) # 加载模型,指定device='cpu'强制使用CPU运行 model = AutoModelForCausalLM.from_pretrained(model_id, device='cpu')

首次运行代码时,程序会自动从Hugging Face平台下载模型权重和配置文件,下载完成后会缓存至本地,后续运行无需重复下载。

3. 模型推理与文本生成

在Python脚本中添加文本生成代码,输入任意语言的指令,通过模型生成结果,代码示例如下:

# 定义输入指令(支持任意语言,示例为生成英文旅游文案)

input_text = "Write a short travel copy for Tokyo, simple and lively"

# 对输入文本进行分词处理

inputs = tokenizer(input_text, return_tensors="pt").to('cpu')

# 模型生成文本,可调整max_new_tokens(生成最大长度)、temperature(生成随机性)等参数

outputs = model.generate(**inputs, max_new_tokens=100, temperature=0.7)

# 解码生成结果并打印

generated_text = tokenizer.decode(outputs[0], skip_special_tokens=True)

print(generated_text)4. 运行脚本

在命令行终端中执行Python脚本,即可得到模型的生成结果:

python tiny_aya_demo.py

(三)GGUF格式版本本地部署(基于llama.cpp、CPU离线推理)

该方法适合追求轻量化离线部署的用户,无需Python开发基础,通过llama.cpp框架即可运行,GGUF格式模型支持量化、单文件部署,运行效率更高,具体步骤(以Windows系统为例,Linux/Mac系统操作类似):

1. 环境准备

从llama.cpp的官方GitHub仓库(https://github.com/ggerganov/llama.cpp)下载最新的编译包,或自行编译源码,得到main.exe可执行文件;

在本地电脑创建一个模型文件夹(如TinyAya_GGUF),将main.exe文件放入该文件夹;

从Hugging Face平台下载Tiny Aya的GGUF格式模型文件(如tiny-aya-global-GGUF),将下载后的.gguf文件放入上述模型文件夹。

2. 模型本地推理

打开命令行终端,切换至模型文件夹目录,执行以下推理命令(以tiny-aya-global-GGUF为例):

main.exe -m tiny-aya-global-GGUF.gguf -p "请生成一段简单的中文新年祝福" -n 100 -t 8

命令参数说明:

-m:指定GGUF模型文件的名称;

-p:指定输入的文本指令(支持任意语言);

-n:指定生成的最大token数量;

-t:指定使用的CPU线程数,线程数越高,生成速度越快。

3. 查看结果

执行命令后,终端会实时输出模型的生成结果,无需网络,完全离线运行,生成完成后可直接复制使用结果。

六、常见问题解答

Tiny Aya的核心研发理念是什么?

Tiny Aya的核心研发理念是“Bridging Scale and Multilingual Depth”,即桥接模型规模与多语言深度处理能力,通过3B轻量级参数量设计,在保证多语言文本生成与对话能力的前提下,实现模型对CPU端的适配,打破多语言大模型对高算力GPU的依赖。

Tiny Aya全系列模型的参数量是统一的吗?

是的,Tiny Aya全系列所有模型的参数量均为3B,包括原生格式的base版、四款区域优化版,以及对应的GGUF格式版本,统一的参数量设计保证了全系列模型的硬件适配性和使用体验的一致性。

Tiny Aya支持GPU运行吗?

Tiny Aya的核心设计目标是支持CPU运行,同时其原生格式版本深度兼容PyTorch框架,可通过修改代码将模型加载至GPU端运行,能进一步提升推理速度;GGUF格式版本主要为CPU端优化,部分支持集成显卡的轻量GPU加速。

Tiny Aya的原生版本和GGUF格式版本分别更新于什么时候?

Tiny Aya的原生格式版本(包括tiny-aya-base、tiny-aya-global、tiny-aya-earth、tiny-aya-fire、tiny-aya-water)均在3天前完成最新更新;GGUF格式版本(包括四款区域优化版对应的GGUF版本)均在5天前完成最新更新。

GGUF格式的Tiny Aya模型相比原生版本有什么优势?

GGUF格式的Tiny Aya模型专为本地轻量化离线部署设计,相比原生版本,其优势主要体现在:单文件部署,操作简单;支持模型量化,内存占用更低;采用内存映射技术,加载速度更快;无需Python环境,可通过llama.cpp直接运行;跨语言兼容,支持多种开发语言。

运行Tiny Aya需要什么样的硬件配置?

Tiny Aya支持纯CPU运行,最低硬件配置要求为8GB内存,推荐16GB及以上内存,笔记本、台式机等消费级硬件均可满足;若需提升运行速度,可选择多核CPU,并在运行时开启更多的CPU线程数。

Tiny Aya能实现离线使用吗?

可以,Tiny Aya的原生格式版本和GGUF格式版本均支持本地CPU端离线部署,将模型下载至本地后,可脱离网络和云端算力完全离线运行,有效保障用户的数据隐私和安全。

Tiny Aya支持哪些语言的文本生成与对话?

Tiny Aya的核心能力是“Chat in any language”,即支持任意语言的文本生成与对话,同时CohereLabs还推出了四款区域优化版模型,针对性适配不同语言区域的使用需求,进一步提升了特定区域语言的处理能力。

Tiny Aya的开源协议是什么,是否支持商业使用?

Tiny Aya在Hugging Face平台完全开源,无商业使用壁垒,个人用户、中小企业、开发者等各类主体均可免费将其用于非商业和商业场景,具体可参考Hugging Face平台模型详情页的开源协议说明。

如何获取Tiny Aya的最新版本和更新信息?

可通过访问Tiny Aya在Hugging Face的官方集合页面(https://huggingface.co/collections/CohereLabs/tiny-aya)获取最新的模型版本、更新信息和使用说明,该页面会实时同步CohereLabs的模型更新内容。

Tiny Aya的原生格式版本可以进行二次开发吗?

可以,Tiny Aya的原生格式版本深度兼容Hugging Face生态的transformers、pipeline等工具库,开发者可基于模型进行微调、定制化推理、功能集成等二次开发工作,适配各类多语言AI产品的开发需求。

在使用Tiny Aya在线推理时,出现请求速率限制该如何解决?

Tiny Aya的在线推理为匿名访问模式,Hugging Face平台会进行速率限制,若需解除限制,可注册Hugging Face账号,创建并使用Access Token进行访问,提升请求速率和优先级,具体操作可参考Hugging Face平台的官方文档。

七、相关链接

Tiny Aya官方集合页面(Hugging Face):https://huggingface.co/collections/CohereLabs/tiny-aya

Tiny Aya基础版模型页面(Hugging Face):https://huggingface.co/CohereLabs/tiny-aya-base

Tiny Aya全球多语言版模型页面(Hugging Face):https://huggingface.co/CohereLabs/tiny-aya-global

Tiny Aya-earth版模型页面(Hugging Face):https://huggingface.co/CohereLabs/tiny-aya-earth

Tiny Aya-fire版模型页面(Hugging Face):https://huggingface.co/CohereLabs/tiny-aya-fire

Tiny Aya-water版模型页面(Hugging Face):https://huggingface.co/CohereLabs/tiny-aya-water

Tiny Aya-global-GGUF版模型页面(Hugging Face):https://huggingface.co/CohereLabs/tiny-aya-global-GGUF

Tiny Aya-earth-GGUF版模型页面(Hugging Face):https://huggingface.co/CohereLabs/tiny-aya-earth-GGUF

Tiny Aya-fire-GGUF版模型页面(Hugging Face):https://huggingface.co/CohereLabs/tiny-aya-fire-GGUF

Tiny Aya-water-GGUF版模型页面(Hugging Face):https://huggingface.co/CohereLabs/tiny-aya-water-GGUF

llama.cpp官方GitHub仓库(GGUF格式模型运行框架):https://github.com/ggerganov/llama.cpp

八、总结

Tiny Aya是CohereLabs在Hugging Face平台上线的开源轻量级多语言文本生成模型系列,以“桥接模型规模与多语言深度处理”为核心研发理念,全系列统一采用3B参数量设计,原生支持CPU端运行,突破了传统多语言大模型对高算力GPU的依赖,可在8GB内存以上的笔记本、台式机等消费级硬件上流畅运行,大幅降低了多语言AI技术的使用和硬件成本。该模型推出了原生格式和GGUF格式双版本体系,其中原生格式包含基础通用版和四款区域优化版,3天前完成最新更新,深度兼容Hugging Face生态,支持二次开发和常规本地部署;GGUF格式对应四款区域优化版打造,5天前完成最新更新,继承了GGUF格式单文件部署、量化支持、内存映射等特性,专为本地轻量化离线部署设计,适配不同用户的使用和部署需求。Tiny Aya的核心能力是实现任意语言的文本生成与对话,同时支持离线运行,能有效保障数据隐私,在个人跨语言沟通、中小企业多语言内容生成、教育机构多语言教学、开发者原型验证、边缘设备AI功能集成等场景均有广泛的应用,且该模型在Hugging Face平台完全开源,无商业使用壁垒,为个人用户、中小企业、教育机构、开发者等各类主体提供了普惠、高效、灵活的多语言AI解决方案,是消费级硬件场景下多语言文本生成的优选开源模型。

版权及免责申明:本文由@dotaai原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/tiny-aya.html