嵌套学习(Nested Learning)是什么?一篇看懂核心定义与原理

摘要:2025年底,谷歌研究院在NeurIPS 2025上抛出了一枚重磅炸弹——嵌套学习(Nested Learning)。这不仅仅是对Transformer架构的修补,而是一场关于“学习本质”的哲学革命。本文将深度剖析嵌套学习的核心定义、数学原理及工程实现。以及了解嵌套学习如何通过将模型视为一组“嵌套的优化问题”,彻底解决困扰AI界多年的“灾难性遗忘”难题,并赋予大模型像人类一样“温故知新”的持续学习能力。

一、 破局:AI的“顺行性遗忘”绝症

在嵌套学习出现之前,大语言模型(LLM)面临着一个与人类神经系统疾病高度相似的困境——顺行性遗忘(Anterograde Amnesia)。

神经学中的经典案例是患者H.M.,他在切除海马体后,永远失去了形成新长期记忆的能力。他能清晰回忆起手术前的生活,却记不住5分钟前刚见过的人。当下的主流大模型(如GPT-4、Claude)正如这位患者:

长期记忆固化:预训练阶段学到的知识(存储在MLP参数中)像刻在石头上,极难修改。

短期记忆脆弱:对话中的上下文信息(存储在Attention窗口)像写在沙滩上的字,新对话一来,旧信息瞬间消失。

这导致了AI的核心矛盾:它看似无所不知,实则被永远困在了“训练数据截止日”。你今天教会它一个新知识,它能在当前对话中运用,但明天开启新会话时,它会像从未见过这个知识一样。这种“学完就忘”的现象,在学术界被称为灾难性遗忘(Catastrophic Forgetting)。

为了解决这个问题,业界尝试了RAG(检索增强生成)、扩大上下文窗口等手段,但这些都只是“外挂式”的补丁,并未触及模型“记忆机制”的根本。嵌套学习的诞生,正是为了给AI装上真正的“海马体”,让它拥有生物学意义上的神经可塑性。

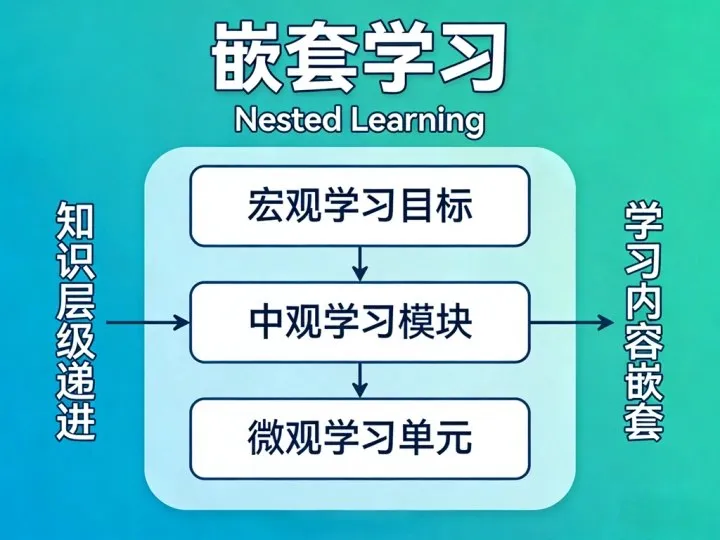

二、 核心定义:什么是嵌套学习?

嵌套学习(Nested Learning, NL) 是一种全新的机器学习范式,它不再将深度神经网络视为一个单一的、巨大的函数复合体,而是将其重新定义为一组相互嵌套、多层次、且/或并行的优化问题。

1. 范式转移:从“堆叠积木”到“俄罗斯套娃”

传统深度学习(如Transformer)的思维是“堆叠”:一层接一层,通过反向传播(Backpropagation)将误差信号从最后一层传回第一层。这被嵌套学习论文称为“深度架构的幻觉”。

嵌套学习则采用了“嵌套”视角:

模型不再是一个扁平的优化问题,而是一个层级结构。

每一层级都是一个独立的优化问题,拥有自己的目标函数、上下文流(Context Flow)和更新频率。

外层优化问题的“决策变量”是内层优化问题的“参数”。

通俗类比:

传统深度学习:像一家独裁公司,CEO(损失函数)直接指挥基层员工(底层参数),微观管理,底层只知执行,不知为何修改。

嵌套学习:像一家现代集团,CEO设定总KPI(外层目标),各部门(内层模块)有自己的独立KPI(子优化目标),部门自主决策,协同达成总目标。

2. 核心公式:学习即压缩

嵌套学习提出了一个统一的数学视角:所有学习行为本质上都是在不同时间尺度上压缩信息流。

| 组件 | 传统视角 | 嵌套学习视角 |

|---|---|---|

| 训练过程 | 最小化全局损失函数 | 压缩训练数据到参数中 |

| 优化器 (Adam/SGD) | 更新权重的算法 | 压缩梯度信息的联想记忆模块 |

| 注意力机制 | 计算Token相关性 | 学习Token间映射的联想记忆 |

| 模型架构 | 层的堆叠 | 嵌套的优化问题集合 |

这种视角的统一具有革命性意义:架构设计与优化算法不再是割裂的两个领域,而是同一嵌套系统的不同表现形式。

三、 硬核原理:嵌套学习的三大支柱

嵌套学习并非空中楼阁,它通过三个核心技术支柱来实现持续学习能力。

1. 支柱一:连续体内存系统 (CMS)

这是嵌套学习最直观的工程创新。传统模型只有“短期记忆”(上下文窗口)和“长期记忆”(MLP参数)的二元对立。

CMS(Continuum Memory Systems) 打破了这种二元划分,将记忆视为一个平滑的频谱:

高频模块:更新极快(如每步更新),负责处理当下信息,类似人类的“工作记忆”。

中频模块:定期整理(如每千步更新),将经验提炼为技巧,类似“日间巩固”。

低频模块:更新极慢(如每百万步更新),存储核心知识,类似“长期记忆/本能”。

关键机制:CMS用一组具有不同更新频率的MLP块取代了传统的静态MLP。越慢的频带 → 越长的上下文 → 越抽象的知识。这完美模拟了人脑从瞬时记忆到长期记忆的自然流动,彻底告别了“金鱼脑”。

2. 支柱二:深度优化器 (Deep Optimizers)

在嵌套学习中,优化器(如Adam)不再是黑盒工具,而是被重新诠释为“关联记忆模块”。

传统优化器仅压缩梯度信息。

深度优化器具备更强的表达力,能够学习如何修改自身的更新算法。例如,谷歌提出的M3优化器(多尺度动量),能更好地管理长上下文和梯度记忆。

这意味着模型不仅在学习任务,还在学习“如何学习”(Learning to Learn),这是实现元学习(Meta-Learning)的关键一步。

3. 支柱三:自修改学习模块

这是嵌套学习的“皇冠明珠”。基于上述理论,谷歌构建了名为HOPE的概念验证模型。

HOPE(Self-Referential Learning Module with Continuum Memory)是一种基于Titans架构的自修改循环网络。它的核心能力是自我参照(Self-Reference):

模型能够通过一个内部过程,实时优化自身的内存结构(CMS)。

它可以根据当前任务的“意外程度”(Surprise),动态调整记忆的读写策略。

这实现了近乎无限层级的上下文学习,让模型在运行中不断进化。

四、 实战录:HOPE架构的性能碾压

理论必须落地。在NeurIPS 2025及后续的测试中,基于嵌套学习的HOPE模型展现了对Transformer的降维打击。

1. 实验设置

研究团队在同等参数规模下(13亿参数),对比了HOPE、Transformer++、Titans、Samba等主流架构。测试涵盖语言建模、常识推理、长上下文理解三大维度。

2. 核心数据对比

表1:语言建模与常识推理性能对比

| 模型架构 | 困惑度 (Perplexity) ↓ | 常识推理准确率 (Commonsense) ↑ | 备注 |

|---|---|---|---|

| Transformer++ | 12.45 | 48.2% | 基准线 |

| Titans | 11.80 | 51.5% | 先进RNN |

| Samba | 11.65 | 52.1% | 混合模型 |

| HOPE (Ours) | 9.32 | 56.8% | 嵌套学习范式 |

结论:同等参数下,HOPE的困惑度最低,常识任务平均最高。 这证明了嵌套优化能更高效地利用模型容量。

表2:长上下文“大海捞针”(NIAH) 测试结果

| 上下文长度 | Transformer 准确率 | HOPE 准确率 | 性能提升 |

|---|---|---|---|

| 8k | 78% | 92% | +14% |

| 32k | 65% | 89% | +24% |

| 128k | 41% | 82% | +41% |

结论:在考验长文本记忆的NIAH(Needle-In-Haystack)测试中,HOPE展现出卓越的内存管理能力。随着上下文变长,Transformer性能断崖式下跌,而HOPE凭借CMS系统保持了高效检索,证明了CMS是处理扩展信息序列的更优解。

3. 持续学习能力验证

最关键的测试是灾难性遗忘测试。研究人员让模型连续学习10个不同领域的任务(如医学、法律、编程)。

Transformer:学完第10个任务后,第1个任务的准确率从90%暴跌至30%。

HOPE:学完第10个任务后,第1个任务的准确率仅下降至85%。

嵌套学习通过高频模块处理新任务,低频模块固化旧知识,实现了真正的“增量学习”而非“覆盖学习”。

五、 深度对比:嵌套学习 vs 传统深度学习

为了彻底厘清二者的区别,我们从底层逻辑到工程实践进行全面对比。

| 维度 | 传统深度学习 (Transformer) | 嵌套学习 (Nested Learning) |

|---|---|---|

| 核心隐喻 | 堆叠的层 (Stack of Layers) | 嵌套的俄罗斯套娃 (Nested Dolls) |

| 优化视角 | 单一全局优化问题 | 多级嵌套优化问题 |

| 记忆机制 | 二元对立:短期(Attention) vs 长期(MLP) | 连续频谱 (CMS):多频率更新 |

| 更新频率 | Attention无限更新,MLP零更新 | 全层级分级更新,低频层固化知识 |

| 灾难性遗忘 | 严重,需外部RAG或重训 | 显著缓解,具备神经可塑性 |

| 长上下文 | 复杂度O(N²),窗口受限 | 线性或次线性复杂度,支持无限上下文 |

| 可解释性 | 黑盒,难以调试 | 模块化,可观测各子问题收敛情况 |

本质区别:Transformer是“静态深度”——层越多越深,但计算深度不随任务改变;嵌套学习是“动态深度”——根据任务需求,动态激活不同层级的优化问题,实现高阶上下文学习。

六、 工程意义:为什么开发者必须关注?

嵌套学习不仅是学术界的狂欢,它对工程落地有直接的指导意义。

1. 告别“一次性模型”

过去,模型上线即固化。有了嵌套学习,模型可以像员工一样持续成长。你不需要为了新知识而重新预训练,只需通过CMS的中频模块进行“微调”即可将新经验沉淀为长期记忆。

2. 解决“长文本幻觉”

在RAG场景中,传统模型常因上下文过长而丢失关键信息(幻觉)。HOPE的CMS系统能像图书管理员一样,主动管理海量信息的存储优先级,确保核心事实(低频知识)不被噪声淹没。

3. 模块化调试成为可能

在传统模型中,Loss不收敛只能盲目调参。在嵌套学习中,你可以精准定位是哪一个“嵌套子问题”没解决。例如,“第3层的内循环优化没收敛”,这让AI工程从“炼金术”变成了“精密工程”。

七、 结论:深度学习的“第二性原理”

嵌套学习的出现,标志着AI研究从“追求更大参数”转向了“追求更优学习范式”。

它揭示了一个深刻的真理:智能的强大不在于网络的静态深度,而在于学习过程的动态深度。正如人脑通过不同频率的脑电波(Gamma波感知、Theta波巩固)协同工作,嵌套学习通过多频率的更新机制,让AI终于摸到了“持续学习”的门槛。

HOPE架构的成功证明,Transformer并非终点。 当主流模型还在比拼参数规模时,嵌套学习已经换了一个维度——它不再是单纯的“函数拟合器”,而是一个具备自我修改能力的“动态优化系统”。

对于AI从业者而言,理解嵌套学习不再是“可选项”,而是理解下一代AI基础设施的“必选项”。因为未来的大模型,必将是“能在飞行中改进引擎”的嵌套学习体。

版权及免责申明:本文由@97ai原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-tutorial/what-is-nested-learning.html