Vid2World:清华重大联合开源的视频扩散模型转高保真交互世界模型

一、Vid2World是什么

Vid2World是由清华大学、重庆大学联合提出、被ICLR 2026接收的通用AI框架,核心目标是将全序列、非因果、被动的视频扩散模型(如SORA、DynamiCrafter类)系统性改造为自回归、可交互、动作条件可控的世界模型。

传统世界模型依赖大量带动作标注的领域数据,生成保真度低、泛化弱;视频扩散模型虽能生成高画质视频,但非因果、无细粒度动作控制,无法用于交互预测。Vid2World通过因果化改造+因果动作引导两大核心技术,打通“被动视频生成”到“主动交互仿真”的壁垒,用互联网海量无标注视频赋能高保真、可扩展的世界建模。

简单说:Vid2World让只会“完整生成视频”的AI,变成能“看历史+听指令、逐帧推演未来”的虚拟世界模拟器。

二、功能特色

1. 因果自回归生成

严格遵循时序因果:生成第t帧仅依赖1~t-1帧历史,无未来信息泄露

支持无限步长推演:长时序预测稳定、误差累积慢

保留视频扩散模型高视觉保真:画面清晰、物理动态真实

2. 帧级动作精准控制

细粒度动作注入:逐帧对齐动作信号,支持机器人关节、游戏操作、导航指令等

动作引导强度可调:通过参数λ灵活控制动作响应强度,平衡可控性与多样性

反事实推理:输入不同动作序列,预测对应未来状态,支持策略对比与优化

3. 低数据依赖、强泛化

复用互联网预训练:基于11亿+参数视频扩散模型(DynamiCrafter),无需从头训练

小样本适配新领域:少量领域交互数据即可快速迁移,大幅降低数据成本

跨领域通用:一套框架适配机器人、3D游戏、开放导航等多场景

4. 高兼容、易扩展

兼容主流视频扩散架构:可迁移DynamiCrafter、Stable Video Diffusion等

支持自定义动作空间:适配机器人、游戏、自动驾驶等不同动作定义

提供完整训练/推理代码:开源模型权重,支持二次开发与部署

三、技术细节

1. 核心挑战

两大技术壁垒:

因果化:标准扩散为双向上下文,需改为纯因果架构支持自回归

动作条件:视频扩散无动作控制能力,需实现帧级精准动作引导

2. 视频扩散因果化(Causalization)

(1)时序注意力因果改造

加入因果掩码:注意力权重仅允许“过去→当前”,禁止“未来→当前”

权重迁移:保留预训练视觉先验,避免从头训练

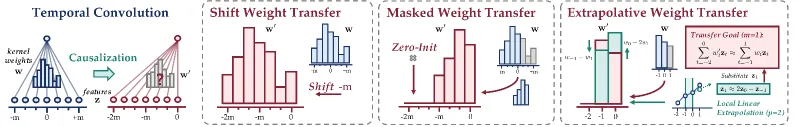

(2)时序卷积因果改造

提出3种权重迁移方案,外推式权重迁移效果最优:

仅使用过去时序卷积核,丢弃未来部分

保持空间特征提取能力,强化时序因果依赖

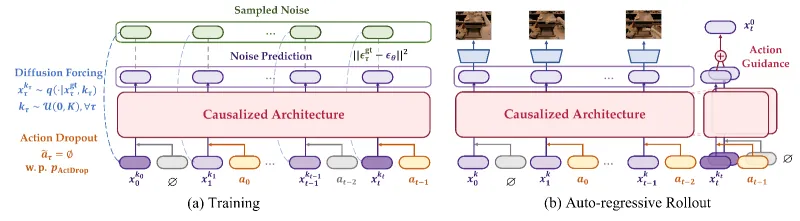

(3)扩散强制训练(Diffusion Forcing)

帧间独立均匀加噪,避免时序依赖泄露

自回归去噪:每帧基于前一帧结果生成,严格因果

3. 因果动作引导(Causal Action Guidance)

(1)动作嵌入与注入

轻量MLP编码器将离散/连续动作转为特征向量

逐帧对齐:预测t帧时,注入t-1时刻动作,时序精准匹配

(2)无分类器动作引导

训练:动作丢弃(Action Dropout),随机屏蔽动作,让模型同时学“有/无动作”两种分布

推理:公式融合得分函数,控制动作影响强度

ϵ_guided = (1+λ)·ϵ_cond − λ·ϵ_uncond

λ=2.5(论文默认):动作响应强、对齐度高

4. 整体技术流程

基础模型:加载预训练视频扩散模型(DynamiCrafter,1.1B/1.4B参数)

因果化改造:修改时序注意力/卷积,加因果掩码

动作模块注入:添加动作编码与逐帧注入层

领域微调:少量目标域数据(机器人/游戏/导航)训练

交互推理:输入首帧+动作序列,自回归生成未来视频

四、应用场景

1. 机器人操作与智能控制

仿真训练:在虚拟环境测试抓取、装配等策略,减少真机试错成本

策略评估:对比不同算法效果,筛选最优方案

Real2Sim:真实场景数据→虚拟仿真→优化策略→真机部署

2. 3D游戏与虚拟仿真

神经游戏引擎:高保真还原CS:GO等游戏动作(开镜、移动、射击)

交互测试:验证角色动作流畅度、物理一致性

内容生成:自动生成游戏剧情动画、交互演示视频

3. 开放世界导航与自动驾驶

环境预测:基于历史观测+驾驶动作,预测未来路况、行人轨迹

决策仿真:测试变道、刹车等策略安全性

多场景泛化:城市、乡村、高速等环境通用

4. 其他扩展场景

数字孪生:工业产线、智慧城市虚拟仿真

影视动画:交互式剧情生成、动作预演

具身AI:虚拟人动作控制、交互对话

五、使用方法

1. 环境准备(Ubuntu 20.04+/AlmaLinux 9.5)

# 创建conda环境 conda create -n v2w python=3.8 -y conda activate v2w # 安装依赖 git clone https://github.com/thuml/Vid2World.git cd Vid2World pip install -r requirements.txt

2. 模型下载

基础模型:DynamiCrafter(320×512/512×896)

Vid2World权重:Hugging Face下载

# 下载模型到checkpoints目录 mkdir -p checkpoints # 下载DynamiCrafter与Vid2World权重(详见GitHub)

3. 推理运行(单卡A100/4090)

# 机器人操作示例 python inference.py \ --config configs/robot/rt1.yaml \ --weight checkpoints/vid2world_robot.pth \ --input assets/robot_first_frame.jpg \ --action_seq assets/robot_actions.npy \ --output outputs/robot_demo.mp4 \ --guidance 2.5

4. 训练(多卡A100)

# 分布式训练 torchrun --nproc_per_node=8 train.py \ --config configs/game/csgo.yaml \ --data_path datasets/csgo \ --batch_size 16 \ --epochs 50

5. 关键参数说明

--guidance:动作引导强度(0~5,默认2.5)--num_frames:生成帧数(16~128)--resolution:输出分辨率(320×512/512×896)

六、竞品对比

| 模型/方法 | 技术路线 | 数据依赖 | 生成保真 | 动作控制 | 领域泛化 | 代表场景 |

|---|---|---|---|---|---|---|

| Vid2World | 视频扩散因果化+动作引导 | 低(互联网预训练+小样本) | 极高(高清、真实动态) | 帧级精准、可调 | 极强(跨机器人/游戏/导航) | 全场景交互仿真 |

| DIAMOND | 扩散模型从头训练 | 极高(大量动作标注) | 中(模糊、时序不一致) | 粗粒度(帧间间隔大) | 弱(单领域专用) | 机器人简单操作 |

| V-JEPA 2 | 掩码视频预测 | 中(海量无标注视频) | 中低(特征级、无高清渲染) | 无直接动作控制 | 中(侧重环境理解) | 环境预测、零样本规划 |

| ControlNet-Video | 条件扩散+姿态控制 | 中(姿态标注数据) | 高(高清) | 姿态级、无时序因果 | 中(创意视频) | 文生视频、姿态迁移 |

核心差异

Vid2World vs DIAMOND:前者**复用预训练、保真更高、数据成本低90%+**;后者需从头训练、依赖标注、泛化差

Vid2World vs V-JEPA 2:前者高清渲染+动作可控+交互仿真;后者侧重特征理解、无高清生成与动作控制

七、常见问题解答

Q1:Vid2World对硬件要求高吗?

A:推理:单卡RTX 4090/3090(24G)可跑320×512分辨率;A100(40G+)支持512×896与长视频。训练:建议8卡A100(40G)分布式训练。

Q2:支持自定义动作空间吗?

A:支持。只需修改动作编码器与数据集接口,适配机器人关节、游戏按键、驾驶指令等任意离散/连续动作。

Q3:生成视频会模糊、抖动吗?

A:因果化与扩散强制训练显著缓解误差累积,128帧内保持高清稳定;长视频(>200帧)可加时序平滑优化。

Q4:可以商用吗?

A:项目采用MIT开源协议,允许学术与商用;基础模型(DynamiCrafter)需遵循其授权协议。

Q5:除DynamiCrafter外,支持其他视频扩散模型吗?

A:支持。框架通用,可迁移Stable Video Diffusion、ModelScope等主流架构,仅需适配时序层接口。

Q6:小样本微调需要多少数据?

A:通常1k~10k条交互序列(视频帧+动作)即可达到良好效果,远低于传统世界模型(100k+)。

Q7:推理速度如何?

A:320×512、16帧:4090约2秒/帧;A100约0.5秒/帧;支持batch推理加速。

八、相关链接

GitHub代码:https://github.com/thuml/Vid2World

Hugging Face模型:https://huggingface.co/collections/thuml/vid2world

九、总结

Vid2World作为ICLR 2026的突破性工作,首次系统性将大规模预训练视频扩散模型转化为高保真、动作可控的交互式世界模型,通过因果化架构改造与因果动作引导两大核心技术,既保留了视频扩散模型在视觉生成上的超高保真度与真实动态,又赋予模型严格的时序因果生成能力与细粒度动作控制能力,同时依托互联网无标注视频的预训练优势,大幅降低了传统世界模型对海量领域标注数据的依赖,实现了在机器人操作、3D游戏仿真、开放世界导航等多领域的SOTA性能,为交互仿真、序列决策、具身AI等领域提供了高效、可扩展、低成本的通用技术方案,打通了从被动视频生成到主动交互世界建模的关键路径。

版权及免责申明:本文由@AI铺子原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/vid2world.html