VRAG:阿里通义开源的多模态RAG框架,支持图文视频统一检索与强化学习推理

一、VRAG是什么

VRAG(Visual Retrieval-Augmented Generation)是阿里巴巴集团通义实验室(Tongyi Lab)开源的多模态检索增强生成框架,代码仓库托管于GitHub(Alibaba-NLP/VRAG),采用Apache-2.0开源协议,主打“视觉感知+多模态检索+强化学习推理”三位一体能力,彻底解决传统RAG仅支持文本、无法高效处理图片/视频、多轮推理能力弱的痛点。

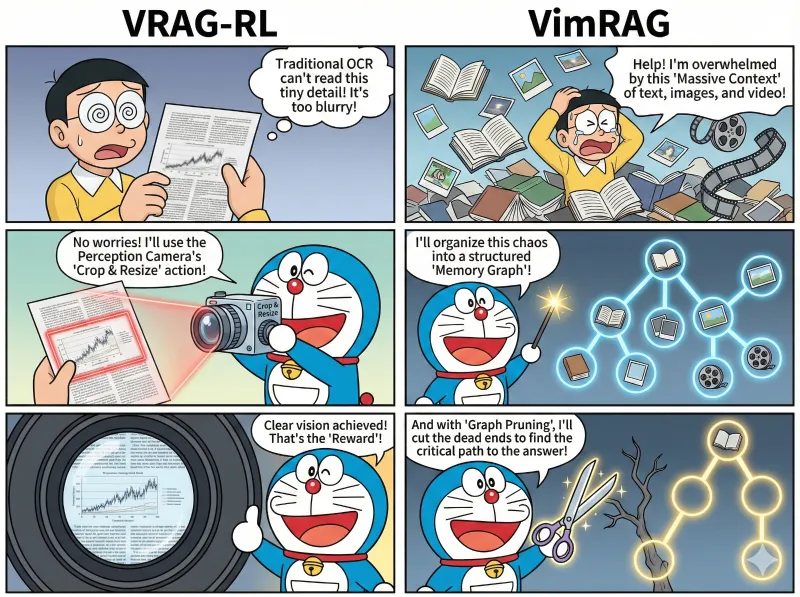

该框架并非单一模型,而是一套完整的多模态RAG开发工具链,核心包含两大分支:VRAG(纯视觉RAG) 专注图片类富文本(图表、文档、截图)的精细化理解;VimRAG(多模态记忆图RAG) 扩展至文本、图片、视频全模态统一检索与推理。同时配套VRAG-RL强化学习训练模块,支持开发者自主优化智能体检索与推理策略,目前已在ViDoSeek、SlideVQA等多模态基准测试中取得SOTA性能。

与传统RAG框架相比,VRAG最大突破是将视觉感知能力深度融入检索流程,不再是简单“图片+文本”拼接,而是让模型像人一样“先看整体、再抓细节、主动检索、逐步推理”,尤其适合信息密集型视觉内容(如PDF文档、科研图表、工程图纸、教学课件、长视频)的智能问答与信息提取场景。

二、核心功能特色

(一)双核心架构,覆盖全场景需求

VRAG:纯视觉精细化RAG智能体

支持从粗到细的视觉迭代推理:先全局浏览图片,再自动定位关键区域(ROI)、裁剪放大、细粒度解析,解决传统模型“看不清细节、读不懂图表”问题。

内置视觉感知动作空间:包含区域选择、缩放、裁剪、OCR识别、特征提取等10+种视觉操作,让模型自主规划视觉信息获取路径。

适配富视觉文档场景:完美支持PDF扫描件、PPT课件、Excel图表、工程图纸、医学影像、网页截图等复杂视觉内容的问答与信息抽取。

VimRAG:全模态统一检索推理框架

三模态兼容:同时支持文本、静态图片、动态视频的检索与理解,打破模态壁垒。

动态多模态记忆图:将所有多模态知识建模为有向无环图(DAG),节点存储语义特征,边关联语义相似度,实现跨模态关联检索。

图引导策略优化(GGPO):动态剪枝冗余记忆节点,聚焦关键证据,大幅提升长视频、长文档的推理效率与准确性。

(二)三大核心能力,构建完整RAG闭环

多模态检索引擎

集成通义GVE-7B、Qwen3-VL-Embedding等SOTA多模态嵌入模型,支持文本-图片-视频双向语义检索。

基于FAISS构建高性能向量库,支持亿级数据毫秒级检索,提供RESTful API接口,可独立部署为检索服务。

支持混合检索策略:文本语义检索+视觉特征检索+OCR文本检索三重匹配,结果更精准。

强化学习训练框架(VRAG-RL)

采用组相对策略优化(GRPO),实现多轮检索推理的端到端优化。

多维奖励机制:融合检索效率(NDCG)、模式一致性、答案质量三大指标,引导模型优化检索路径。

支持自定义训练数据与奖励函数,可适配企业专属场景,持续提升模型性能。

开箱即用交互Demo

基于Streamlit开发可视化界面,支持打字机式推理过程展示、图片裁剪可视化、检索结果高亮。

两种运行模式:VimRAG Demo(调用通义API,轻量快速)、VRAG Demo(本地部署模型,全功能体验)。

支持自定义语料库上传、索引构建、问答测试,零代码快速体验核心能力。

(三)技术优势对比

| 对比维度 | 传统RAG框架 | VRAG框架 |

|---|---|---|

| 支持模态 | 仅文本 | 文本+图片+视频全模态 |

| 视觉处理 | 仅依赖OCR文本,无视觉感知 | 深度视觉感知,粗到细迭代解析 |

| 推理模式 | 单轮检索,固定流程 | 多轮主动检索,动态规划路径 |

| 长内容处理 | 信息丢失,效率低下 | 记忆图管理,精准聚焦关键信息 |

| 优化方式 | 仅提示词/分块优化 | 强化学习端到端训练,持续迭代 |

| 适用场景 | 纯文本问答 | 富文档、图表、视频、复杂推理 |

三、核心技术细节

(一)VRAG:视觉迭代推理技术

视觉感知动作空间

定义标准化视觉操作集合,模型通过输出动作指令自主执行:

区域定位:

[x_min, y_min, x_max, y_max]坐标框选择关键区域尺度变换:缩放、裁剪、旋转,聚焦细节

信息提取:OCR识别、视觉特征编码、文本描述生成

检索决策:判断是否需要补充检索、检索关键词生成

三级推理流程

全局感知:初步分析图片内容,确定核心信息区域

精细解析:对关键区域放大处理,提取细节信息

验证检索:若信息不足,自动生成检索query,补充外部知识

VRAG-RL强化学习机制

状态空间:当前视觉内容、历史推理步骤、已获取信息

动作空间:上述视觉操作+检索操作

奖励函数:

检索奖励:NDCG衡量检索结果相关性

一致性奖励:推理步骤符合逻辑路径

质量奖励:答案准确性、完整性、流畅性

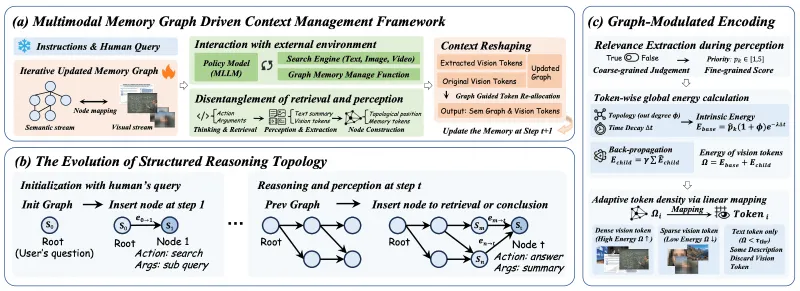

(二)VimRAG:多模态记忆图技术

动态记忆图构建

所有多模态数据(文本/图片/视频)统一编码为语义特征节点

节点间根据语义相似度建立加权边,相似度越高权重越大

支持增量更新:新增数据自动计算关联,无需全量重建索引

图调制视觉记忆编码

基于节点拓扑位置计算重要性评分(类PageRank算法)

高优先级节点分配高分辨率token,低优先级节点压缩或丢弃

动态适配上下文长度,避免长视频/长文档信息过载

图引导策略优化(GGPO)

推理过程建模为动态DAG路径,每一步对应一个记忆节点

实时剪枝冗余节点(无贡献推理步骤),减少计算开销

细粒度信用分配:精准定位有效推理步骤,优化策略梯度

(三)技术栈与架构

开发语言:Python

核心依赖:vLLM(模型加速)、FAISS(向量检索)、Streamlit(Demo)、PyTorch(深度学习)

模型支持:Qwen2.5-VL、Qwen3-VL系列多模态大模型

部署架构:模块化设计,支持检索引擎、推理模型、前端Demo独立部署

四、典型应用场景

1. 企业富文档智能问答

适用:PDF年报、扫描合同、产品手册、工程图纸、PPT课件

能力:精准提取图表数据、解读复杂条款、定位关键信息、多轮问答

价值:替代人工翻阅,提升文档信息获取效率80%+

2. 教育领域智能教辅

适用:教材图片、试卷截图、教学视频、实验图表

能力:题目解析、步骤推导、视频知识点定位、错题分析

价值:打造个性化AI助教,支持自主学习与答疑

3. 科研与医疗信息分析

适用:科研论文图表、医学影像、实验报告、病理图片

能力:数据提取、趋势分析、影像解读、文献关联检索

价值:辅助科研人员快速获取关键数据,提升研究效率

4. 长视频内容理解

适用:课程视频、会议录像、新闻素材、影视片段

能力:跨时间片段检索、关键帧定位、内容摘要、精准问答

价值:解决视频“难检索、难定位”痛点,实现视频内容结构化利用

5. 电商与设计领域

适用:商品详情图、设计图纸、宣传海报、用户评论图

能力:商品参数提取、设计元素分析、图片内容审核

价值:自动化处理海量视觉数据,降低人工成本

五、详细使用方法

(一)环境准备

基础环境

# 创建conda环境 conda create -n vrag python=3.10 conda activate vrag # 克隆仓库 git clone https://github.com/Alibaba-NLP/VRAG.git cd VRAG # 安装依赖 pip install -r requirements.txt

模型部署(二选一)

轻量模式(VimRAG Demo)

配置通义千问API Key:

export DASHSCOPE_API_KEY="your_api_key"

本地模式(VRAG Demo,需A100 80G)

启动vLLM模型服务:

vllm serve Qwen/Qwen2.5-VL-7B-Instruct --port 8001 --host 0.0.0.0 --limit-mm-per-prompt image=10

(二)快速启动Demo

# 1. 启动VimRAG Demo(推荐,轻量快速) ./run_demo.sh vimrag # 2. 启动VRAG Demo(本地模型,全功能) ./run_demo.sh vrag # 3. 仅启动检索引擎服务 ./run_demo.sh search

启动成功后访问 http://localhost:8501 即可使用可视化界面。

(三)自定义检索系统搭建

准备语料库

创建corpus/目录,放入文本(.txt/.md)、图片(.jpg/.png)、视频(.mp4)文件。构建索引

python search_engine/build_index.py --corpus_path ./corpus --index_path ./index

启动检索API

python search_engine/run_server.py --index_path ./index --port 8002

检索接口:http://localhost:8002/search,支持POST请求,参数query(文本)、image(图片base64)。

(四)代码集成调用

from demo.vrag_agent import VRAG

# 初始化智能体

vrag = VRAG(

base_url='http://0.0.0.0:8001/v1', # 模型服务地址

search_url='http://0.0.0.0:8002/search', # 检索服务地址

generator=False

)

# 单轮问答

answer = vrag.run("这张图片中的图表数据是什么?", image_path="./test.jpg")

print(answer)

# 多轮对话

answer1 = vrag.run("第一步操作是什么?", image_path="./flow.jpg")

answer2 = vrag.run("基于第一步,后续步骤有哪些?")(五)VRAG-RL模型训练

cd VRAG-RL # 准备训练数据(参考data/目录示例) # 启动训练 python train.py --config configs/vrag_rl.yaml

六、竞品对比分析

主流多模态RAG框架对比

| 框架名称 | 开发团队 | 核心优势 | 模态支持 | 视觉能力 | 推理模式 | 部署难度 |

|---|---|---|---|---|---|---|

| VRAG | 阿里通义 | 视觉迭代推理、强化学习、全模态记忆图 | 文本+图片+视频 | 极强(粗到细解析) | 多轮主动推理 | 中(需GPU) |

| GraphRAG | 微软 | 知识图谱、全局语义分析 | 仅文本 | 无 | 多跳文本推理 | 中高 |

| LlamaIndex | 开源社区 | 文本索引丰富、生态完善 | 文本+基础图片 | 弱(仅OCR) | 单轮/简单多轮 | 低 |

| LangChain | 开源社区 | 流程编排灵活、工具集成多 | 文本+图片 | 弱(第三方集成) | 流程化多轮 | 低 |

| VideoRAG | 香港大学 | 长视频时序建模 | 文本+视频 | 中(视频帧分析) | 视频时序推理 | 高 |

| LightRAG | 香港中文 | 轻量高效、文本-图片匹配 | 文本+图片 | 中(静态图片) | 单轮检索 | 中 |

核心差异总结

VRAG vs GraphRAG:GraphRAG专注文本知识图谱,无视觉能力;VRAG覆盖全模态,核心优势在视觉理解与多模态关联。

VRAG vs LlamaIndex/LangChain:后两者以文本为核心,图片仅作附加;VRAG将视觉作为核心能力,深度重构检索推理流程。

VRAG vs VideoRAG:VideoRAG仅支持视频+文本;VRAG覆盖三模态,且视觉推理更精细化。

独特性:唯一同时支持“视觉精细化迭代推理+强化学习优化+全模态记忆图”的开源RAG框架,在富视觉文档、长视频场景性能领先。

七、常见问题解答

Q:运行VRAG Demo需要什么硬件配置?

A:VRAG本地Demo需A100 80G显卡支持Qwen2.5-VL-7B模型;VimRAG Demo仅需CPU+网络,调用通义API即可运行。

Q:如何添加自己的图片/视频/文本数据?

A:将数据放入corpus/目录,执行python search_engine/build_index.py重建索引,重启检索服务即可。

Q:检索结果不准确怎么办?

A:1. 检查语料库数据完整性;2. 调整build_index.py中嵌入模型参数;3. 增加数据量,丰富语义覆盖;4. 开启混合检索模式。

Q:VimRAG与VRAG有什么区别,该如何选择?

A:VRAG专注静态图片精细化理解,需本地GPU;VimRAG支持文本+图片+视频全模态,轻量API调用。处理图片选VRAG,多模态混合选VimRAG。

Q:训练VRAG-RL模型需要什么数据?

A:需准备图片-问题-答案三元组数据,格式参考VRAG-RL/data/示例,支持自定义数据集与标注规则。

Q:项目是否支持其他多模态模型?

A:当前默认支持Qwen系列模型,可通过修改vrag_agent.py中的模型调用接口,适配其他开源VLM(如LLaVA、InternVL)。

Q:部署到生产环境需要注意什么?

A:1. 检索引擎与模型服务分离部署,提升并发;2. 配置GPU显存优化(gpu_memory_utilization=0.8);3. 增加日志监控与异常处理;4. 数据加密与权限控制。

八、相关链接

GitHub仓库:https://github.com/Alibaba-NLP/VRAG

VimRAG论文:https://arxiv.org/pdf/2602.12735v1

VRAG-RL论文:https://openreview.net/pdf/facbdeba1c5f4027c295d801ab7c24a818c3957f.pdf

Hugging Face模型集合:https://huggingface.co/collections/Alibaba-NLP/vrag

ViDoSeek基准数据集:https://huggingface.co/datasets/Qiuchen-Wang/ViDoSeek

九、总结

VRAG作为阿里巴巴通义实验室开源的下一代多模态RAG框架,通过视觉感知深度融入、全模态统一管理、强化学习迭代优化、动态记忆图高效推理四大核心创新,彻底突破传统RAG仅支持文本、视觉处理薄弱、长内容推理低效的瓶颈,构建了覆盖“文本-图片-视频”的全链路多模态检索增强生成能力。框架模块化设计完善,提供从部署、Demo体验、自定义开发到模型训练的完整工具链,既支持开发者快速搭建轻量多模态应用,也能满足企业级复杂场景的深度定制需求,在富文档智能问答、教育教辅、科研分析、长视频理解等领域具备广泛应用价值,是当前开源社区中视觉与多模态RAG领域的标杆级项目。

版权及免责申明:本文由@AI铺子原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/vrag.html