ZeroClaw:Rust语言开发的超轻量全自主AI助手部署框架

一、ZeroClaw是什么

ZeroClaw是一款纯Rust编写、零额外开销、无妥协设计的全自主AI助手基础设施,核心定位是为AI智能体(Agent)提供可在任意环境运行、所有核心模块可替换的底层运行时系统。它追求“最小体积、最快速度、最高安全、最强移植性”,让AI助手不再依赖重型运行时、不再受平台绑定、不再消耗大量硬件资源。

ZeroClaw由哈佛、MIT、Sundai.Club社区的开发者共同建设,采用MIT/Apache-2.0双许可证开源,目标是让AI智能体像系统服务一样轻量、稳定、安全地运行在从服务器到嵌入式设备的全场景硬件上。

与传统AI框架不同,ZeroClaw从设计之初就坚持本地优先、单文件分发、模块化插拔、安全内置四大原则,不捆绑任何云服务、不强制依赖外部组件、不牺牲功能换取轻量。它可以理解为:一个可以跑在10美元硬件上的企业级AI智能体运行系统。

二、功能特色

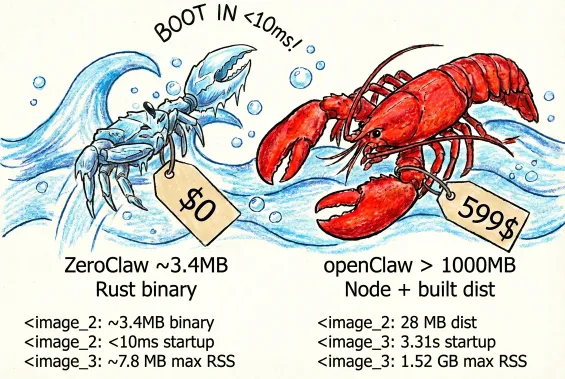

1. 极致轻量化,资源消耗近乎为零

运行内存占用<5MB,相比同类框架降低99%资源消耗

冷启动速度<10ms,在低主频芯片上也能秒级响应

单二进制文件分发,体积约8MB,无依赖、无环境配置

2. 全平台可移植,一次编译随处运行

原生支持ARM、x86、RISC-V三大硬件架构

兼容Linux、macOS、Windows等主流操作系统

支持服务器、虚拟机、开发板、边缘网关等各类设备

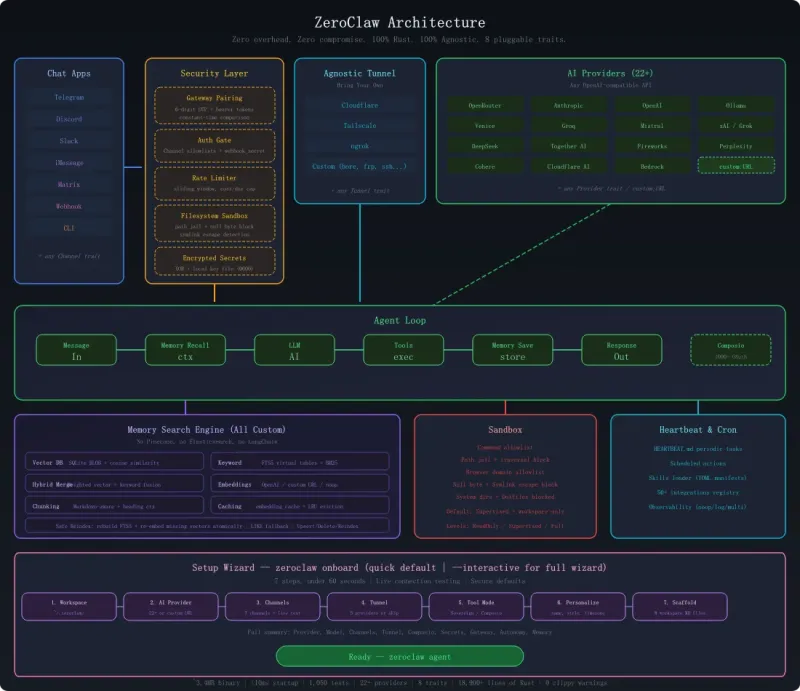

3. 模块化插拔架构,万物可替换

模型层(Provider):支持28+大模型厂商,兼容OpenAI规范

交互层(Channel):支持CLI、Telegram、Discord、Slack、钉钉、飞书、Webhook等20+渠道

工具层(Tool):内置Shell、文件、浏览器、Git、定时任务等能力

存储层(Memory):SQLite本地存储,支持向量+关键词混合检索

所有核心模块基于Rust Trait设计,可独立开发、替换、扩展

4. 安全内置,零信任设计

设备配对机制,防止未授权接入

强沙箱隔离,工具运行权限严格限制

显式权限白名单,禁止越权操作

工作区隔离,数据不跨场景泄露

配置文件加密存储,密钥不落地明文

5. 生产级稳定性

故障自动重启,指数退避重试

运行状态实时监控

配置热重载,不中断服务

日志结构化,便于排查问题

6. 开箱即用,极低上手门槛

提供一键安装脚本bootstrap.sh

交互式配置向导,自动生成配置

多语言文档(英文、中文、日文、俄文)

完整Wiki与部署指南

三、技术细节

1. 技术栈与架构

开发语言:Rust,保证内存安全、无数据竞争、无泄漏

架构模式:Trait驱动插件化,核心组件抽象为统一接口

进程模型:单进程多任务,异步runtime(tokio)

存储引擎:SQLite(本地文件),支持FTS全文检索与向量索引

通信模式:全异步非阻塞,高并发低延迟

2. 核心组件说明

Agent Core:智能体调度中心,负责对话循环、工具调用、记忆管理、指令解析

Provider System:模型接入层,统一封装不同厂商接口,支持负载均衡与熔断

Channel System:消息收发层,适配不同IM与API平台

Tool System:能力执行层,沙箱内执行Shell、文件、网络、自动化操作

Memory System:记忆存储层,混合检索实现长期记忆与快速召回

Security System:权限与隔离层,控制访问范围与操作风险

3. 性能数据(官方基准)

| 指标 | 数值 |

|---|---|

| 运行内存 | <5MB |

| 冷启动时间 | <10ms |

| 二进制大小 | ~8MB |

| 支持架构 | ARM/x86/RISC-V |

| 最低部署成本 | 10美元硬件 |

| 模型支持数 | 28+ |

| 交互渠道 | 20+ |

4. 安全机制详解

配对认证:首次运行生成设备密钥,仅授权客户端可连接

沙箱执行:工具运行在受限环境,禁止访问系统敏感路径

权限最小化:默认关闭所有高危能力,需显式开启

工作区隔离:每个智能体拥有独立目录,不互相干扰

配置加密:密钥与凭证使用ChaCha20Poly1305加密存储

四、应用场景

1. 个人AI助手

本地运行私人助手,数据不上云,隐私完全可控

自动化文件整理、代码编写、信息检索、日程管理

低资源占用,后台长期运行不卡顿电脑

2. 企业私有化部署

内网部署智能客服、运维助手、业务机器人

对接企业内部系统,不泄露数据到公网

低成本横向扩展,大量实例并行运行

3. 边缘与嵌入式设备

在开发板、网关、IoT设备上运行离线AI能力

工业现场数据处理、设备监控、自动化控制

无外网环境下稳定提供智能服务

4. 开发与工具集成

作为IDE插件、CLI工具、自动化脚本的AI引擎

为开发者提供代码生成、调试、文档生成能力

轻量嵌入现有产品,不增加体积负担

5. 多渠道统一交互

一套后端同时支撑微信、钉钉、飞书、Telegram等入口

消息同步、记忆互通、能力一致

降低多平台开发与维护成本

五、使用方法

1. 快速安装

ZeroClaw提供一键安装脚本,适用于类Unix系统(Linux/macOS):

curl -fsSL https://raw.githubusercontent.com/zeroclaw-labs/zeroclaw/main/bootstrap.sh | sh

Windows用户可下载预编译二进制或通过Docker运行。

2. 初始化配置

安装后执行交互式向导:

zeroclaw onboard

按提示完成:

工作区创建

模型厂商选择与API密钥配置

交互渠道启用

智能体名称与身份设定

3. 启动运行

前台运行:

zeroclaw agent run后台运行:

zeroclaw agent start查看状态:

zeroclaw status停止运行:

zeroclaw agent stop

4. Docker部署(推荐生产)

docker run -d \ -v ~/.zeroclaw:/root/.zeroclaw \ -p 3000:3000 \ ghcr.io/zeroclaw-labs/zeroclaw:latest gateway

也可使用docker-compose.yml管理多实例。

5. 配置文件说明

主配置位于:~/.zeroclaw/config.toml

可配置:

模型提供商与参数

渠道凭证与开关

记忆存储路径

安全权限策略

日志与监控选项

六、常见问题解答(一问一答)

ZeroClaw和OpenClaw是什么关系?

ZeroClaw不是OpenClaw的官方版本,也不属于同一组织。它是由社区开发者用Rust从零重写的轻量级实现,定位、架构、代码库完全独立,追求极致轻量化与安全。

ZeroClaw可以在Windows上运行吗?

可以。官方提供Windows预编译二进制包,也支持WSL2与Docker运行,功能与Linux/macOS保持一致。

运行ZeroClaw需要什么配置的机器?

最低配置仅需:单核CPU、64MB内存、100MB磁盘空间。它可以运行在树莓派、廉价VPS、甚至更轻量的边缘设备上。

ZeroClaw支持本地大模型吗?

支持。可通过Ollama、LocalAI等兼容OpenAI接口的本地模型服务接入,实现完全离线运行。

数据会上传到第三方服务器吗?

不会。ZeroClaw默认本地优先,所有对话记录、文件、配置都存储在你自己的设备上,不会主动上传任何数据。

如何添加新的AI模型厂商?

无需修改源码,只需在配置中按规范填写Base URL与API密钥,兼容OpenAI格式的模型均可直接接入。

如何添加新的消息渠道?

官方已内置主流渠道,如需自定义渠道,可基于Channel Trait开发插件,编译后替换即可。

工具调用是否安全?

默认关闭所有高危工具,必须手动在配置中显式开启。Shell等操作受工作区隔离与权限白名单双重限制。

忘记配置密钥或配置损坏怎么办?

可重新执行zeroclaw onboard重新生成配置,原有记忆数据不会丢失。

ZeroClaw支持多智能体吗?

支持。通过多工作区或多配置文件,可同时运行多个独立的智能体,互不干扰。

七、相关链接

八、总结

ZeroClaw是一款以Rust构建、坚持零开销与安全内置的全自主AI助手基础设施,凭借单文件分发、毫秒级启动、低于5MB内存占用、全架构移植、模块化插拔与强安全隔离,成为轻量化与私有化场景下的最优智能体运行时,它既满足个人用户对隐私与流畅度的需求,也适配企业与边缘设备的生产级要求,以极简架构实现了轻量化、安全性、扩展性三者的无妥协平衡。

版权及免责申明:本文由@人工智能研究所原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/zeroclaw.html