OpenClaw 2026 完全指南:开源自托管的主动 AI 助手,重构你的工作流

在AI工具从“对话响应”向“主动执行”演进的浪潮中,OpenClaw 凭借开源自托管、全渠道集成、主动任务执行三大核心优势脱颖而出。它打破了传统AI助手“被动等待指令”的局限,以本地部署为基础,深度融入日常工作流,成为能够自主处理复杂任务的“个人AI操作系统”。本文将从核心定义、功能特色到实操流程,全面解析这款2026年热门开源工具。

一、OpenClaw是什么?

OpenClaw 是一款运行在用户自有设备上的开源自主AI助手,并非简单的聊天机器人,而是具备“执行能力”的智能代理(Agent)。它以“本地优先、隐私可控”为设计理念,通过连接各类通讯平台和工具,实现跨场景任务自动化,真正做到“替用户做事”而非“仅回答问题”。

其核心理念是构建“AI个人操作系统”:无需依赖第三方云服务,所有核心逻辑在本地设备运行,数据存储于私有环境,同时支持多设备协同与高度自定义配置。无论是开发者的代码自动化、职场人的办公流程优化,还是普通用户的生活事务管理,OpenClaw 都能通过灵活适配满足需求。

截至2026年1月,该项目已在GitHub收获10万+星标,Discord社区成员超8900人,成为开源AI领域增速最快的项目之一。

二、OpenClaw更名原因:从品牌合规到理念升级

OpenClaw 的命名经历了三次迭代,背后是项目从个人玩具到成熟开源平台的演进历程:

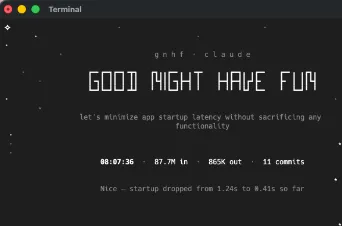

初始命名“Clawd”:源于Claude(AI模型)与claw(龙虾爪)的谐音,致敬Anthropic的Claude模型及其龙虾加载图标,但因可能引发品牌混淆,收到Anthropic法务团队的合规提示。

过渡名称“Moltbot”:“Molt”意为龙虾蜕壳,寓意项目迭代成长,但该名称未充分体现开源核心特质,社区认可度有限。

最终定名“OpenClaw”:“Open”凸显开源协作、开放扩展的项目属性,“Claw”保留初始设计的龙虾意象,既规避品牌风险,又传递“开放赋能”的核心愿景。

更名后,旧版命令clawdbot仍作为兼容性垫片可用,用户可通过简单升级平滑过渡至新版本。

三、OpenClaw主要功能和特色

1. 全渠道无缝通信

无需下载专用应用,直接在常用通讯工具中与AI交互,支持20+主流平台:

原生支持:WhatsApp、Telegram、Discord、Slack、Signal、iMessage、Google Chat等;

扩展支持:Microsoft Teams、Matrix、BlueBubbles等,通过模块化插件持续扩展;

跨渠道协同:在WhatsApp发起的任务可在Telegram继续操作,会话上下文持久化同步。

2. 主动式AI交互

区别于传统AI的“被动响应”,OpenClaw 具备主动触发能力:

定时提醒:基于日历、待办事项发送预约通知;

状态监控:实时监测系统运行、服务器状态,异常时主动告警;

智能推送:每日生成日程简报、天气提醒、优先级任务汇总;

周期任务:通过 cron 作业自动执行重复性工作(如周报生成、文件备份)。

3. 自托管与隐私安全

本地部署:支持macOS、Linux、Windows(需WSL2)、树莓派等设备,数据全程存储于本地,不依赖第三方云服务;

安全防护:默认启用私聊配对验证,未知发送者需授权后才可交互;支持Docker沙箱隔离非主会话,限制高风险工具调用;

远程安全访问:通过Tailscale/Funnel或SSH隧道实现远程控制,强制令牌/密码认证,避免端口暴露风险。

4. 多代理架构与工具集成

多代理协作:支持多个AI代理分工协作,通过

sessions_*工具实现代理间通信,例如“邮件监控代理+日历管理代理+日程协调代理”联动优化时间安排;丰富工具链:集成浏览器控制、文件系统访问、API调用、电子邮件/日历管理、智能家居控制、网页抓取、文档处理等功能;

技能扩展:通过ClawdHub技能市场获取100+社区开发的模块化技能,涵盖生产力、财务、健康、开发等场景,支持用户自定义技能逻辑。

5. 灵活的模型适配

不绑定特定AI模型,支持多种LLM接入:

云端模型:Claude、GPT系列、Google Gemini等,通过API密钥快速对接;

本地模型:兼容Ollama、LM Studio、Harbor等本地LLM运行环境,推荐使用GLM-4.7-Flash等支持工具调用的模型;

模型路由:可根据任务类型(如代码生成、创意写作)自动匹配最优模型。

四、OpenClaw工作原理

OpenClaw 采用“三层核心架构+分布式节点”设计,确保系统的稳定性、扩展性和易用性:

1. 核心架构组成

网关(Gateway):系统的“神经中枢”,运行在本地设备上(默认监听

ws://127.0.0.1:18789),负责会话管理、消息路由、工具编排、安全认证等核心功能;渠道层(Channels):通过Bot API或专用协议连接各类通讯平台,例如WhatsApp依赖Baileys库、Telegram通过grammY框架、Slack使用Bolt框架,实现多渠道消息统一收发;

智能层(LLMs):作为“大脑”处理自然语言理解、推理和任务规划,支持多模型接入,根据用户配置动态选择计算资源。

2. 关键组件分工

Pi Agent:AI代理核心,负责任务拆解、工具调用决策,支持本地/云端模型切换;

Nodes:设备扩展节点,包括iOS/Android移动应用、macOS菜单栏插件等,通过WebSocket与Gateway联动,实现多设备控制;

Canvas:WebView可视化界面,提供图形化配置与操作入口,简化非技术用户的使用流程。

3. 网络通信模式

| 模式 | 核心特点 | 适用场景 |

|---|---|---|

| Loopback | 绑定本地地址127.0.0.1 | 单用户本地使用 |

| Tailscale Serve | 仅限Tailnet内部HTTPS访问 | 家庭/团队内部远程协作 |

| Tailscale Funnel | 提供公共HTTPS访问 | 跨网络共享给指定用户 |

| SSH隧道 | 加密远程连接 | 需从外部设备临时访问 |

五、OpenClaw安装及使用流程

1. 先决条件

运行环境:Node.js ≥ 22(推荐使用npm/pnpm/bun包管理器);

硬件要求:至少4GB RAM(推荐8GB以上),2GB可用存储空间,稳定网络连接;

辅助配置:AI模型API密钥(如Claude、OpenAI)或本地LLM运行环境(如Ollama)。

2. 快速安装步骤

# 1. 全局安装OpenClaw(二选一) npm install -g openclaw@latest pnpm add -g openclaw@latest # 2. 启动引导式安装(自动配置Gateway服务) openclaw onboard --install-daemon # 3. 绑定通讯渠道(以WhatsApp为例,将显示配对二维码) openclaw channels login # 4. 启动Gateway(默认端口18789) openclaw gateway --port 18789 # 5. 远程访问配置(可选,需Tailscale) openclaw gateway --bind tailnet --token <你的Tailscale令牌>

3. 基础配置示例

创建配置文件~/.openclaw/openclaw.json,自定义渠道权限、AI模型、安全策略:

{

"agent": {

"model": "anthropic/claude-opus-4-5", // 默认AI模型

"localModel": "ollama/glm-4.7-flash" // 本地备用模型

},

"channels": {

"whatsapp": {

"allowFrom": ["+1234567890"], // 允许访问的号码白名单

"dmPolicy": "pairing" // 私聊需配对验证

},

"telegram": {

"botToken": "你的Telegram机器人令牌"

}

},

"sandbox": {

"mode": "non-main", // 非主会话启用沙箱

"deniedTools": ["browser", "cron"] // 沙箱禁用的高风险工具

}

}4. 首次使用流程

启动Gateway后,通过已绑定的通讯工具(如WhatsApp)发送消息触发交互;

初始对话示例:

用户:“介绍一下你的功能”

OpenClaw:“我是你的本地AI助手,可帮你管理日程、自动化办公、控制工具等,支持自定义技能扩展,需要我做什么?”

尝试基础任务:发送“生成今日日程简报”“帮我整理下载文件夹”等指令,测试功能可用性;

扩展配置:访问ClawdHub安装所需技能,或通过配置文件自定义任务流程。

5. 安全部署建议

避免将Gateway端口直接暴露到公网,优先使用Tailscale或SSH隧道远程访问;

配置

allowFrom白名单,限制仅信任用户/群组可触发操作;高风险操作(如Shell命令执行)启用手动批准机制,避免自动执行未知指令;

定期更新OpenClaw版本,查看

openclaw doctor输出排查安全隐患。

六、OpenClaw和传统AI助手的区别

| 对比维度 | OpenClaw | 传统AI助手(ChatGPT/Siri/Google Assistant) |

|---|---|---|

| 部署方式 | 本地/自托管,数据私有 | 云端托管,数据存储于服务商服务器 |

| 交互模式 | 主动推送+被动响应,支持持续会话 | 以被动响应为主,会话易中断 |

| 接入渠道 | 20+通讯平台,无需专用APP | 仅限官方APP/网页,渠道单一 |

| 执行能力 | 可操作本地文件、工具、API,实现自动化任务 | 以内容生成/问答为主,缺乏实际执行能力 |

| 扩展性 | 开源架构,支持自定义技能、多代理协作 | 闭源系统,扩展能力有限(如GPTs仅支持简单插件) |

| 模型支持 | 兼容云端/本地多模型,灵活切换 | 绑定专属模型,无法自定义 |

| 隐私保护 | 数据本地存储,支持沙箱隔离、访问控制 | 数据可能用于模型训练,隐私可控性弱 |

核心差异在于:传统AI助手是“对话工具”,而OpenClaw是“执行代理”——它不仅能理解需求,更能主动联动各类工具完成任务,且全程保障数据隐私。

七、常见问题解答

Q1:OpenClaw是免费的吗?

A1:OpenClaw本身基于MIT许可证开源免费,但需承担两类成本:一是AI模型费用(如Claude Pro每月20美元,或OpenAI API按量计费);二是云端部署费用(本地部署无此成本)。典型个人用户每月总成本约25-150美元,具体取决于使用频率和模型选择。

Q2:非技术用户能上手使用吗?

A2:可以。通过openclaw onboard引导式安装向导,无需手动配置复杂参数即可完成基础部署。初始阶段可直接使用社区预制技能,后续可根据需求逐步学习自定义配置,技术门槛较低。

Q3:如何保障使用安全?

A3:核心安全措施包括:启用私聊配对验证、配置用户白名单、非主会话使用Docker沙箱、远程访问强制认证、禁用高风险工具。建议无网络安全经验的用户优先在本地封闭环境运行,避免开放公网访问。

Q4:支持中文交互和国内通讯平台吗?

A4:支持中文自然语言交互,但目前原生支持的通讯平台以海外工具为主(WhatsApp、Telegram等)。国内用户可通过BlueBubbles、Matrix等扩展渠道间接对接微信、钉钉,或选择适配国内生态的替代方案。

Q5:可以替代办公软件或开发工具吗?

A5:OpenClaw是“协作型助手”而非“替代工具”。它能联动办公软件(如Todoist、Asana)和开发工具(如GitHub、Claude Code),自动化重复操作(如生成报告、代码审查),但无法完全替代专业软件的核心功能。

八、相关链接

官方GitHub仓库:github.com/openclaw/openclaw

官方文档:docs.openclaw.ai

安全配置指南:docs.openclaw.ai/security

九、总结

OpenClaw 2026的核心价值,在于打破了“AI仅能对话”的边界,将AI从“云端工具”转变为“本地执行代理”。其开源自托管的架构保障了数据隐私,全渠道集成降低了使用门槛,多代理协作与灵活扩展能力则使其能够适配工作、生活、开发等多场景需求。

对于追求隐私安全、需要自动化处理重复任务的用户而言,OpenClaw 无疑是2026年最值得尝试的AI工具之一。但需注意,其强大的执行能力也伴随着一定安全风险,建议严格遵循安全部署规范,从基础功能开始逐步探索。

随着开源社区的持续迭代,OpenClaw 正推动AI助手从“被动响应”向“主动协作”的范式转变,为个人与团队效率提升提供了全新可能。

版权及免责申明:本文由@AI铺子原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-tutorial/719.html