想免费用阿里超强 AI 视频模型?万相 2.1 本地部署全流程:从环境配置到生成实操

提到“阿里 AI 视频模型”,很多人第一反应是“功能强但可能收费”“需要复杂的云服务权限”,或是“本地部署门槛太高,普通用户玩不转”——但万相 2.1 的开源特性,彻底打破了这些顾虑。作为阿里推出的超强 AI 视频模型,它不仅支持“物理模拟”(让生成的视频物体运动更符合现实规律)和“中英双驱”(中英文文本都能精准生成对应视频),还完全开源免费,任何人都能通过本地部署,零成本使用这一专业级工具。

你可能是自媒体人,想低成本生成高质量视频素材;也可能是 AI 爱好者,想体验顶尖视频模型的生成效果;或是设计师,需要快速产出带物理模拟效果的动态演示——但苦于找不到清晰的本地部署指南,只能对着官方文档里的技术术语犯难。本文就是为你准备的“保姆级攻略”:我们会跳过晦涩的底层原理,把“环境配置、依赖安装、模型启动、视频生成”的每一步都拆解得明明白白,甚至标注出“哪里容易出错”“遇到报错怎么解决”。哪怕你是第一次接触 AI 模型本地部署,只要跟着步骤操作,就能免费用上阿里的万相 2.1,让专业级 AI 视频生成能力,真正落地到你的电脑上。

一、介绍

通义万相 2.1(Wan2.1)是阿里推出的开源视频生成模型,于今年1月发布,凭借在复杂运动生成、物理规律模拟及多语言支持上的突破,成为AI视频生成领域的标杆,甚至超越某些闭源模型。在开源6天后,就登顶全球最大开源社区 Hugging Face 模型热榜与模型空间榜。

通义万相2.1采用自研的高效变分自编码器(VAE)和扩散时间变换器(DiT)架构,通过时空全注意机制增强时空上下文建模能力。其视频编解码方案将视频拆分为若干块(Chunk),缓存中间特征,实现显存消耗与视频长度无关,支持无限长1080P视频生成。

模型能够精准模拟碰撞、反弹、切割等物理现象,并在花样滑冰、游泳等复杂肢体运动中保持动作协调性,避免肢体扭曲,提升视频真实感。

同时,首次支持中文文字生成功能,可结合艺术字特效生成视频,填补了中文视频生成工具的空白。

二、容器构建说明

1. 部署ComfyUI

(1)使用命令克隆ComfyUI

git clone https://github.com/comfyanonymous/ComfyUI.git cd ComfyUI

(2)安装 conda(如已安装则跳过)

下面需要使用 Anaconda 或 Mimiconda 创建虚拟环境,可以输入 conda --version 进行检。下面是 Mimiconda 的安装过程:

下载 Miniconda 安装脚本

wget https://repo.anaconda.com/miniconda/Miniconda3-latest-Linux-x86_64.sh

运行安装脚本

bash Miniconda3-latest-Linux-x86_64.sh

遵循安装提示并初始化

按 Enter 键查看许可证条款,阅读完毕后输入 yes 接受条款,安装完成后,脚本会询问是否初始化 Conda 环境,输入 yes 并按 Enter 键。

运行 source ~/.bashrc 命令激活 Conda 环境

再次输入 conda --version 命令来验证时候安装成功,如果出现类似 conda 4.10.3 这样的输出就成功了。

(3)创建虚拟环境

输入下面命令:

conda create -n comfyui conda activate comfyui

(4)安装pytorch

pip install torch torchvision torchaudio --extra-index-url https://download.pytorch.org/whl/cu121

(5)安装项目依赖:

pip install -r requirements.txt

此时所需环境就已经搭建完成,通过下面命令进行启动:

python main.py

访问网址得到类似下图界面即表示成功:

2. 下载模型

(1)如:下载模型wan2.1

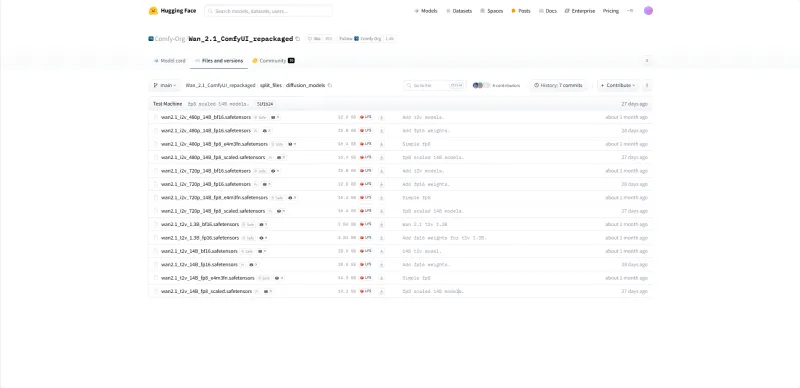

访问 Hugging Face 搜索“Wan_2.1_ComfyUI_repackaged”下载相关模型。首次访问该页面时,可能需要同意用户协议才能看到模型下载页。

模型:

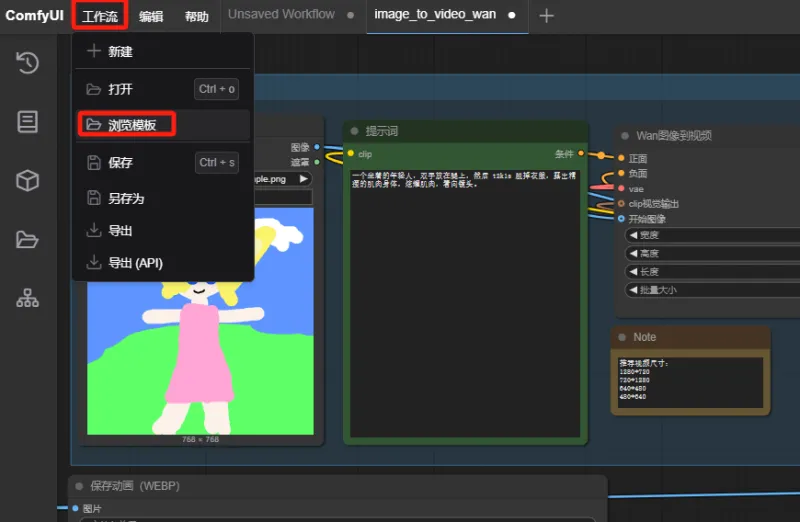

(2)工作流

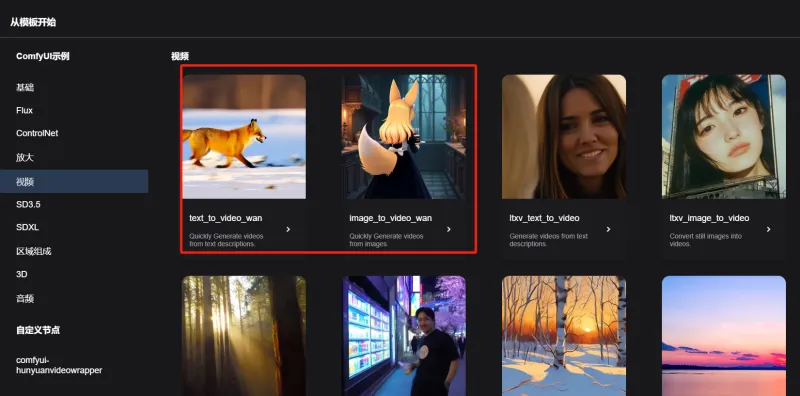

重新启动模型导入工作流即可开始comfyui探索之旅。

总结

本文围绕“零成本使用阿里万相 2.1”的核心需求,完整拆解了从“环境准备”到“视频生成”的全流程:先明确硬件(显卡显存≥8GB)和系统(Windows 10/11、Ubuntu 20.04+)的基础要求,再分步骤讲解“安装 Python 环境、下载开源代码与模型权重、配置依赖包、启动 Web 界面、输入文本生成视频”,每个环节都附带“操作截图标注”和“常见问题解决方案”(如“依赖包版本冲突用 pip 强制指定版本”“显存不足关闭部分非核心功能”),确保不同基础的用户都能顺利完成部署。

部署完成后,你能切实体验到万相 2.1 的两大核心优势:一是“物理模拟的真实感”,生成的物体碰撞、液体流动等效果贴合现实物理规律,避免传统 AI 视频的“违和感”;二是“中英双驱的便捷性”,无需额外翻译,中英文文本都能精准转化为对应语言的语音+字幕+场景视频,适配多语言创作需求。

对于想进一步优化的用户,还可以尝试“调整生成参数提升画质”“自定义模型输出分辨率”“对接本地素材库”等进阶操作,而本文提供的基础流程,已能满足大部分人“免费生成高质量 AI 视频”的需求。希望这篇教程能帮你突破“技术门槛”和“成本限制”,让阿里万相 2.1 真正成为你的创作助力,用免费的开源工具,做出专业级的 AI 视频内容。

版权及免责申明:本文来源于#算家计算,由@dotaai整理发布。如若内容造成侵权/违法违规/事实不符,请联系本站客服处理!该文章观点仅代表作者本人,不代表本站立场。本站不承担相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-tutorial/981.html