Kairos 3.0:大晓机器人开源的具身原生世界模型,物理一致生成与端侧实时推理

一、Kairos 3.0 是什么

Kairos 3.0(开悟世界模型3.0)是由大晓机器人研发、开源的具身原生世界基础模型,面向具身智能、机器人、数字孪生、仿真交互等场景,专注学习真实世界的动态规律、因果关系与物理约束,通过长时序视频生成完成对环境的理解、推演与预测。

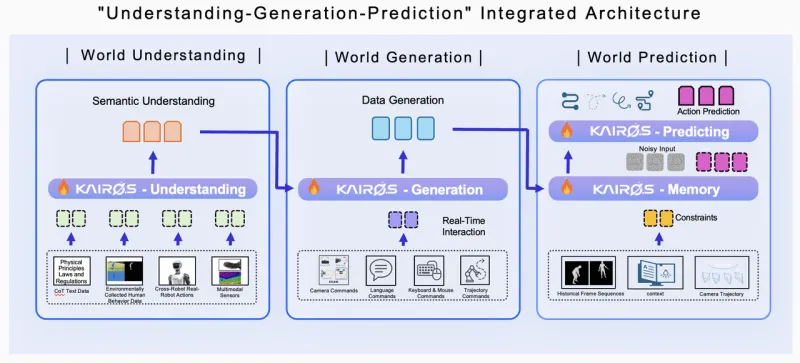

它是行业内首个实现“多模态理解—生成—预测”全链路一体化的开源世界模型,也是首个可在端侧硬件直接驱动机器人本体执行任务的世界模型,突破传统大模型算力消耗大、长时序建模弱、物理一致性差、部署成本高的瓶颈,以轻量化4B参数实现接近实时的推理性能,让具身智能从实验室走向规模化落地。

Kairos 3.0的核心定位是机器人的“世界认知大脑”,不只是生成视频,更能理解物体运动、空间关系、行为因果与物理规则,为机器人提供预演、规划、决策与控制能力,支撑单臂/双臂机器人、灵巧手、人形机器人等多类型硬件的通用泛化。

二、功能特色

1. 物理因果一致生成

模型深度融合物理定律与因果思维链,生成内容符合重力、碰撞、摩擦、运动轨迹等现实规则,避免传统视频模型常见的穿模、形变、逻辑矛盾问题,输出高可信度仿真与预测结果。

2. 超长时序建模能力

支持最长7分钟连续视频生成,保持时序连贯与物理一致,可建模多阶段复杂任务流程,适合长周期任务规划、连续动作预测、动态场景模拟。

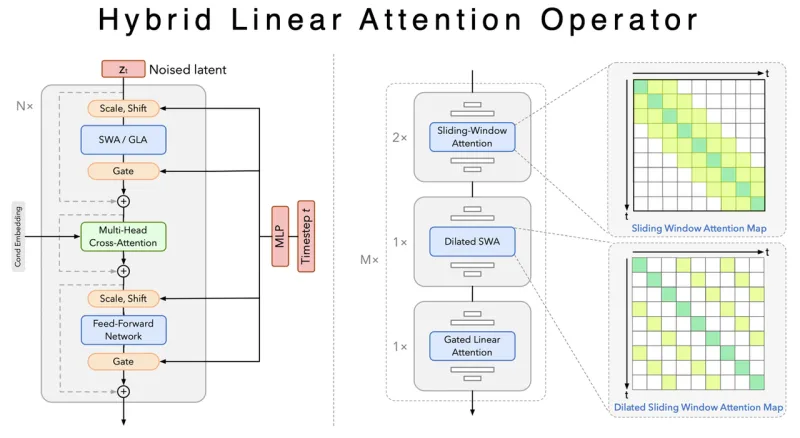

3. 线性时间高效架构

采用创新LinearDiT主干,将时序注意力复杂度从O(n²)降至O(n),同等硬件下推理速度提升约72倍,实现云侧实时生成、端侧低延迟运行。

4. 多模态统一理解

支持文本、图像、视频、3D轨迹、机器人状态等多类型输入,统一编码为世界表征,可完成文本生成视频、图文生成视频、动作预测、任务规划等跨模态任务。

5. 跨具身平台泛化

单一模型原生适配单臂、双臂、灵巧手、人形机器人等硬件,零样本适配Agibot G1、Unitree G1、松灵PIPER等主流平台,大幅降低多机型适配成本。

6. 端侧实时部署

在Jetson Thor T5000端侧平台达到1:1.5实时生成(视频生成时间:视频时长),是业内首个在端侧达成实时级性能的具身世界模型,支持边缘设备独立运行。

7. 轻量化高性能

以4B参数实现接近大参数模型的效果,显存占用低、推理速度快,支持单GPU/多GPU/端侧多种部署方式,降低研发与硬件门槛。

三、技术细节

1. 整体架构

Kairos 3.0基于扩散式世界模型框架,由三大核心组件构成:

高压缩视频VAE(采用WAN2.1 VAE),压缩比达48倍,保留细节同时大幅降低计算量

多模态条件编码器(基于VLM),支持文本、图像、机器人状态等输入编码

LinearDiT时序可扩展主干,混合局部窗口+线性注意力,兼顾长程与效率

2. 核心创新:LinearDiT

滑动窗口注意力(SWA):捕捉局部时序动态,保证动作细节与短期连续

扩张滑动窗口注意力(DSWA):扩大时间感受野,建模中长期依赖

门控线性注意力(GLA):构建全局因果路径,确保长视频逻辑自洽

3. 物理与因果增强

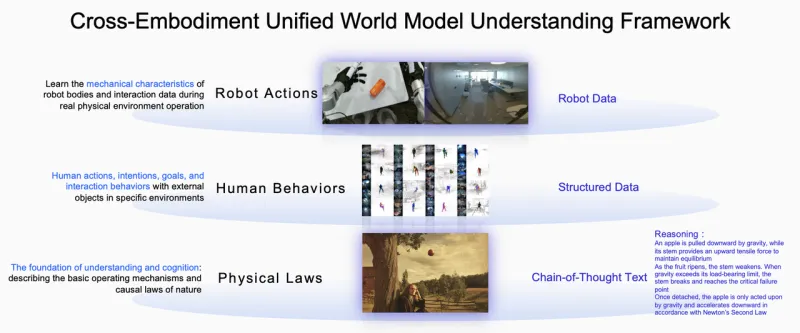

融合三类数据:机器人真机交互数据、结构化人类行为数据、因果思维链数据

内置物理约束模块,在生成过程中强制执行碰撞检测、运动规律、空间一致性

支持因果规划,将复杂任务拆解为可执行子步骤,提升机器人决策可靠性

4. 模型规格(官方Model Zoo)

| 模型版本 | 分辨率 | 参数 | 定位 |

|---|---|---|---|

| kairos-4B 480p | 480P | 4B | 通用基础、下游微调 |

| kairos-4B-robot 480p | 480P | 4B | 机器人控制、实闭环 |

| kairos-4B-robot 480p distillation | 480P | 4B(蒸馏) | 端侧/边缘、低功耗 |

| kairos-4B 720p | 720P | 4B | 高清生成、精细推理 |

5. 性能指标

推理速度:较传统模型提升约72倍

最长视频:7分钟连续时序

端侧性能:Thor平台1:1.5实时生成

压缩比:视频VAE 48倍高保真压缩

四、应用场景

1. 机器人仿真训练

在虚拟环境中生成高保真物理场景,让机器人在仿真中完成学习、试错、优化,减少真机测试成本与风险。

2. 具身智能控制

直接端侧驱动机器人完成抓取、摆放、装配、巡检、服务等任务,实现自主规划与闭环控制。

3. 数字孪生与模拟

构建工业产线、城市交通、家庭环境等数字孪生体,模拟动态变化、预测故障、优化流程。

4. 长视频内容生成

生成符合物理规律的教学演示、工业流程、动作模拟、虚拟实验等视频内容。

5. 自动驾驶与智能体

为自动驾驶、智能体提供环境预测、行为预判、决策预演能力,提升安全性与鲁棒性。

6. 科研与教育

为具身智能、计算机视觉、机器人学提供开源研究平台,支持教学实验、算法验证、创新探索。

五、使用方法

1. 环境准备

支持系统:Linux(推荐)、Windows WSL2

Python版本:3.8及以上

硬件:建议NVIDIA GPU(支持CUDA);端侧支持Jetson Thor系列

2. 安装步骤

克隆仓库

git clone https://github.com/kairos-agi/kairos-sensenova.git cd kairos-sensenova

安装依赖

pip install einops==0.8.1 psutil pip install flash-attn==2.6.3 --no-build-isolation pip install -r requirements/requirements.txt

获取模型权重

从Hugging Face、ModelScope下载官方预训练权重,放置到指定目录。

3. 快速推理

文本生成视频(T2V)

tools/inference.sh configs/kairos_robot_4b/kairos_robot_4b_config.py none examples/kairos_robot/example_t2v.json output/t2v

文本+图像生成视频(TI2V)

tools/inference.sh configs/kairos_robot_4b/kairos_robot_4b_config.py none examples/kairos_robot/example_ti2v.json output/ti2v

4. 部署方式

单GPU推理:适合开发调试、小批量生成

多GPU并行:提升吞吐量,适合大规模仿真

端侧部署:Jetson Thor平台,独立实时控制机器人

Docker部署:官方提供Dockerfile,快速环境隔离部署

六、常见问题解答

Kairos 3.0和普通视频生成模型有什么区别?

Kairos 3.0是具身原生世界模型,核心是理解物理规律与因果关系,面向机器人决策、预测、控制;普通视频模型只追求视觉流畅,不保证物理可信,无法用于机器人实时控制。

运行Kairos 3.0最低需要什么配置?

建议最低配置为NVIDIA GTX 1660 Ti(6G显存),可运行480p轻量化推理;推荐RTX 3090/4090或A10、A100获得最佳速度;端侧使用Jetson Thor T5000。

模型支持哪些机器人平台?

原生支持Agibot G1、Unitree G1、松灵PIPER,并兼容大多数遵循标准控制协议的单臂、双臂、灵巧手、人形机器人,支持自定义适配。

生成视频最长能到多久?

官方支持最长7分钟连续视频,保持时序一致与物理可信;可通过配置调整长度,越长对显存与时间需求越高。

是否支持商用?

项目采用开源协议发布,允许学术与商用使用,具体权限以仓库LICENSE文件为准,建议大型商用前确认协议条款。

如何在端侧Jetson平台部署?

官方提供端侧编译脚本与量化方案,按文档完成环境编译、模型量化、权限配置后,可直接部署并运行实时推理。

推理速度慢怎么办?

可降低分辨率、缩短视频长度、开启蒸馏模型、使用FP16/INT8量化、增加GPU显存或使用多GPU并行,显著提升速度。

支持自定义数据集微调吗?

支持,官方提供微调配置与脚本,可使用机器人交互数据、行业场景数据微调,适配特定任务与硬件。

输入支持哪些模态?

支持纯文本、文本+首帧图像、视频片段、3D轨迹、机器人关节角、场景点云等多类型输入。

Windows系统可以运行吗?

可以,建议使用WSL2搭建Linux环境,流程与Linux一致,性能接近原生Linux。

七、相关链接

Hugging Face模型库:https://huggingface.co/kairos-agi

八、总结

Kairos 3.0是大晓机器人开源的具身原生世界模型,以物理因果一致、线性高效架构、长时序建模、跨具身泛化、端侧实时推理为核心优势,通过LinearDiT、多模态融合、物理约束嵌入等技术,实现“理解—生成—预测”一体化能力,可广泛应用于机器人控制、仿真训练、数字孪生、工业自动化、科研教育等场景,以轻量化设计与开源开放模式降低具身智能研发门槛,为实体机器人与数字智能体提供统一的世界认知基础。

版权及免责申明:本文由@97ai原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/kairos-3-0.html