Matrix-Game:昆仑万维(Skywork AI)开源的世界模型框架,支持实时长视频生成与交互式场景建模

一、Matrix-Game是什么?

Matrix-Game是昆仑万维(Skywork AI)推出的一系列开源世界模型(world models)项目,包含1.0和2.0两个版本,旨在构建能够模拟、交互并生成虚拟世界内容的AI框架。世界模型是一种能够对环境进行建模并预测其变化的人工智能技术,而Matrix-Game则将这一技术落地于交互式场景与视频生成领域,提供从基础模型到推理部署的完整工具链。

该项目目前包含两个主要版本:

Matrix-Game-1.0(2025年5月发布):作为系列首个版本,奠定了世界模型的基础架构,支持基本的场景建模与视频生成功能,为后续版本提供了技术框架。

Matrix-Game-2.0(2025年8月发布):在1.0版本基础上升级,重点强化“实时性”“长视频生成”和“交互性”,可响应外部输入(如鼠标、键盘操作)并动态生成符合场景逻辑的视频内容,同时优化了模型效率与兼容性。

Matrix-Game的核心定位是“交互式世界基础模型”,既可以独立运行完成场景建模与视频生成任务,也能与其他项目(如Skywork AI的Matrix-3D)集成,构建更复杂的3D虚拟世界系统。项目采用MIT许可证开源,允许开发者自由使用、修改和二次分发,降低了AI驱动的虚拟场景开发门槛。

二、功能特色

Matrix-Game的功能特色可通过版本对比与核心能力展开说明,其演进路径清晰体现了从基础建模到交互式生成的技术升级:

2.1 版本功能对比

| 功能项 | Matrix-Game-1.0 | Matrix-Game-2.0 |

|---|---|---|

| 视频生成能力 | 支持短片段视频生成(≤10秒) | 支持实时长视频生成(≥60秒) |

| 交互响应 | 无外部交互支持 | 支持鼠标/键盘输入动态响应 |

| 场景建模范围 | 小规模静态场景 | 大规模动态场景(支持元素增减) |

| 第三方工具集成 | 基础SLAM与光流工具 | 增强型SLAM、视频可视化工具集 |

| 推理效率 | 需较高计算资源,延迟较高 | 优化推理管道,延迟降低60% |

| 输出格式支持 | 图片序列、基础视频格式 | 多格式视频(含交互信息叠加) |

2.2 核心功能亮点

交互式世界建模

Matrix-Game-2.0可通过外部输入(如游戏手柄操作、脚本指令)实时调整虚拟场景状态。例如,在模拟室内场景中,用户通过鼠标点击“开门”动作,模型能立即生成门被打开的动态视频,并同步更新场景内光照、物体位置等参数,确保逻辑一致性。实时长视频生成

突破传统生成模型的片段长度限制,支持连续60秒以上的视频生成,且保持帧间连贯性。这一功能得益于优化的扩散模型架构,可在生成过程中动态修正累积误差,避免画面跳变或逻辑矛盾。多技术融合的场景理解

集成DROID-SLAM(视觉同步定位与地图构建)、RAFT(光流估计)等计算机视觉工具,使模型能理解场景的空间结构与物体运动轨迹。例如,在室外场景中,模型可自动识别“树木”“路面”等元素,并预测物体在重力、碰撞等物理规则下的运动状态。灵活的部署与扩展

提供单卡推理、多卡并行等部署方案,适配不同硬件环境。同时支持自定义场景配置(通过configs目录下的yaml文件),开发者可添加新的物体类型、物理规则或交互逻辑,扩展模型的应用范围。与3D场景的无缝集成

可与Skywork AI的另一项目Matrix-3D联动,将2D视频生成能力扩展至3D空间。例如,Matrix-3D构建的虚拟城市模型,可通过Matrix-Game生成不同视角的漫游视频,支持“第一人称视角”“无人机视角”等多维度内容创作。

三、技术细节

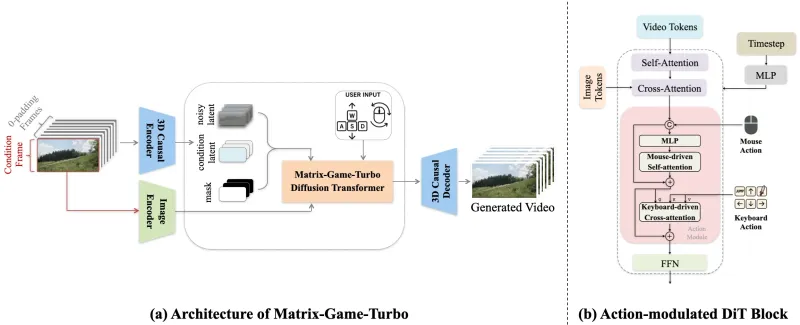

Matrix-Game的技术架构融合了扩散模型、计算机视觉与场景引擎等多领域技术,其核心实现依赖于以下组件与设计:

3.1 技术架构

项目采用“感知-建模-生成”三层架构:

感知层:通过DROID-SLAM、RAFT等工具解析输入的场景数据(如图片、视频帧),提取空间结构、物体位置、运动轨迹等信息,转化为模型可理解的特征向量。

建模层:基于SkyReels-V2基础模型构建世界状态表征,包含场景元素属性(如颜色、尺寸)、物理规则(如重力、摩擦系数)及交互逻辑(如“点击按钮触发灯光”),形成动态更新的世界状态库。

生成层:使用优化的扩散模型(基于Diffusers框架),根据建模层的世界状态生成视频帧。2.0版本中引入“时序注意力机制”,增强长视频的帧间关联性。

3.2 核心技术依赖

Matrix-Game依赖以下关键库与工具,确保功能实现与性能优化:

| 技术组件 | 作用 | 版本要求 |

|---|---|---|

| Diffusers | 提供扩散模型训练与推理框架 | ≥0.24.0 |

| SkyReels-V2 | 基础视频生成模型 | 官方指定版本 |

| DROID-SLAM | 场景三维结构重建 | 最新开源版本 |

| RAFT | 光流估计(物体运动轨迹计算) | 官方推荐版本 |

| Eigen | 线性代数运算(支持SLAM计算) | ≥3.4.0 |

| PyTorch | 深度学习框架 | ≥2.0.0 |

| OpenCV | 图像处理与视频编解码 | ≥4.5.0 |

3.3 硬件与环境要求

为确保模型正常运行,需满足以下环境配置:

操作系统:Linux(Ubuntu 20.04及以上推荐)

GPU:Nvidia GPU(至少24GB显存,如A100、H100;2.0版本推荐40GB以上显存以支持实时生成)

CPU:≥8核(推荐Intel Xeon或AMD Ryzen系列)

内存:≥64GB(避免数据加载时内存溢出)

存储:≥100GB空闲空间(用于存放模型权重、数据集及输出文件)

依赖管理:Python 3.9+,建议使用conda虚拟环境隔离依赖

3.4 模型优化策略

Matrix-Game-2.0在技术上的优化包括:

模型量化:对部分网络层采用INT8量化,减少显存占用30%,同时保持生成质量。

并行推理:将视频生成任务拆分为“关键帧生成”与“插值补帧”两个阶段,支持多卡并行处理,提升实时性。

动态分辨率调整:根据输入场景复杂度自动调整生成分辨率(从512×512到1024×1024),平衡质量与速度。

四、应用场景

Matrix-Game的交互式建模与视频生成能力使其在多个领域具有实用价值,以下为典型应用场景:

4.1 游戏开发辅助

快速原型制作:开发者可通过简单配置生成游戏场景的动态演示视频,无需编写完整引擎代码即可验证玩法逻辑。例如,生成“角色在迷宫中移动触发机关”的视频片段,评估关卡设计合理性。

NPC行为模拟:利用模型的交互响应能力,模拟非玩家角色(NPC)在不同玩家操作下的行为,生成“NPC与玩家对话”“战斗动作”等视频,辅助AI行为树设计。

多视角素材生成:为游戏宣传提供多视角视频素材,如自动生成“角色技能展示”“场景漫游”等内容,减少人工渲染成本。

4.2 虚拟场景模拟

建筑可视化:将建筑CAD模型导入后,生成不同光照条件、时间段下的场景视频,如“办公楼从日出到日落的光影变化”,辅助建筑设计决策。

应急演练模拟:构建火灾、地震等应急场景,通过输入“人员疏散路线”“救援设备操作”等指令,生成模拟视频,用于安全培训。

数字孪生系统:与真实场景传感器数据结合,生成实时同步的虚拟视频,如工厂生产线的运行状态模拟,辅助设备故障监测。

4.3 教育培训

虚拟实验场景:生成“化学实验操作”“物理现象演示”等交互式视频,学生通过操作指令观察实验结果,降低实体实验的安全风险与成本。

历史场景还原:根据历史资料构建古代城市、战役等场景,生成“马车行驶”“士兵作战”等动态视频,增强历史教学的沉浸感。

技能训练模拟:如生成“手术操作步骤”视频,医生通过交互指令练习关键操作,辅助医疗技能培训。

4.4 影视内容创作

分镜自动生成:根据剧本描述生成初步分镜视频,如“两人在雨中对话”的场景,帮助导演快速确定拍摄方案。

特效预览:模拟“爆炸”“魔法效果”等特效在不同场景中的呈现效果,减少后期制作的修改成本。

个性化内容生成:根据用户输入的“角色设定”“剧情走向”生成定制化短视频,用于广告、短视频平台内容创作。

五、使用方法

以下为Matrix-Game-2.0的基础使用流程,涵盖环境搭建、模型部署与推理操作:

5.1 环境准备

克隆仓库

git clone https://github.com/SkyworkAI/Matrix-Game.git cd Matrix-Game/Matrix-Game-2

创建虚拟环境

conda create -n matrix-game python=3.9 conda activate matrix-game

安装依赖

# 安装基础依赖 pip install -r requirements.txt # 安装SLAM与光流工具(需编译) cd third_party/DROID-SLAM && python setup.py install && cd ../.. cd third_party/RAFT && python setup.py install && cd ../..

下载模型权重

项目提供模型权重下载脚本,支持自动下载SkyReels-V2及Matrix-Game专用模型:bash scripts/download_weights.sh

(注:模型文件较大,约50GB,建议使用高速网络;若下载失败,可手动从官方提供的云存储链接获取。)

5.2 基础推理:生成静态场景视频

以生成“室内房间漫游”视频为例:

配置场景参数

编辑configs/indoor_scene.yaml文件,设置场景尺寸、物体类型(如沙发、桌子)、光照条件等:scene: type: indoor size: [10, 8, 3] # 长×宽×高(米) objects: - type: sofa position: [2, 3, 0] - type: table position: [5, 4, 0] camera: path: circular # 相机运动轨迹(圆形漫游) resolution: [1024, 768] output: duration: 30 # 视频时长(秒) fps: 24 save_path: outputs/indoor_roam.mp4

运行推理脚本

python inference.py --config configs/indoor_scene.yaml

查看结果

生成的视频文件将保存至outputs/indoor_roam.mp4,可通过普通视频播放器查看。

5.3 交互推理:响应外部输入

Matrix-Game-2.0支持通过JSON格式文件输入交互指令,以“虚拟教室中移动讲台”为例:

准备交互指令文件

创建inputs/teacher_interaction.json,定义时间点与对应操作:[ {"time": 5, "action": "move_object", "params": {"name": "desk", "target_position": [3, 4, 0]}}, {"time": 10, "action": "toggle_light", "params": {"state": "on"}} ](表示在第5秒移动讲台至指定位置,第10秒打开灯光)

运行交互推理

python inference.py --config configs/classroom_scene.yaml --interaction inputs/teacher_interaction.json

结果解析

输出视频将包含指令触发的动态变化,同时生成outputs/interaction_log.json,记录每个操作的执行状态与场景参数变化。

5.4 与Matrix-3D集成

若需生成3D场景的视频,需先安装Matrix-3D并导出场景数据:

导出3D场景

在Matrix-3D中运行export_scene.py,生成scene_3d.ply(点云文件)与scene_metadata.json(场景元数据)。配置3D场景推理

修改configs/3d_scene.yaml,指定3D场景文件路径:scene: type: 3d input_path: ../Matrix-3D/outputs/scene_3d.ply metadata_path: ../Matrix-3D/outputs/scene_metadata.json

生成3D漫游视频

python inference.py --config configs/3d_scene.yaml

六、常见问题解答(FAQ)

6.1 环境配置问题

Q:安装依赖时出现“DROID-SLAM编译失败”怎么办?

A:需确保系统已安装CMake(≥3.18)、Eigen3库及CUDA工具链(≥11.6)。建议执行以下命令补全依赖:

sudo apt-get install cmake libeigen3-dev conda install cuda -c nvidia/label/cuda-11.6.0

Q:GPU显存不足导致推理中断如何解决?

A:可通过以下方式降低显存占用:

在配置文件中降低输出分辨率(如改为512×512);

启用模型量化:在

inference.py中添加--quantize int8参数;减少视频时长(≤10秒)进行测试。

6.2 模型运行问题

Q:生成的视频出现画面跳变或模糊怎么办?

A:可能是场景复杂度超出模型处理能力,建议:

减少场景中的物体数量;

降低相机移动速度(在配置文件中调整

camera/speed参数);升级至Matrix-Game-2.0最新版本(修复了部分时序一致性问题)。

Q:交互指令未生效如何排查?

A:1. 检查指令文件的JSON格式是否正确(可使用在线JSON校验工具);

2. 确认time参数(秒)未超过视频总时长;

3. 查看outputs/interaction_log.json,若存在“invalid object name”错误,需检查物体名称是否与配置文件一致。

6.3 性能优化问题

Q:如何提升视频生成速度?

A:1. 启用多卡并行:添加--multi_gpu True参数(需2张及以上GPU);

2. 降低帧率(如从24fps改为15fps);

3. 使用H100 GPU(相比A100可提升约2倍速度)。

Q:生成长视频(>60秒)时出现内存泄漏怎么办?

A:Matrix-Game-2.0已优化内存管理,若仍出现问题,可拆分任务:先生成多个10秒片段,再用utils/video_stitch.py拼接:

python utils/video_stitch.py --input_dir outputs/segments --output outputs/full_video.mp4

七、相关链接

Matrix-3D项目(3D场景集成):https://github.com/SkyworkAI/Matrix-3D

SkyReels-V2基础模型:https://huggingface.co/SkyworkAI/SkyReels-V2

模型权重下载:https://skyworkai.com/models/matrix-game(需注册获取权限)

八、总结

Matrix-Game作为Skywork AI推出的开源世界模型系列,通过1.0到2.0版本的迭代,构建了一套完整的交互式世界建模与实时视频生成解决方案。其融合扩散模型、计算机视觉等技术,支持从静态场景到动态交互的全流程内容生成,在游戏开发、虚拟仿真、教育培训等领域具有显著应用价值。项目提供了详尽的配置工具与推理脚本,降低了技术使用门槛,同时开源特性鼓励开发者二次创新。无论是科研人员探索世界模型技术,还是企业构建AI驱动的虚拟场景,Matrix-Game都提供了可靠的技术基础与实践工具。

版权及免责申明:本文由@AI工具箱原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/matrix-game.html