Qwen-Scope:千问专属大模型可解释性 SAE 特征调控工具集

一、Qwen-Scope 是什么

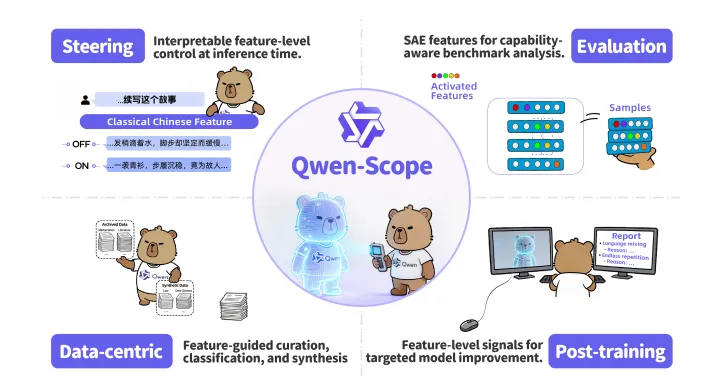

Qwen-Scope 是阿里云通义千问团队推出的大模型可解释性特征调控开源项目,依托稀疏自编码器(SAE) 技术构建,专为 Qwen3、Qwen3.5 全系列大模型打造特征解析、神经元洞察与生成行为调控工具集。

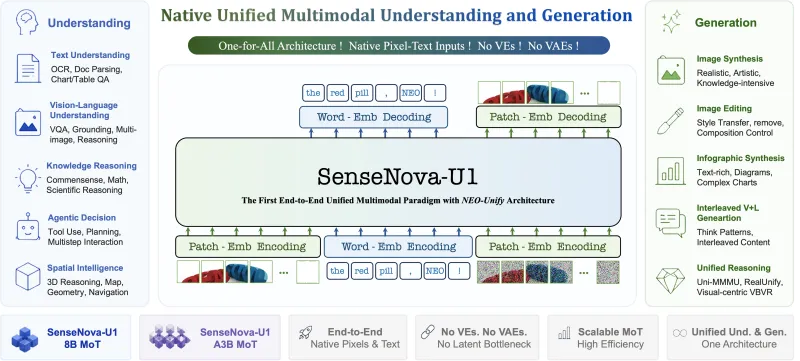

项目核心定位是破解大模型黑箱问题,无需改动模型原有权重,通过预训练 SAE 稀疏特征解码器,精准拆解千问系列模型内部隐藏层神经元语义特征,实现模型思维过程可视化、生成内容可控化、不良倾向可干预,是面向科研研究、模型对齐、安全风控、二次开发的一站式大模型可解释性解决方案。

Qwen-Scope 整合了适配不同参数规模、上下文窗口、特征维度的 SAE 预训练权重,覆盖稠密模型与 MoE 混合专家模型,开箱即用,支持开发者快速接入现有千问模型部署流程。

二、功能特色

全系列千问模型适配

原生兼容 Qwen3、Qwen3.5 主流版本,覆盖从小参数基础模型到大参数 MoE 模型,支持 8K、32K、80K 超长上下文窗口适配。稀疏特征精准解析

基于稀疏自编码器 SAE 拆解模型隐藏层激活特征,精准定位单个神经元、特征簇对应的语义逻辑、知识关联与行为倾向。生成行为可控调控

支持正向强化优质生成特征、抑制有害/冗余特征,可自定义干预模型输出风格、事实偏好、话术逻辑,实现无侵入式模型对齐。开箱即用预训练权重库

内置十余款官方预训练 SAE 权重,按模型规格、上下文长度、L0 特征维度标准化命名,无需从零训练,直接加载部署。轻量化无侵入部署

不修改原生 Qwen 模型结构与权重,以外挂 SAE 解码器方式运行,兼容主流推理框架,部署成本低、适配性强。科研与工程双场景兼容

既满足学术层面大模型机理研究、神经元语义探索,也适配工业场景内容安全风控、定制化风格生成、智能体行为约束。

三、技术细节

3.1 核心底层技术架构

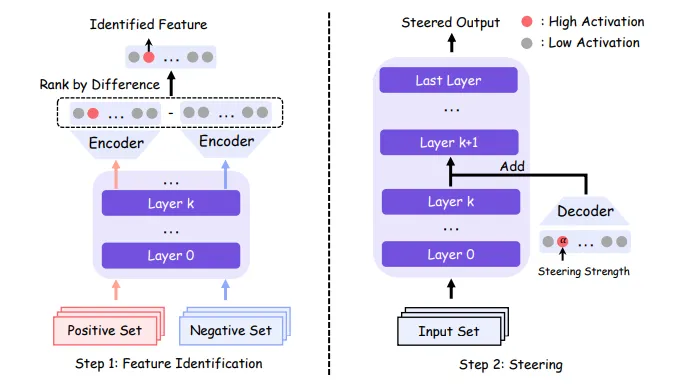

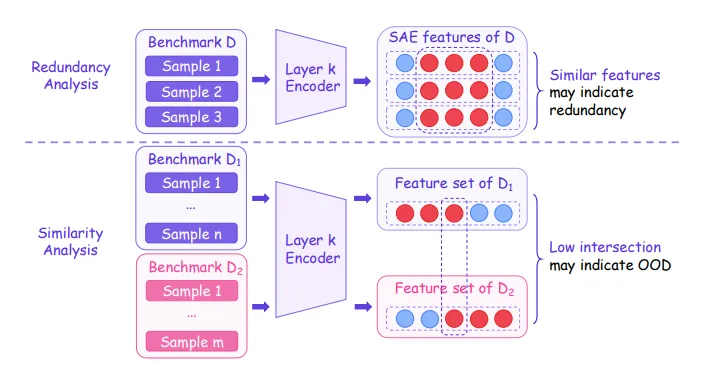

Qwen-Scope 核心采用稀疏自编码器(Sparse Autoencoder, SAE) 作为基础技术范式,工作原理分为两层:

编码阶段:提取 Qwen 模型中间隐藏层激活向量,通过编码器映射到高维稀疏特征空间;

解码阶段:通过解码器还原特征语义,定位每个稀疏特征对应的具体语义、知识片段与生成行为。

3.2 模型权重命名规范

官方统一命名格式:SAE-Res-Qwen版本-参数规模-W上下文长度-L0_特征数

示例:SAE-Res-Qwen3.5-27B-W80K-L0_50

Res:残差适配架构;

W:上下文窗口 Token 长度;

L0:稀疏特征激活阈值,控制特征稀疏度与解析精度。

3.3 适配模型规格一览

| 适配模型系列 | 模型类型 | 覆盖上下文窗口 | 权重数量 |

|---|---|---|---|

| Qwen3 | 稠密/MoE | 8K/32K/80K | 多款可选 |

| Qwen3.5 | 稠密/MoE | 8K/32K/80K | 多款可选 |

3.4 技术运行特性

采用残差连接适配,兼容千问模型原生层结构,避免特征丢失;

稀疏特征采用 L0 正则化约束,平衡解析精度与推理速度;

支持离线特征提取与实时推理特征解析双模式;

原生兼容 PyTorch 推理生态,支持 CUDA 硬件加速。

四、应用场景

大模型机理科研:研究 Qwen 模型神经元语义关联、知识编码逻辑、上下文依赖机制,助力学术论文与模型机理研究。

模型安全对齐:识别并抑制模型幻觉、偏见、有害话术等不良生成特征,低成本实现内容安全风控。

定制化风格调控:固定模型生成风格,如专业文案、学术写作、口语对话、代码生成等专属风格锁定。

智能体行为约束:为基于千问的 AI 智能体设定行为边界,规范指令执行逻辑、避免越界输出。

二次开发与微调辅助:为模型微调提供特征定位依据,精准锁定需要优化的神经元与特征簇,降低微调成本。

教育与科普研究:可视化展示大模型思维逻辑,用于AI教学、技术科普、实训教学场景。

五、使用方法

5.1 环境依赖安装

pip install torch transformers accelerate safetensors

5.2 模型权重拉取

通过 Hugging Face Hub 直接克隆项目仓库:

git clone https://huggingface.co/collections/Qwen/qwen-scope

5.3 基础加载调用流程

加载原生 Qwen3/Qwen3.5 预训练模型;

对应版本加载 Qwen-Scope 官方 SAE 权重;

接入模型隐藏层输出,启用稀疏特征解析;

配置特征抑制/强化规则,实现生成行为调控。

5.4 核心使用流程总结

匹配模型版本与上下文窗口,选择对应 SAE 权重;

挂载至千问模型推理链路;

特征可视化观测神经元语义;

自定义规则配置特征干预策略;

部署到推理服务实现常态化调用。

六、竞品对比

选取同领域大模型可解释性 SAE 工具2款主流产品做横向对比:

| 对比维度 | Qwen-Scope | OpenAI SAE Library | LMSYS SAE Hub |

|---|---|---|---|

| 原生适配模型 | 专属 Qwen3/Qwen3.5 全系列 | 以 GPT 系列为主,开源适配弱 | 多开源通用模型适配,无专属优化 |

| 权重生态 | 官方预训练十余款权重,即取即用 | 多为研究级权重,工程化适配不足 | 社区零散权重,无统一命名规范 |

| 部署侵入性 | 无侵入外挂式,不改动原模型 | 需适配模型层结构,改造成本高 | 通用适配兼容性一般,适配复杂 |

| 工程落地性 | 面向工业安全、风格调控,场景成熟 | 偏学术研究,工程落地适配少 | 偏向社区科研,无官方工程支持 |

| 中文适配能力 | 深度优化中文语义特征解析 | 英文为主,中文特征解析较弱 | 通用适配,中文专项优化不足 |

七、常见问题解答

Qwen-Scope 是否需要重新训练 Qwen 原模型?

不需要。Qwen-Scope 采用外挂 SAE 解码器架构,全程不修改、不微调千问原生模型权重,仅通过解析隐藏层激活特征实现可解释与调控,零侵入即可接入使用。

Qwen-Scope 支持自定义训练专属 SAE 权重吗?

支持。项目开源架构开放,开发者可基于官方基线,针对特定行业场景、专属模型版本,自定义训练适配私有部署的 SAE 稀疏特征权重。

使用 Qwen-Scope 会明显增加模型推理延迟吗?

正常部署场景下延迟增幅可控,官方预训练权重做了推理优化,配合 CUDA 加速可满足线上服务并发需求,仅在高精度全特征解析场景下会小幅提升计算开销。

非 Qwen 系列模型能否使用 Qwen-Scope?

原生仅深度适配 Qwen3、Qwen3.5 系列,其他开源大模型无官方适配权重,强行兼容会出现特征解析失效、语义错位等问题,不建议跨模型通用。

Qwen-Scope 可以用于商业项目落地吗?

项目基于 Hugging Face 开源协议发布,可合法用于企业商业项目、私有部署、风控系统、AI 应用二次开发,遵循对应开源协议约束即可。

八、相关链接

Hugging Face 官方集合页:https://huggingface.co/collections/Qwen/qwen-scope

通义千问官方主页:https://tongyi.aliyun.com/

Qwen 系列模型开源仓库:https://github.com/QwenLM/Qwen3

九、总结

Qwen-Scope 是阿里云通义千问团队推出的专属大模型可解释性开源工具集,以稀疏自编码器为核心技术,深度适配 Qwen3、Qwen3.5 全系列模型,凭借官方预训练权重库、无侵入部署方式、精准的神经元特征解析与生成行为调控能力,兼顾学术科研与工业落地双重需求,相比通用竞品在中文适配、千问模型原生兼容、工程化落地层面具备明显优势,为开发者、科研人员、企业用户提供了低成本拆解大模型黑箱、实现内容安全与定制化生成的完整解决方案。

版权及免责申明:本文由@AI工具箱原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/qwen-scope.html