SenseNova-U1:商汤日日新开源的轻量化MoE多模态AI创作大模型

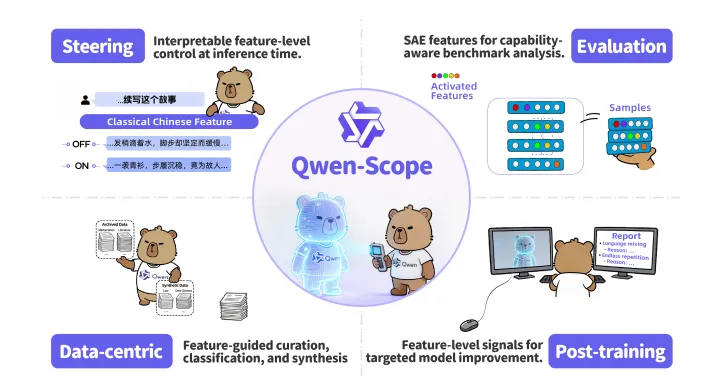

一、SenseNova-U1 是什么

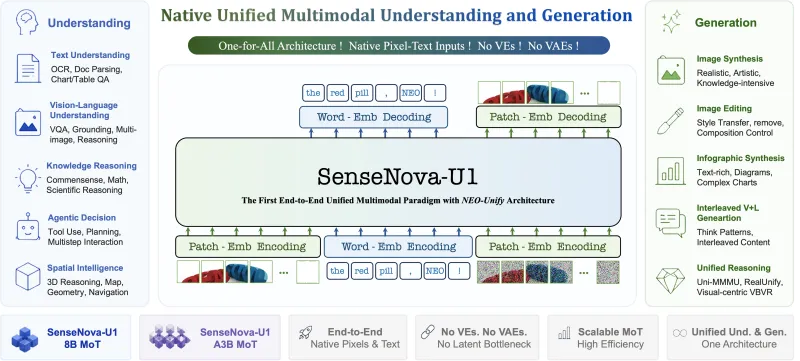

SenseNova-U1 是商汤 OpenSenseNova 团队正式开源的原生统一多模态大模型,依托自研 NEO-Unify 架构打造,打破传统多模态模型“视觉编码器+语言模型”拼接式设计,实现图像、文本双向理解与生成的端到端原生统一建模。

该模型摒弃传统VAE、独立视觉编码器等中间模块,以单一模型基座承载语义理解、逻辑推理、图文生成、视觉编辑等全链路能力,同时推出稠密模型与MoE混合专家双版本,兼顾轻量化部署与高性能推理需求,遵循Apache 2.0开源协议,支持个人学习、二次开发及商业落地使用,是当下开源领域原生统一多模态方向的标杆级项目。

二、功能特色

原生图文统一生成

无需拆分图文生成流程,支持一次性输出文字与配图交错内容,适配游记、教程、科普文案、图文笔记等创作场景,图文逻辑关联度高、风格统一。高密度结构化视觉生成

擅长信息图表、海报设计、简历版式、演示文稿、数据可视化图等高密度信息视觉内容渲染,文字排版、元素布局规整度远超普通文生图模型。多模态逻辑推理与编辑

具备物理规则推理、场景时序推演、逻辑驱动图像编辑能力,可根据文字指令修改图像局部元素、调整场景结构、还原合理物理逻辑。双模型版本适配多场景

提供8B稠密标准版与A3B MoE混合专家版,兼顾普通显卡本地部署与企业级高并发推理,同时配套基础基座版与SFT微调对话版。轻量化便捷部署体验

支持Transformers原生调用、LightLLM高性能推理框架,同时上线SenseNova-Studio在线体验平台,零配置无需GPU即可快速试用。适配具身智能生态

原生兼容视觉-语言-动作VLA、世界建模WM等技术方向,可作为智能体、机器人感知决策的底层多模态基座。

三、技术细节

3.1 核心架构 NEO-Unify

彻底移除传统多模态模型必备的独立视觉编码器VE、变分自编码器VAE,实现像素视觉信息与文本语义信息同维度统一表征。

采用自研 MoT混合Transformer 结构,通过混合注意力机制优化跨模态信息交互,降低文本与视觉模态特征冲突,提升推理效率。

端到端统一训练范式,不再做模态特征后融合,从训练阶段就实现图文特征深度对齐,提升理解精度与生成一致性。

3.2 模型参数规格

| 模型名称 | 架构类型 | 版本分类 | 适配场景 |

|---|---|---|---|

| SenseNova-U1-8B-MoT | 稠密Transformer | 基础版/SFT版 | 本地部署、个人创作、轻量化二次开发 |

| SenseNova-U1-A3B-MoT | MoE混合专家 | 基础版/SFT版 | 企业高并发、复杂推理、商用落地 |

3.3 推理与性能配置

上下文支持最大 32K tokens,满足长文本图文创作、长场景视觉理解需求。

原生适配 LightLLM + LightX2V 推理栈,H100/H200显卡下单图端到端推理耗时约9秒。

兼容主流深度学习生态,可通过Hugging Face Transformers库一键加载权重,无需复杂环境适配。

3.4 开源协议与资源

项目整体采用 Apache 2.0 开源协议,允许自由修改、商用部署、二次分发;目前已开放推理代码、模型权重,后续将逐步开源完整训练代码与技术报告。

四、应用场景

内容创作领域:自媒体图文笔记、科普教程、旅行游记、小说插画一键生成。

设计办公领域:在线海报制作、信息图表生成、简历版式设计、PPT配图自动化创作。

智能交互领域:多模态对话机器人、图文问答系统、知识库视觉检索问答。

行业落地领域:教育课件自动生成、文旅宣传图文制作、电商商品场景图创意生成。

技术研发领域:具身智能机器人感知基座、多模态智能体开发、大模型学术研究二次迭代。

五、使用方法

5.1 在线快速体验

无需本地配置环境,直接进入 SenseNova-Studio 在线平台,上传图片或输入文字指令,即可体验图文生成、图像编辑、多模态问答全功能。

5.2 本地代码部署

克隆项目仓库

git clone https://github.com/OpenSenseNova/SenseNova-U1.git cd SenseNova-U1

安装依赖环境

pip install -r requirements.txt

通过Transformers加载模型推理,支持自定义指令生成图文内容。

5.3 企业级高性能部署

采用 LightLLM + LightX2V 推理组合,适配服务器集群部署,支持多并发请求、批量图文生成,满足商用平台流量需求。

六、竞品对比

选取开源同类型统一多模态大模型 GPT-4o 开源平替版、Qwen-VL-Max、InternVL2 进行核心维度对比:

| 对比维度 | SenseNova-U1 | Qwen-VL-Max | InternVL2 |

|---|---|---|---|

| 架构设计 | 原生NEO-Unify统一架构,无VAE/独立视觉编码器 | 传统编码器拼接架构,模态后融合 | 双流分支架构,图文特征独立编码 |

| 图文交错生成 | 原生支持一次性图文连贯生成 | 需分步骤生成图文,联动性较弱 | 仅支持单图单文本匹配,无交错创作能力 |

| 结构化视觉生成 | 擅长海报、信息图、高密度版式生成 | 通用图文理解强,结构化设计偏弱 | 侧重图像理解,创意生成能力一般 |

| 部署门槛 | 8B轻量化版本适配普通本地显卡 | 大参数版本对GPU显存要求高 | 模型体积大,个人部署成本高 |

| 开源协议 | Apache 2.0 可商用 | 部分版本非完全开源商用受限 | 开源友好但架构冗余度高 |

七、常见问题解答

问:SenseNova-U1 是否可以免费商用?

答:项目整体遵循Apache 2.0开源协议,个人开发者、企业均可免费使用、二次修改及商业落地,无需额外授权费用,仅需遵守协议开源规范即可。

问:普通家用显卡能否本地运行 SenseNova-U1?

答:8B稠密版本对显存要求适中,中端高性能家用显卡可完成基础推理,适合个人学习和轻度创作;A3B MoE版本建议在专业服务器显卡上部署。

问:模型目前支持多长上下文输入?

答:当前版本最大支持32K tokens上下文长度,能够满足长文案创作、多图连贯理解、长逻辑推理等常规需求。

问:是否提供训练代码和技术报告?

答:目前官方已开放推理代码与模型权重,训练完整代码及正式技术报告后续会在GitHub仓库持续更新,可关注项目动态。

问:和传统文生图模型相比有什么核心区别?

答:传统文生图只专注图像生成,文本关联逻辑弱;SenseNova-U1是图文理解+生成原生一体,既能看懂图文内容,又能自动生成逻辑连贯的交错图文,更适合内容创作和办公设计场景。

八、相关链接

GitHub 项目地址:https://github.com/OpenSenseNova/SenseNova-U1

模型地址:https://huggingface.co/collections/sensenova/sensenova-u1

演示地址:https://unify.light-ai.top/

九、总结

SenseNova-U1 作为商汤开源的原生统一多模态大模型,以自研NEO-Unify架构为核心,跳出传统多模态模型拼接式设计思路,实现了文本与视觉信息的端到端统一建模,兼具图文交错生成、结构化视觉创作、多模态逻辑推理等核心能力,同时提供轻量化与MoE双版本适配个人开发及企业商用场景,部署方式灵活、开源协议宽松,覆盖自媒体创作、办公设计、智能交互、行业落地等多元应用领域,凭借精简高效的架构设计和均衡的性能表现,成为开源多模态领域极具实用价值的底层基座项目,也为开发者二次开发和行业多模态应用落地提供了可靠的技术支撑。

版权及免责申明:本文由@AI工具集原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/sensenova‑u1.html