Qwen3.6-35B-A3B:阿里云通义千问开源的轻量高效多模态大模型

一、Qwen3.6-35B-A3B是什么

Qwen3.6-35B-A3B是阿里云通义实验室(通义千问团队)开源的稀疏混合专家(MoE)架构多模态大语言模型,是Qwen3.6系列的首款开源权重版本,采用Apache-2.0开源协议,可免费商用、二次开发与本地部署。

该模型核心设计为“总参数35B,推理仅激活3B”的高效MoE架构(256个专家,每次激活8个路由专家+1个共享专家),在大幅降低算力消耗、显存占用与部署门槛的同时,性能可对标甚至超越27B-31B级稠密大模型。其定位是兼顾轻量高效、智能体编程、多模态理解、超长上下文的全能型开源大模型,面向个人开发者、中小企业、AI研究机构,提供高性价比、易部署的大模型解决方案。

核心基础参数

模型全称:Qwen3.6-35B-A3B

研发团队:阿里云通义实验室(通义千问)

发布时间:2026年4月16日

模型架构:稀疏混合专家(MoE)+ Gated DeltaNet/Attention

参数规模:总参数350亿(35B),激活参数30亿(3B)

上下文窗口:原生支持262,144 tokens(262K),通过YaRN可扩展至1,010,000 tokens(100万+)

模态能力:原生支持文本、图像、视频多模态输入输出

开源协议:Apache-2.0(免费商用、无使用限制)

兼容框架:Hugging Face Transformers、vLLM、SGLang、KTransformers、Ollama、LM Studio等

二、功能特色

Qwen3.6-35B-A3B以“小激活、大性能、全场景”为核心优势,在架构、能力、效率、易用性四大维度实现突破,核心功能特色如下:

1. 极致高效的MoE稀疏架构

算力成本极低:推理仅激活3B参数,算力消耗约为35B稠密模型的1/10,显存占用大幅降低,普通消费级显卡(RTX 4090/5090)4-bit量化即可流畅运行。

推理速度更快:相比同性能稠密模型,推理速度提升10%-20%,响应延迟更低,适合实时交互场景。

硬件门槛友好:

全精度(BF16):建议显存≥80GB(8卡H100/H200)

4-bit量化:显存≥20GB(RTX 4090/5090、AMD 7900 XTX)

8-bit量化:显存≥35GB(专业级显卡/服务器)

CPU推理:内存≥32GB(普通服务器/高配PC)

2. 顶尖级智能体编程(Agentic Coding)能力

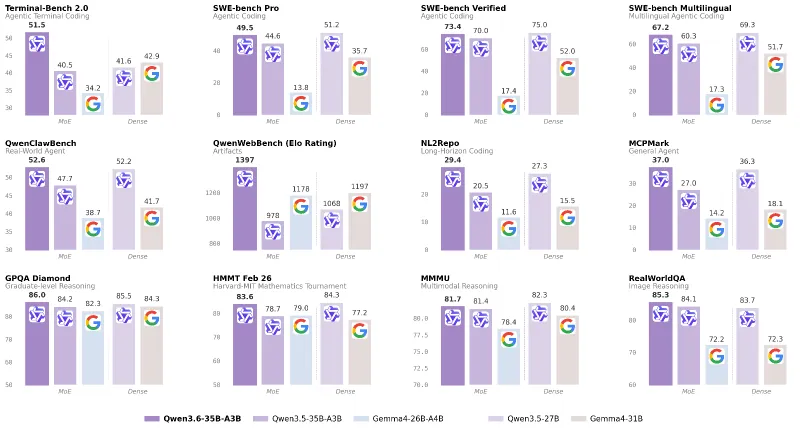

模型核心升级方向,在多项权威编程基准测试中表现超越前代与同级别模型,是当前开源模型中编程能力第一梯队:

核心基准成绩:

SWE-bench Verified:73.4(超越Qwen3.5-35B-A3B、Gemma4-31B)

Terminal-Bench 2.0:51.5(终端编程、命令行执行能力)

QwenClawBench:78.2(真实世界智能体任务能力)

NL2Repo:76.8(自然语言转完整代码仓库)

核心能力:

支持端到端应用开发:从需求分析、架构设计、代码编写、调试到部署全流程

前端/后端/移动端全栈代码生成:HTML/CSS/JS、Python、Java、Go、C++、Swift等

代码理解与重构:读懂百万行级代码仓库,精准定位bug、优化代码逻辑

工具调用与自动化:自主调用Git、Docker、API、终端命令,完成复杂工程任务

3. 原生多模态理解与空间智能

图像理解:支持高清图像输入、OCR文字识别、图表解析、物体检测、视觉问答(VQA),RealWorldQA达85.3、MMMU达81.7。

视频理解:支持短视频/长视频帧分析、内容摘要、动作识别、时序推理,VideoMME达86.6。

空间智能:精准理解图像空间关系、3D结构、位置坐标,RefCOCO达92.0。

文档处理:PDF/Word/Excel/扫描件解析,表格提取、公式识别、文档摘要与问答。

4. 超长上下文与思维保留(Thinking Preservation)

262K原生上下文:可一次性处理**100万字+**文本(整本书、完整代码仓库、长篇文档),无信息丢失、长程记忆精准。

思维保留机制:支持在多轮对话/智能体任务中,完整保留历史思维链与推理过程,避免重复思考,大幅提升复杂任务连贯性与效率。

双模式生成:

思考模式(默认):输出带

...推理链,逻辑清晰、复杂问题准确率更高非思考模式:直接输出结果,响应更快,适合日常问答、简单任务

5. 通用能力与多语言支持

通用推理:数学、逻辑、常识、科学、文学创作能力全面,接近闭源旗舰模型水平。

多语言:支持100+语种(含中文、英文、西班牙语、阿拉伯语等),跨语言翻译、理解、生成流畅自然。

安全性:内置内容安全过滤,合规性强,支持自定义安全规则。

6. 开源生态与易用性

全平台兼容:支持Windows、macOS、Linux、服务器、云平台部署。

即插即用:兼容OpenAI API接口,可直接替换现有OpenAI应用,无需修改代码。

工具链丰富:适配Qwen-Agent、Qwen Code、OpenClaw、Claude Code等智能体工具,快速构建AI应用。

三、应用场景

Qwen3.6-35B-A3B凭借轻量高效、全模态、强编程、长上下文的特性,覆盖个人开发、企业生产、学术研究、垂直行业等全场景,核心应用场景如下:

1. 软件开发与AI智能体

AI编程助手:个人开发者/程序员的智能编码工具,自动生成代码、调试bug、优化性能、生成注释。

智能体开发:构建自主AI智能体(Agent),完成自动化测试、部署运维、数据处理、爬虫、API集成等任务。

低代码/无代码平台:为低代码平台提供AI驱动,自然语言生成应用、页面、功能模块。

代码仓库管理:分析大型代码库、生成技术文档、自动更新依赖、代码审查。

2. 多模态内容创作与处理

图文/视频创作:根据文本生成图像描述、视频脚本、文案,或根据图像/视频生成内容、摘要、解说。

设计辅助:UI/UX设计需求分析、生成设计稿描述、解读设计图、生成前端代码。

文档处理:企业合同、报告、标书、论文的撰写、校对、摘要、翻译、格式转换。

3. 企业级应用与数字化转型

企业知识库问答:搭建内部AI客服、知识库助手,精准回答员工/客户问题,支持百万级文档检索。

数据分析师助手:解读数据报表、生成SQL、分析业务数据、撰写数据分析报告。

教育/培训:智能教辅、作业批改、知识点讲解、个性化学习方案、编程教学。

法律/金融/医疗:法律文书撰写、金融研报分析、医疗文档解读(合规前提下)。

4. 本地私有化部署场景

中小企业私有化AI:无需依赖云API,本地部署保障数据安全、降低长期成本。

离线AI应用:无网络环境(工厂、偏远地区、涉密场景)下的AI服务。

边缘计算:边缘设备(服务器、工控机)部署,低延迟、高可靠的本地AI能力。

5. 学术研究与模型二次开发

大模型研究:MoE架构、稀疏推理、多模态、长上下文的学术研究基础。

垂直领域微调:在医疗、法律、教育、工业等领域微调,打造行业专用大模型。

开源生态贡献:基于Qwen3.6-35B-A3B开发新模型、工具、应用,丰富开源AI生态。

四、使用方法

Qwen3.6-35B-A3B提供在线体验、本地部署、API调用三种使用方式,适配不同用户需求,操作简单、门槛极低。

1. 在线体验(零门槛,无需部署)

直接在官方平台交互测试,适合快速了解模型能力:

魔搭社区(ModelScope):https://modelscope.cn/models/qwen/Qwen3.6-35B-A3B/summary

Hugging Face:https://huggingface.co/Qwen/Qwen3.6-35B-A3B(在线对话Demo)

2. 本地部署(推荐开发者/私有化场景)

方式1:Ollama(最简单,一行命令)

适合Windows/macOS/Linux个人用户,无需配置环境:

# 1. 安装Ollama:https://ollama.com/

# 2. 终端执行(自动下载模型,约21GB)

ollama run qwen3.6:35b-a3b

# 3. 关闭思考模式(更快)

ollama run qwen3.6:35b-a3b --chat-template-kwargs '{"enable_thinking":false}'方式2:vLLM(高性能,企业级)

适合服务器/高性能设备,支持高并发、OpenAI API兼容:

# 1. 安装vLLM

uv pip install vllm --torch-backend=auto

# 2. 启动服务(8卡张量并行,262K上下文)

vllm serve Qwen/Qwen3.6-35B-A3B \

--port 8000 \

--tensor-parallel-size 8 \

--max-model-len 262144 \

--reasoning-parser qwen3

# 3. 仅文本推理(省显存)

vllm serve Qwen/Qwen3.6-35B-A3B \

--port 8000 \

--language-model-only

# 4. API调用(兼容OpenAI)

curl http://localhost:8000/v1/chat/completions \

-H "Content-Type: application/json" \

-d '{

"model": "Qwen/Qwen3.6-35B-A3B",

"messages": [{"role": "user", "content": "写一个Python爬虫"}]

}'方式3:LM Studio(图形界面,小白友好)

适合无命令行基础用户,可视化操作:

安装LM Studio:https://lmstudio.ai/

搜索

Qwen3.6-35B-A3B,下载Q4_K_M量化版(约21GB)加载模型后,在内置对话界面直接使用,支持上传图像

方式4:SGLang(极致推理加速)

适合追求最高性能、长文本场景:

# 启动加速服务 python -m sglang.launch_server \ --model-path Qwen/Qwen3.6-35B-A3B \ --port 8000 \ --tp-size 8 \ --reasoning-parser qwen3 \ --speculative-algo NEXTN

3. 云API调用(阿里云百炼)

适合无硬件、需高可用服务的企业用户:

模型名称:

qwen3.6-flash兼容OpenAI/Anthropic API,支持

preserve_thinking思维保留功能

4. 模式切换(思考/非思考)

开启思考模式(默认,复杂任务):

enable_thinking=true关闭思考模式(快速响应):

enable_thinking=false

五、竞品对比

选取当前主流开源大模型:Gemma 4-31B(谷歌)、Qwen3.5-35B-A3B(通义千问前代)、DeepSeek-R1(深度求索)进行对比,Qwen3.6-35B-A3B在效率、编程、多模态、上下文四大维度全面领先。

| 对比维度 | Qwen3.6-35B-A3B | Gemma 4-31B | Qwen3.5-35B-A3B | DeepSeek-R1 |

|---|---|---|---|---|

| 研发团队 | 阿里云通义实验室 | Google DeepMind | 阿里云通义实验室 | 深度求索 |

| 架构类型 | MoE(35B总/3B激活) | 稠密(31B全激活) | MoE(35B总/3B激活) | 稠密(33B全激活) |

| 开源协议 | Apache-2.0(免费商用) | Apache-2.0 | Apache-2.0 | Apache-2.0 |

| 上下文窗口 | 262K原生/1M扩展 | 131K | 128K | 128K |

| 多模态能力 | 原生(文本+图像+视频) | 原生(文本+图像) | 原生(文本+图像) | 仅文本 |

| SWE-bench Verified | 73.4 | 68.2 | 65.7 | 69.1 |

| Terminal-Bench 2.0 | 51.5 | 45.3 | 42.8 | 46.7 |

| 显存需求(4-bit) | 20GB | 35GB | 20GB | 33GB |

| 推理速度 | 极快(10%-20%领先) | 中等 | 快 | 中等 |

| 思维保留 | ✅ 支持 | ❌ 不支持 | ❌ 不支持 | ❌ 不支持 |

| 视频理解 | ✅ 支持 | ❌ 不支持 | ❌ 不支持 | ❌ 不支持 |

| 核心优势 | 高效、强编程、多模态、长上下文 | 通用能力均衡、多语言 | 稳定、性价比高 | 数学、代码能力强 |

对比结论:Qwen3.6-35B-A3B是当前30B级开源模型中综合性能最强、效率最高、功能最全面的选择,以3B激活参数实现超越31B稠密模型的性能,部署成本仅为同类模型的60%,同时独家支持思维保留、视频理解、百万级上下文扩展三大核心能力,是开发者与企业的最优开源大模型选型。

六、常见问题解答

Qwen3.6-35B-A3B可以免费商用吗?

可以。模型采用Apache-2.0开源协议,完全免费,允许商业使用、二次开发、修改、分发,无任何授权费用与使用限制。

普通个人电脑能运行Qwen3.6-35B-A3B吗?

可以。4-bit量化版本仅需20GB显存(RTX 4090/5090、AMD 7900 XTX)或32GB内存(CPU推理),当前主流高配PC/游戏本即可流畅运行。

Qwen3.6-35B-A3B和Qwen3.5-35B-A3B有什么区别?

Qwen3.6-35B-A3B是全面升级版本:智能体编程能力提升15%+、支持思维保留、原生视频理解、上下文从128K扩展到262K、多模态性能大幅提升、推理速度更快、稳定性更强。

模型量化后会影响性能吗?

4-bit/8-bit量化会导致轻微性能损失(约3%-5%),但远低于算力与显存的节省幅度,日常使用、开发、企业场景几乎无感知;全精度(BF16)适合追求极致性能的研究场景。

如何开启/关闭思考模式?

本地部署时,在启动参数添加--chat-template-kwargs '{"enable_thinking":true/false}';API调用时在请求参数中配置enable_thinking。

Qwen3.6-35B-A3B支持微调吗?

支持。可使用Hugging Face Transformers、Unsloth、LoRA等工具进行全参数微调或高效微调,适配垂直行业场景。

模型支持哪些编程语言?

支持所有主流编程语言:Python、Java、JavaScript/TypeScript、C/C++、Go、Rust、PHP、Swift、Kotlin、SQL等,尤其擅长全栈开发与复杂工程代码。

多模态输入支持哪些格式?

图像:JPG、PNG、BMP、WEBP;视频:MP4、AVI、MOV(帧采样分析);文档:PDF、DOCX、XLSX、TXT。

本地部署时模型文件多大?

全精度(BF16):约70GB;4-bit量化:约21GB;8-bit量化:约35GB。

Qwen3.6-35B-A3B有中文优化吗?

有。中文理解、生成、编码能力是核心优势,在中文语义、文化、语法、专业术语上表现远超国际模型。

七、相关链接

Hugging Face模型主页:https://huggingface.co/Qwen/Qwen3.6-35B-A3B

魔搭社区(ModelScope):https://modelscope.cn/models/qwen/Qwen3.6-35B-A3B

官方GitHub仓库:https://github.com/QwenLM/Qwen3.6

八、总结

Qwen3.6-35B-A3B是阿里云通义千问团队打造的里程碑级开源大模型,以MoE稀疏架构实现“3B激活参数、35B级性能”的颠覆性突破,在智能体编程、多模态理解、超长上下文、推理效率四大核心维度建立行业领先优势,同时凭借Apache-2.0开源协议、低硬件门槛、全平台兼容、完善生态与工具链,成为当前开源大模型中性价比最高、适用性最广、最易工程化落地的选择。它不仅为个人开发者提供了可本地运行的旗舰级AI能力,更为中小企业、研究机构、垂直行业提供了低成本、高安全、私有化的大模型解决方案,有效降低了AI技术的应用门槛,推动开源大模型生态向更高效、更普惠、更全能的方向发展,是2026年开源AI领域的核心标杆产品。

版权及免责申明:本文由@AI工具集原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/qwen3-6-35b-a3b.html