RoboBrain-X0:跨实体机器人智能框架,实现零样本泛化与复杂任务分解

1. RoboBrain-X0是什么

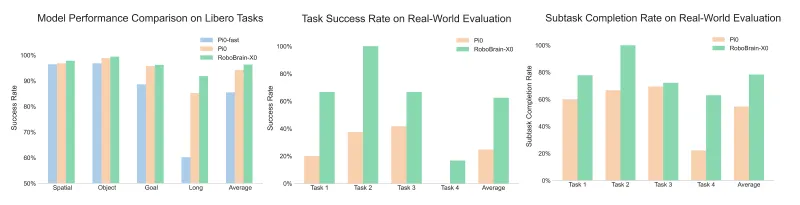

RoboBrain-X0 是一个突破性的跨实体机器人智能框架,旨在克服单机器人系统在异构实体迁移中的局限性。它通过统一的动作词汇表和先进的动作令牌化技术,实现了在不同机器人平台间的高效迁移学习和任务执行。本项目支持多种机器人平台(如AgileX、R1-Lite双臂轮式机器人、Franka单臂系统等),能够处理多模态输入并生成精确的控制指令,为复杂环境下的机器人应用提供了强大的智能支持。

传统的机器人控制系统通常针对特定硬件平台进行定制开发,难以在不同类型的机器人之间共享知识和技能。RoboBrain-X0 通过以下创新方法解决了这一挑战:

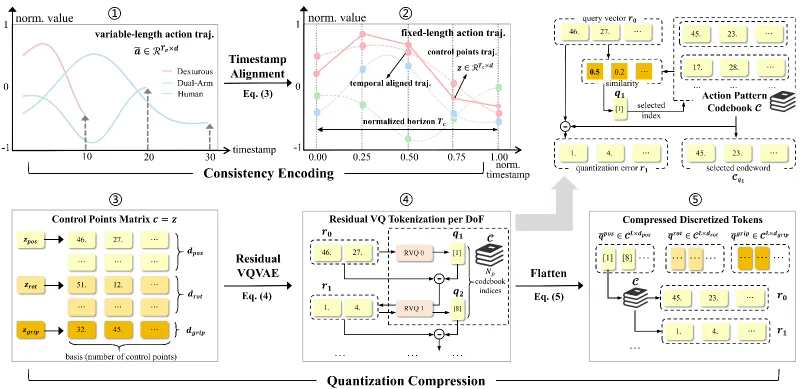

统一动作空间:设计了一个通用的动作词汇表(Unified Action Vocabulary, UAV),将不同机器人的控制指令映射到一个共享的语义空间中。

动作令牌化:使用先进的动作令牌器(OmniSAT)将连续的控制信号转换为离散的动作令牌,便于模型处理和跨平台迁移。

跨模态理解:能够处理多种输入类型,包括图像、文本和传感器数据,实现对复杂环境的全面感知。

任务分解能力:通过分组残差量化器(GRVQ)将复杂任务自动分解为可执行的子任务序列。

该项目的核心理念是创建一个"通用机器人大脑",能够理解各种任务需求,并为不同硬件平台生成合适的执行指令。

2. 功能特色

RoboBrain-X0 具有以下主要功能特色:

| 功能特色 | 描述 | 优势 |

|---|---|---|

| 跨实体统一建模 | 支持多种机器人平台的统一控制逻辑,包括AgileX、R1-Lite、Franka等 | 减少开发成本,提高代码复用率 |

| 多模态输入处理 | 接受图像、文本、传感器数据等多种输入类型 | 全面理解环境和任务需求 |

| 零样本泛化能力 | 无需针对新机器人平台重新训练,即可实现技能迁移 | 显著降低部署成本 |

| 复杂任务分解 | 自动将高级任务分解为低级可执行动作序列 | 提高任务执行成功率 |

| 高效动作生成 | 通过动作令牌器生成精确的控制指令 | 保证执行精度和稳定性 |

| 灵活部署选项 | 支持Docker容器化部署和GPU加速 | 简化部署流程,提高性能 |

2.1 跨实体统一建模

RoboBrain-X0 的核心优势在于其跨实体建模能力。通过统一的动作词汇表,不同机器人平台的控制指令被映射到相同的语义空间中。这意味着一个为Franka机械臂开发的任务模型,经过适当的映射后,可以直接应用于R1-Lite双臂机器人。

这种统一建模方法大大减少了开发人员的工作量,他们只需关注任务逻辑的实现,而无需为每个机器人平台编写特定的控制代码。

2.2 多模态输入处理

RoboBrain-X0 能够处理多种输入类型,包括:

视觉输入:单张图像、多张图像、视频流

文本输入:任务描述、指令

传感器数据:深度信息、力反馈、位置信息

这种多模态理解能力使机器人能够更全面地感知环境,理解复杂的任务需求。例如,系统可以同时处理"拿起红色杯子"的文本指令和包含红色杯子的图像,从而更准确地执行任务。

2.3 零样本泛化能力

RoboBrain-X0 最引人注目的特性是其零样本泛化能力。传统的机器人学习方法需要在目标机器人上进行大量的训练才能适应新环境,而RoboBrain-X0通过其独特的动作令牌化技术,能够将已学习的技能直接迁移到新的机器人平台上,无需重新训练。

这种能力不仅节省了大量的训练时间和资源,还使得机器人能够快速适应新环境和新任务。

2.4 复杂任务分解

在复杂环境中,机器人需要执行的任务往往无法通过单一动作完成。RoboBrain-X0 能够自动将高级任务分解为一系列低级动作。例如,"准备一杯咖啡"这个任务会被分解为:找到咖啡机、拿起杯子、放置杯子、启动咖啡机等子任务。

这种任务分解能力大大提高了机器人处理复杂任务的能力,使其能够在真实世界中执行有意义的操作。

3. 技术细节

3.1 系统架构

RoboBrain-X0 的系统架构主要包括以下几个核心组件:

输入处理模块:负责接收和预处理各种输入数据,包括图像、文本和传感器信息。

感知理解模块:使用深度学习模型对输入数据进行分析和理解,提取关键信息。

任务规划模块:基于感知结果和任务目标,生成高层次的任务计划。

动作生成模块:将任务计划转换为具体的动作序列。

动作令牌化模块:使用OmniSAT动作令牌器将连续控制信号转换为离散令牌。

平台适配模块:将通用动作令牌映射到特定机器人平台的控制指令。

执行监控模块:监控任务执行过程,处理异常情况。

3.2 核心算法

3.2.1 分组残差量化器(GRVQ)

GRVQ 是 RoboBrain-X0 的核心组件,负责将不同自由度和机械结构的连续控制序列映射到共享的离散动作原语空间。它通过以下步骤实现:

将连续控制信号分解为多个残差组

对每个残差组进行量化处理

生成离散的动作令牌序列

这种方法确保了在不同机器人平台间的语义一致性和迁移性。

3.2.2 OmniSAT 动作令牌器

OmniSAT 负责将模型输出的动作令牌序列转换为底层机器人控制信号。它具有以下特点:

支持多种机器人平台的动作空间

能够处理不同维度和类型的控制信号

提供平滑的动作过渡,确保机器人运动的稳定性

3.2.3 多模态融合技术

RoboBrain-X0 使用先进的多模态融合技术,能够有效地结合视觉、文本和传感器信息。这包括:

跨注意力机制,用于关联不同模态的信息

自适应权重调整,根据输入数据的可靠性分配不同权重

上下文感知编码,确保模型理解任务的上下文信息

3.3 支持的机器人平台

RoboBrain-X0 目前支持以下机器人平台:

AgileX:移动机器人平台

R1-Lite:双臂轮式机器人(支持ROS1和ROS2)

Franka:单臂协作机器人

A2D:双臂机器人系统

每个平台都有专门的客户端和服务器代码,确保与硬件的无缝集成。

4. 应用场景

RoboBrain-X0 的设计使其适用于多种机器人应用场景:

4.1 工业自动化

在工业环境中,RoboBrain-X0 可以用于:

自动化装配线操作

物料搬运和分类

质量检测和监控

其跨平台能力意味着工厂可以使用统一的控制系统管理不同类型的机器人,提高生产效率和灵活性。

4.2 服务机器人

在服务行业,RoboBrain-X0 可应用于:

餐厅和酒店服务

医疗辅助

家庭助理

多模态理解能力使机器人能够理解自然语言指令,并通过视觉识别环境中的物体和人。

4.3 科研教育

RoboBrain-X0 为机器人研究和教育提供了理想平台:

研究人员可以专注于算法开发,而无需关注硬件细节

学生可以学习机器人编程和人工智能,而不必购买昂贵的专用设备

教育机构可以建立共享的机器人资源库

4.4 应急响应

在紧急情况下,RoboBrain-X0 可以部署在各种机器人平台上执行危险任务:

灾难现场搜救

危险环境探测

应急物资运输

零样本泛化能力意味着可以快速将现有机器人改造成应急响应工具。

5. 使用方法

5.1 环境准备

RoboBrain-X0 需要以下环境:

Python 3.8+

CUDA 11.0+(推荐)

ROS 1或ROS 2(根据机器人平台选择)

必要的Python库(见requirements.txt)

5.2 安装步骤

克隆仓库

git clone https://github.com/FlagOpen/RoboBrain-X0.git cd RoboBrain-X0

安装依赖

pip install -r requirements.txt

配置机器人平台 根据使用的机器人平台,修改相应的配置文件:

franka/config.yaml

a2d/config.yaml

agilex/config.yaml

r1literos1/config.yaml 或 r1literos2/config.yaml

启动服务器 根据机器人平台选择相应的服务器脚本:

# For Franka python franka/server_franka.py # For A2D python a2d/server_a2d.py # For AgileX python agilex/server_agilex.py # For R1-Lite (ROS1) python r1lite_ros1/server_r1lite.py # For R1-Lite (ROS2) python r1lite_ros2/server_r1lite.py

运行客户端示例

python examples/basic_example.py

5.3 基本使用流程

初始化机器人客户端

from franka.client_franka import FrankaClient client = FrankaClient()

加载任务模型

client.load_model("pick_and_place")设置任务目标

# 可以是文本指令、图像或两者结合 client.set_goal(text="pick up the red cup", image=cup_image)

执行任务

client.execute_task()

监控执行过程

status = client.get_status()

print(f"Task status: {status}")

6. 常见问题解答

Q1: RoboBrain-X0 支持哪些操作系统?

A1: 目前主要支持 Ubuntu 20.04 和 22.04,其他Linux发行版可能需要额外配置。

Q2: 是否需要GPU才能运行RoboBrain-X0?

A2: GPU不是必需的,但强烈推荐使用,特别是对于视觉处理和复杂任务规划。在CPU上运行会显著降低性能。

Q3: 如何为新的机器人平台添加支持?

A3: 需要实现三个主要组件:

机器人客户端(与硬件通信)

平台适配器(将通用动作令牌转换为硬件特定指令)

配置文件(定义机器人参数和能力)

详细指南请参考项目文档中的"Adding New Robot Platform"部分。

Q4: RoboBrain-X0 可以在没有网络连接的情况下运行吗?

A4: 是的,所有核心功能都可以离线运行。但某些高级功能(如模型下载、在线更新)需要网络连接。

Q5: 如何评估 RoboBrain-X0 在特定任务上的性能?

A5: 项目提供了评估工具,可以测量任务成功率、执行时间和资源消耗等指标。使用方法:

python evaluation/run_evaluation.py --task pick_and_place --robot franka

7. 相关链接

FlagOpen官方网站:https://flagopen.ai/

8. 总结

RoboBrain-X0 是一个革命性的跨实体机器人智能框架,它通过统一动作空间和先进的动作令牌化技术,实现了不同机器人平台间的高效知识迁移。该项目支持多种机器人平台,能够处理多模态输入,并自动分解复杂任务为可执行的动作序列。其零样本泛化能力显著降低了部署成本,使其成为工业自动化、服务机器人、科研教育和应急响应等领域的理想选择。通过提供详细的文档和示例代码,FlagOpen 团队为开发者和研究人员提供了一个易于使用且功能强大的工具,有望推动机器人智能的发展和应用。

版权及免责申明:本文由@AI铺子原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/robobrain-x0.html