一文读懂 NSA:什么是 Native Sparse Attention(原生稀疏注意力)?

深度解析原生稀疏注意力机制(NSA)。本文详细阐述NSA的动态分层稀疏策略、三大核心分支(压缩/选择/滑动窗口)及其硬件对齐原理,揭示其如何实现训练与推理的端到端加速,...

深度解析原生稀疏注意力机制(NSA)。本文详细阐述NSA的动态分层稀疏策略、三大核心分支(压缩/选择/滑动窗口)及其硬件对齐原理,揭示其如何实现训练与推理的端到端加速,...

本文深度解析谷歌最新提出的嵌套学习(Nested Learning)范式。作为Transformer的潜在替代者,嵌套学习通过将模型视为一组嵌套的优化问题,结合连续体内存系统(CMS),彻底...

深度解析Transformer架构原理及其在AI领域的核心地位。本文从定义、架构、数学原理到应用场景,详细阐述为何Transformer成为现代人工智能的基石,是学习AI不可绕开的必经之...

D4RT是由Google DeepMind主导开发的开源4D重建与跟踪框架,核心是通过一套统一架构,从普通2D视频中精准还原动态场景的3D几何结构与时间维度的运动轨迹(即4D建模)。该框架...

本文围绕欠拟合这一机器学习与深度学习中的关键概念展开详细探讨。首先明确欠拟合的定义,通过直观示例帮助读者理解其本质。接着深入剖析造成欠拟合的主要原因,涵盖模型复...

近日,摩尔线程正式推出PyTorch深度学习框架的MUSA扩展库——Torch-MUSA v2.7.0。该版本在功能集成、性能优化及硬件支持方面实现突破性进展,延续了v2.5.0至v2.7.0仅一个月...

本文深入探讨了机器学习与深度学习领域中过拟合的概念,详细分析了造成过拟合现象的主要原因,包括数据层面、模型复杂度层面以及训练过程层面等因素。同时,针对这些原因,...

模型剪枝(Model Pruning)作为一种经典的模型压缩技术,通过移除神经网络中冗余的权重或结构,在保持模型性能的同时显著降低计算和存储开销。本文AI铺子将从剪枝的基本原理...

在深度学习领域,我们常听到微调这个关键词。微调(Fine-tuning)的核心逻辑,就是让这个“通才”通过少量特定任务数据的学习,快速适应新任务,成为“专才”。这一过程无需...

语义分割是计算机视觉领域的核心任务,RGB-D数据(RGB图像与深度图)的融合为语义分割提供了多模态信息,通过结合颜色、纹理与几何结构,显著提升了分割精度。本文系统梳理...

Real-Time-Voice-Cloning 是一个基于深度学习的开源语音克隆框架,能够通过几秒钟的音频样本克隆说话人的声音,并基于任意文本生成该说话人的语音。该项目实现了 SV2TTS架构...

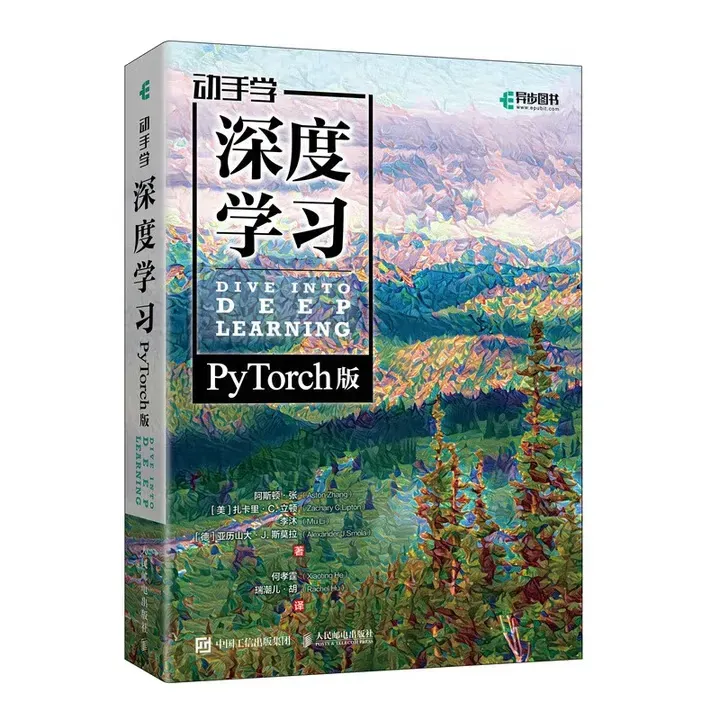

《动手学深度学习PyTorch版》是深度学习领域重磅作品《动手学深度学习》的升级版本,本书由李沐、阿斯顿·张等领域权威专家联合撰写,全球已有400多所大学将其作为教材使用...

深度学习(Deep Learning)是人工智能(AI)领域最热门的分支之一,它让计算机能够像人类一样“学习”复杂模式,并在图像识别、语音翻译、自动驾驶等领域取得突破性成果。本...