Ctrl-World:清华斯坦福联合开源的可控生成式世界模型,精准驱动机器人操控与虚拟预演

一、Ctrl-World是什么

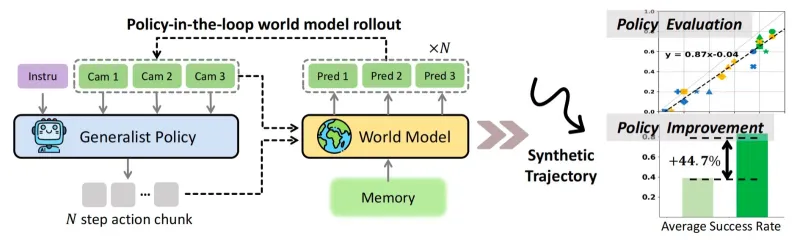

Ctrl-World是由清华大学陈建宇团队与斯坦福大学Chelsea Finn团队联合开源的可控生成式机器人操控世界模型,它是一个动作条件驱动的视频世界模型,核心定位是为机器人提供高保真、物理合理、可精细控制的虚拟交互环境,让机器人在“想象空间”里完成训练、评估与优化。

简单来说,Ctrl-World就像机器人的虚拟彩排室:不需要真实机械臂、不需要真实场景、不需要反复真机试错,只需输入初始观测与动作序列,就能生成连续、多视角、符合物理规律的机器人操作视频,精准预测“执行某动作后会发生什么”,并基于虚拟结果直接优化机器人策略。

它的核心使命是解决机器人学习领域三大痛点:

真机训练成本极高:硬件损耗、安全风险、时间成本、人力成本居高不下。

数据获取困难:真实轨迹采集慢、标注贵、场景覆盖有限,泛化能力差。

策略评估低效:传统评估必须大量真机滚动,周期长、难以规模化。

Ctrl-World通过生成式模拟替代部分真实试验,实现“虚拟评估→虚拟优化→真机落地”的全新流程,在权威评测平台World Arena中,具身任务能力全球第一、视频生成质量全球第二,是当前具身智能与世界模型领域的顶尖开源方案。

该项目完全开源,提供完整训练、推理、交互代码,支持复现论文实验、自定义场景扩展、与主流VLA(Vision-Language-Action)机器人策略对接,面向学术研究、工业开发、机器人产品落地全场景使用。

二、功能特色

Ctrl-World围绕“可控、真实、高效、兼容”四大核心设计目标,具备六大突出功能特色:

1. 动作条件精准控制,物理交互真实可信

以机器人关节角度、末端位姿、夹爪开合度等底层动作参数为生成条件。

强制模型学习“动作→状态变化→视觉变化”的因果链,避免物体穿透、瞬移、隔空吸附等幻觉。

交互精度达厘米级,微小动作差异会产生明显不同的视觉结果,物理一致性行业领先。

2. 多视角联合预测,全景感知无死角

同时处理外部全景视角、腕部第一视角、右侧视角三路视频。

多视图帧令牌拼接联合预测,隐式建模深度与3D结构,深度预测准确率达91.58%。

生成结果全局一致,不会出现不同视角间的物体位置矛盾。

3. 长时序稳定生成,支持超20秒连续推演

创新姿态条件记忆检索机制,定时回溯历史状态校准轨迹。

在新场景与新相机位姿下,可生成超过20秒空间与时间双一致的稳定视频。

解决传统世界模型短时漂移、长序列崩坏问题。

4. 全流程策略优化,零真机数据提升成功率

支持虚拟环境内策略滚动评估,精准排序策略优劣,与真机结果高度对齐。

可批量生成成功合成轨迹,用于策略监督微调,平均提升任务成功率44.7%。

新物体抓取、形状理解、毛巾折叠等任务均有显著增益。

5. 多模式交互生成,灵活适配开发需求

轨迹重放模式:复现数据集动作,生成对应合成视频。

键盘交互模式:手动控制机器人前后左右、上下、夹爪开合,实时生成交互结果。

VLA策略对接模式:兼容π₀.₅等主流视觉-语言-动作模型,闭环生成合成轨迹。

6. 开源开箱即用,完整工程化配套

提供一键环境配置、训练脚本、推理脚本、可视化工具。

基于PyTorch实现,兼容主流GPU,支持单卡推理与训练。

配套DROID数据集处理流程、模型权重加载、结果保存与评估工具。

核心性能指标对比

| 指标 | Ctrl-World | 传统模型WPE | 传统模型IRASim | 提升幅度 |

|---|---|---|---|---|

| PSNR(像素相似度) | 23.56 | 20.33 | 21.36 | +15.8% |

| SSIM(结构一致性) | 0.828 | 0.772 | 0.774 | +7.2% |

| LPIPS(视觉感知) | 0.091 | 0.131 | 0.117 | -30.5% |

| FVD(视频保真度) | 97.4 | 156.4 | 138.3 | -37.7% |

三、技术细节

1. 整体技术架构

Ctrl-World以预训练Stable Video Diffusion(SVD)为基座,参数量约1.5B,经过机器人操控任务专属微调,形成动作条件可控世界模型。整体架构分为四层:

输入层:初始RGB观测、多视角相机参数、动作序列、文本指令。

编码层:CLIP图像/文本编码器提取特征;动作编码器编码连续动作参数。

核心生成层:SVD UNet + 动作条件注入 + 多视角融合 + 姿态记忆检索。

输出层:多视角连续视频、深度图、3D点云、轨迹评估结果。

2. 三大核心技术创新

(1)帧级动作条件注入

将动作参数在每一步生成中显式注入扩散过程。

动作与视觉帧强绑定,保证“动作文理一致”。

支持1秒动作片段输入,自回归滚动生成长视频。

(2)多视角联合预测模块

三路视频特征沿令牌维度拼接,统一建模。

共享空间表示,避免视角间矛盾,提升深度感知能力。

输出6宫格可视化画面(上排真值,下排预测),直观对比效果。

(3)姿态条件记忆检索

以机器人姿态为检索条件,定期从历史帧抽取关键信息校准。

抑制长时序漂移,维持物体身份、位置、形状稳定。

最优历史窗口约6秒,兼顾精度与效率。

3. 训练与数据体系

训练数据:DROID数据集,95k轨迹、564场景、370G规模。

训练目标:视频重构损失、动作一致性损失、多视角一致性损失联合优化。

推理范式:自回归生成,每步输入1秒动作,输出对应视觉变化。

4. 运行资源要求

GPU显存:≥24GB(bfloat16推理),推荐32GB以上。

磁盘空间:模型权重约20GB(Hugging Face缓存)。

推理速度:A100单步约10秒;H100单步约5秒。

四、应用场景

Ctrl-World可广泛应用于机器人研发、工业自动化、家庭服务、学术研究等领域,核心场景包括:

1. 机器人策略虚拟训练与评估

替代真机滚动,快速评估VLA、强化学习策略效果。

排序策略优劣,筛选最优模型,缩短开发周期90%。

2. 合成数据生成与数据增强

批量生成物理合理、多视角、多样化交互轨迹。

缓解真实数据不足、标注昂贵、分布不均问题。

3. 工业机械臂快速部署

产线调试从1周缩短至1天,降低硬件损耗与安全风险。

支持装配、分拣、堆叠、包装等典型工业任务预演。

4. 服务机器人技能泛化

厨房操作、物品整理、异形物体抓取等家用场景虚拟训练。

快速泛化到新物体、新环境,提升落地实用性。

5. 具身智能算法研究

世界模型、强化学习、模仿学习、VLA策略的标准化测试平台。

支持新算法快速验证、对比、论文复现。

6. 数字孪生与仿真验证

构建高保真机器人操作数字孪生系统。

用于极端环境、危险场景、高精度任务的安全验证。

五、使用方法

1. 环境准备

# 创建conda环境 conda create -n ctrl-world python=3.11 conda activate ctrl-world # 安装依赖 pip install -r requirements.txt # (可选)对接π₀.₅策略 git clone --recurse-submodules git@github.com:Physical-Intelligence/openpi.git cd openpi pip install uv GIT_LFS_SKIP_SMUDGE=1 uv sync GIT_LFS_SKIP_SMUDGE=1 uv pip install -e .

2. 模型与数据准备

自动下载:SVD、CLIP、Ctrl-World权重(Hugging Face)。

数据集:使用项目提供的

dataset_example小样本,或下载完整DROID数据集。

3. 核心使用方式

(1)轨迹重放推理

从数据集采样初始帧,重放动作生成合成轨迹:

CUDA_VISIBLE_DEVICES=0 python scripts/rollout_replay_traj.py \ --dataset_root_path dataset_example \ --dataset_meta_info_path dataset_meta_info \ --dataset_names droid_subset \ --svd_model_path 路径 \ --clip_model_path 路径 \ --ckpt_path 模型权重路径

(2)键盘交互控制

手动输入指令控制机器人,实时观察虚拟效果:

CUDA_VISIBLE_DEVICES=0 python scripts/rollout_keyboard.py

支持指令:前/后/左/右/上/下、夹爪开合、重置、保存等。

(3)模型训练

CUDA_VISIBLE_DEVICES=0,1,2,3 python train.py

配置文件:config.py,可调整批次、学习率、数据集路径、训练轮数。

4. 结果输出

合成视频保存至

synthetic_traj/。输出6宫格可视化(3视角×真值/预测),帧率4fps。

记录动作序列、评估指标、轨迹元数据。

六、常见问题解答(FAQ)

Ctrl-World只能用于机械臂吗?

目前主要面向机器人操控(机械臂)优化,支持多关节、夹爪式机器人;架构可扩展到移动机器人、人形机器人,但需要对应数据微调。

运行Ctrl-World必须用A100/H100吗?

推荐24GB以上显存GPU,A100、H100、RTX 4090/3090均可推理;训练建议多卡并行。

没有DROID完整数据集可以用吗?

可以,项目自带小样本dataset_example,可用于测试推理、交互、可视化流程。

生成的虚拟轨迹可以直接用于训练真实机器人吗?

可以,合成轨迹物理一致性高、动作精准,可用于策略监督微调,实验证明能显著提升真机成功率。

Ctrl-World支持自定义场景和物体吗?

当前版本基于DROID数据集场景;自定义场景需要收集对应轨迹数据重新训练,项目提供完整训练流程。

动作输入支持什么格式?

支持笛卡尔空间位姿、关节角度、夹爪开合度等连续动作,与主流机器人策略输出格式对齐。

长时序生成最长能到多少秒?

官方测试稳定生成超过20秒;更长序列可通过记忆检索优化实现。

如何评估生成视频的质量?

项目内置PSNR、SSIM、LPIPS、FVD指标;同时提供真值与预测画面对比可视化。

Ctrl-World和传统仿真器(如Gazebo)有什么区别?

传统仿真依赖精确物理引擎与3D模型,配置复杂;Ctrl-World是数据驱动生成式模型,无需手动建模,视觉真实、泛化强、开箱即用。

项目支持二次开发和商业使用吗?

支持,采用MIT开源协议,可自由修改、分发、商用,保留版权声明即可。

七、相关链接

GitHub开源仓库:https://github.com/Robert-gyj/Ctrl-World

论文地址(arXiv):https://arxiv.org/pdf/2510.10125

ICLR 2026 OpenReview:https://openreview.net/forum?id=748bHL2BAv

DROID数据集官网:https://droid-dataset.github.io/

八、总结

Ctrl-World是清华大学与斯坦福大学联合推出的开源可控生成式世界模型,以动作条件为核心、视频扩散为基座、多视角与长时序稳定生成为特色,专为机器人操控任务打造,能够在虚拟环境中精准模拟机器人动作与物理交互结果,实现策略评估、合成数据生成、虚拟训练与性能优化,有效解决真机试错成本高、数据获取难、评估效率低等行业痛点。它在权威评测中位居全球前列,具备物理真实、控制精细、兼容广泛、工程化完善等优势,既可作为具身智能学术研究的标准化平台,也能用于工业机械臂、服务机器人的产品开发与落地,推动机器人学习从“数据驱动”向“模型驱动、虚拟优先”的范式升级,是当前世界模型与具身智能领域极具实用价值与前沿性的开源项目。

版权及免责申明:本文由@AI工具箱原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/ctrl-world.html