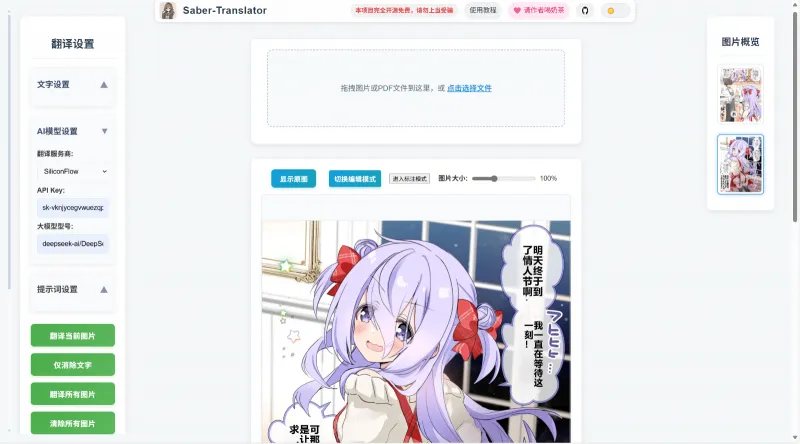

Saber-Translator:一款集检测、识别、翻译、编辑于一体的漫画/图像翻译工具

一、Saber-Translator 是什么

Saber-Translator是一款开源的一站式 AI 漫画翻译与编辑工具,支持从图像/PDF导入、文本区域检测、多引擎OCR识别、AI翻译到图像修复和文本渲染的全流程处理。该工具集成了多种先进技术,提供灵活的手动编辑功能和高度可定制的输出选项,适用于漫画爱好者、翻译团队和内容创作者,旨在简化漫画本地化流程,提升翻译效率与质量。

Saber-Translator 基于 Python 和 Web 技术开发,旨在为用户提供从内容导入到最终输出的全流程解决方案。无论是个人漫画爱好者、专业翻译团队还是内容创作者,都可以通过该工具快速完成图像中的文本检测、识别、翻译和编辑,实现漫画的本地化或二次创作。

传统的漫画翻译流程通常需要多个工具配合,如使用图像编辑软件裁剪文本区域、借助在线OCR工具识别文字、通过翻译平台获取译文,最后再手动将文字放回图像中,步骤繁琐且效率低下。Saber-Translator 则通过整合先进的 AI 技术和人性化的编辑界面,将这些步骤集成到一个统一的平台中,用户无需切换多个工具即可完成整个翻译流程,大大提升了工作效率。

该项目开源且免费,基于 GPL3.0 许可证,用户可以自由使用、修改和分发代码,同时支持插件扩展,允许开发者根据需求添加新功能或集成新的 AI 模型,具有高度的灵活性和可扩展性。

二、功能特色

Saber-Translator 拥有丰富的功能模块,涵盖了漫画翻译的全流程,以下是其核心功能特色的详细介绍:

2.1 灵活的源文件处理

支持多种输入格式,包括 JPG、PNG、WEBP 等常见图像格式以及 PDF 漫画文件。用户可以通过拖拽方式快速上传文件,对于 PDF 文件,工具会自动提取其中的图像并按页展示,方便用户进行批量处理。

2.2 精准的文本区域检测与手动编辑

文本区域检测是漫画翻译的关键步骤,Saber-Translator 采用自训练的 YOLOv5 模型,能够自动、精准地识别漫画中的对话气泡和文本区域。同时,考虑到自动检测可能存在的误差,工具提供了强大的手动编辑功能:

用户可以手动绘制文本框,精准框选未被检测到的文本区域;

支持拖拽文本框调整位置,或通过控制点精细调整文本框的大小和形状;

可以删除误检测的文本框,确保后续处理的准确性;

提供批量检测功能,一键检测当前图片中的所有文本区域,提升处理效率。

2.3 多引擎、多语言 OCR 支持

OCR(光学字符识别)是将图像中的文本转换为可编辑文本的过程,Saber-Translator 集成了多种主流 OCR 引擎,以适应不同语言和场景的需求:

| OCR 引擎 | 特点 | 适用场景 |

|---|---|---|

| MangaOCR | 专为日语漫画优化,识别准确率高 | 日语漫画翻译 |

| PaddleOCR | 多语言通用,支持中文、英文、韩语等 | 多语言漫画或图像翻译 |

| 百度OCR | 需 API Key,支持多语言,识别速度快 | 对识别速度有要求的场景 |

| AI 视觉 OCR | 支持 SiliconFlow、火山引擎、Google Gemini 等 | 需自定义服务或特定语言支持 |

用户可以根据实际需求手动选择 OCR 引擎,也可以设置为自动选择,工具会根据文本内容和语言类型自动匹配最优引擎。

2.4 多样化的 AI 翻译引擎

翻译模块是 Saber-Translator 的核心,支持多种 AI 翻译引擎,包括云服务 API 和本地部署模型:

云服务 API:集成 SiliconFlow、DeepSeek、火山引擎等主流 AI 服务,用户需配置相应的 API Key 即可使用,翻译速度快且支持多语言;

本地部署模型:支持 Ollama、Sakura 等本地大模型,用户无需联网即可完成翻译,保护数据隐私;

自定义服务:支持对接 OpenAI 兼容服务,用户可以根据需求选择自定义的翻译接口。

此外,工具还支持自定义提示词(含 JSON 格式),用户可以通过优化提示词提升翻译质量,同时提供 RPM(每分钟请求数)控制,避免因请求过快导致 API 限制。

2.5 高效的图像修复与背景填充

在翻译过程中,需要先将原文本从图像中消除,再添加翻译后的文本。Saber-Translator 提供两种图像修复方式:

纯色填充:适用于简单背景,直接用背景色覆盖原文本区域,操作快速;

LAMA 智能修复:基于 AI 的图像修复技术,能够自动识别背景内容并进行无痕填充,修复效果自然,适用于复杂背景或细节丰富的图像。

2.6 高度可定制的文本渲染

文本渲染直接影响最终输出效果,Saber-Translator 提供了丰富的自定义选项:

字体定制:支持上传.ttf、.ttc、.otf 格式的字体文件,用户可以根据漫画风格选择合适的字体;

字号调整:支持手动设置字号或自动计算字号,确保文本与气泡大小匹配;

排版方向:支持横排和竖排两种排版方式,适配不同语言的阅读习惯;

文本样式:可自定义文本颜色、加粗、倾斜等样式,同时支持设置文本的旋转角度和像素级位置偏移;

批量应用:支持将单个气泡的样式设置应用到所有气泡,提升编辑效率。

2.7 精细化编辑与实时预览

工具采用所见即所得的编辑模式,用户可以实时预览翻译和编辑效果:

支持单气泡独立编辑,用户可以单独修改每个气泡的文本内容、字体、颜色等;

提供缩略图导航功能,方便用户快速切换图片;

编辑过程中,所有修改都会实时更新到预览窗口,用户可以随时调整并查看效果。

2.8 会话管理功能

为了方便用户进行多文件或多轮次编辑,Saber-Translator 提供会话管理功能:

支持会话保存、加载、重命名和删除,用户可以随时中断并恢复工作;

自动存档关键操作状态,避免因意外情况导致数据丢失;

会话文件包含图像数据和编辑元数据,确保编辑过程的连续性。

2.9 高质量翻译模式(Beta)

针对对翻译质量有更高要求的用户,工具提供高质量翻译模式:

结合多图上下文信息,提升翻译的连贯性和准确性;

支持提示工程,用户可以通过优化提示词进一步提升翻译效果;

提供批处理配置,支持设置处理大小、RPM 限制等参数,适用于批量处理场景。

三、技术细节

3.1 技术栈

Saber-Translator 采用前后端分离的架构,技术栈如下:

| 模块 | 技术选型 | 作用 |

|---|---|---|

| 后端 | Python 3.10+ | 核心逻辑处理,包括模型调用、文件处理、API 交互等 |

| Flask | Web 框架,提供后端接口服务 | |

| PyTorch | 深度学习框架,支持 YOLOv5、LAMA 等模型的运行 | |

| PaddlePaddle-OCR | 集成 PaddleOCR 引擎,实现多语言文本识别 | |

| MangaOCR | 日语漫画专用 OCR 引擎 | |

| OpenCV | 图像处理库,用于图像预处理、文本区域检测等 | |

| 前端 | HTML5/CSS3 | 页面结构和样式设计 |

| JavaScript (ES6) | 前端交互逻辑实现 | |

| jQuery | 简化 DOM 操作和事件处理 | |

| JSZip | 用于文件压缩和导出 | |

| 打包 | PyInstaller | 将 Python 代码打包为可执行文件,方便用户部署和使用 |

3.2 核心技术实现

3.2.1 文本区域检测

文本区域检测基于 YOLOv5 模型,该模型是一种轻量级、高精度的目标检测算法。项目通过自训练的数据集对 YOLOv5 进行微调,使其能够准确识别漫画中的对话气泡和文本区域。检测流程如下:

对输入图像进行预处理,包括缩放、归一化等操作;

将预处理后的图像输入 YOLOv5 模型,得到文本区域的边界框坐标;

对检测结果进行后处理,过滤掉无效的边界框,确保检测准确性;

将检测到的文本区域展示在前端界面,供用户进一步编辑。

3.2.2 OCR 识别

OCR 识别模块集成了多种引擎,通过统一的接口调用不同的 OCR 服务。以 MangaOCR 为例,其调用流程如下:

根据用户选择的 OCR 引擎,构建相应的调用参数;

对检测到的文本区域图像进行裁剪和预处理;

调用 OCR 引擎的 API 或本地模型,获取识别结果;

将识别结果返回给前端,并存储在会话数据中。

3.2.3 AI 翻译

翻译模块支持多种 AI 引擎,通过封装不同的 API 接口实现统一调用。以云服务 API 为例,调用流程如下:

用户配置 API Key 和相关参数(如模型名称、温度值等);

将 OCR 识别结果作为输入文本,构建翻译请求;

调用云服务 API,发送翻译请求;

接收翻译结果,进行格式处理后返回给前端。

对于本地部署模型(如 Ollama),则通过本地 API 调用模型进行翻译,无需联网,保护数据隐私。

3.2.4 图像修复

图像修复模块提供两种方式,其中 LAMA 智能修复是核心技术:

LAMA(Large Mask Inpainting)是一种基于 Transformer 的图像修复模型,能够处理大面积的图像缺失;

对于检测到的文本区域,生成相应的掩码(mask),标记需要修复的区域;

将原图和掩码输入 LAMA 模型,模型自动预测缺失区域的内容并进行填充;

输出修复后的图像,用于后续的文本渲染。

3.2.5 文本渲染

文本渲染模块基于 PIL(Pillow)库实现,支持多种自定义选项:

根据用户设置的字体、字号、颜色等参数,创建文本绘制对象;

计算文本在气泡中的位置,考虑排版方向(横排/竖排)、对齐方式等;

将文本绘制到修复后的图像上,生成最终的翻译图像;

支持实时预览,用户可以调整参数并立即查看效果。

3.3 架构设计

Saber-Translator 的架构分为前端和后端两部分,通过 HTTP 接口进行通信:

前端:负责用户交互和界面展示,包括文件上传、文本区域编辑、参数配置、实时预览等功能;

后端:负责核心业务逻辑处理,包括文件解析、文本检测、OCR 识别、AI 翻译、图像修复、文本渲染等功能;

数据存储:会话数据存储在本地,包括图像数据、编辑元数据等,用户可以随时保存和加载会话。

四、应用场景

Saber-Translator 适用于多种场景,以下是其主要应用场景的详细介绍:

4.1 个人漫画翻译

对于漫画爱好者来说,Saber-Translator 是一款理想的个人翻译工具。用户可以将喜欢的外语漫画(如日语、英语)上传到工具中,通过自动检测文本区域、OCR 识别和 AI 翻译,快速得到翻译后的漫画。同时,工具提供的手动编辑功能允许用户调整文本框位置、修改译文和优化样式,确保翻译效果符合个人需求。

4.2 专业翻译团队协作

专业漫画翻译团队通常需要处理大量的漫画作品,Saber-Translator 可以显著提升团队的工作效率。团队成员可以通过会话管理功能共享工作进度,批量处理多页漫画,同时利用工具的高质量翻译模式和自定义提示词功能,确保翻译质量的一致性和准确性。此外,插件扩展功能允许团队根据需求集成自定义工具或服务,进一步优化工作流程。

4.3 漫画本地化与二次创作

漫画本地化是将漫画从一种语言转换为另一种语言,并适配目标市场的文化和阅读习惯的过程。Saber-Translator 支持多语言 OCR 和翻译,以及高度可定制的文本渲染功能,用户可以根据目标市场的需求调整字体、排版和文本样式,实现漫画的本地化。同时,工具的图像修复功能可以帮助用户去除原文本,为二次创作提供干净的图像素材。

4.4 教育与研究

在教育领域,Saber-Translator 可以作为一种辅助工具,帮助学生学习外语漫画中的词汇和语法。教师可以利用工具将外语漫画翻译为学生的母语,或者让学生自己动手翻译,提升学习兴趣和语言能力。在研究领域,该工具可以用于漫画文本的数据分析,如统计特定词汇的出现频率、分析漫画的语言风格等。

五、使用方法

5.1 环境准备

Saber-Translator 的运行需要 Python 3.10+ 环境,以下是环境准备的步骤:

安装 Python 3.10+,可从 Python 官网(https://www.python.org/)下载;

克隆或下载项目仓库:https://github.com/MashiroSaber03/Saber-Translator;

进入项目目录,安装依赖包:

pip install -r requirements.txt

部分模型(如 YOLOv5、LAMA)需要单独下载,可根据项目文档的指引进行下载和配置。

5.2 运行方式

Saber-Translator 支持两种运行方式:

5.2.1 直接运行

在项目目录中执行以下命令:

python app.py

然后打开浏览器,访问 http://127.0.0.1:5000,即可进入工具的 Web 界面。

5.2.2 打包运行

对于 Windows 用户,可以使用 PyInstaller 将项目打包为可执行文件:

pyinstaller -w -F app.py

打包完成后,在 dist 目录中找到 app.exe 文件,双击即可运行。

5.3 基本操作流程

以下是使用 Saber-Translator 进行漫画翻译的基本流程:

5.3.1 上传文件

在工具界面中,点击“上传文件”按钮或直接拖拽文件到上传区域,支持 JPG、PNG、WEBP 和 PDF 格式。对于 PDF 文件,工具会自动提取图像并按页展示。

5.3.2 文本区域检测

点击“自动检测”按钮,工具会使用 YOLOv5 模型检测当前图片中的文本区域,并在图像上显示文本框。如果检测结果不准确,可以通过手动绘制、拖拽或删除文本框进行调整。

5.3.3 OCR 识别

选择合适的 OCR 引擎(如 MangaOCR 用于日语),点击“OCR 识别”按钮,工具会将文本区域中的图像转换为可编辑文本,并显示在右侧的文本编辑区。

5.3.4 AI 翻译

选择 AI 翻译引擎(如云服务 API 或本地模型),配置相关参数(如 API Key、提示词等),点击“翻译”按钮,工具会将 OCR 识别结果翻译为目标语言,并自动填充到文本编辑区。

5.3.5 图像修复与文本渲染

选择图像修复方式(纯色填充或 LAMA 智能修复),点击“修复”按钮,工具会消除原文本区域的内容。然后,在文本渲染设置中调整字体、字号、颜色等参数,点击“渲染”按钮,工具会将翻译后的文本添加到修复后的图像上。

5.3.6 预览与导出

在预览窗口中查看最终效果,如有需要可以进一步调整文本框位置或样式。完成编辑后,点击“导出”按钮,选择导出格式(如 ZIP 压缩包),工具会将所有处理后的图像打包下载。

5.4 高级功能使用

5.4.1 自定义 OCR 与翻译引擎

用户可以在“设置”界面中配置自定义的 OCR 或翻译引擎。例如,对于支持 OpenAI 兼容接口的服务,只需输入 API 地址和 Key 即可集成到工具中。

5.4.2 插件扩展

Saber-Translator 支持插件扩展,用户可以在 plugins 目录中添加自定义插件。例如,文本附加器插件可以在翻译文本后自动添加额外信息(如注释、音标等)。

5.4.3 会话管理

点击“会话”按钮,用户可以保存当前的编辑状态,包括图像数据、文本框位置、OCR 结果、翻译内容等。后续可以通过“加载会话”功能恢复工作进度。

六、常见问题解答

6.1 安装依赖时出现错误怎么办?

如果安装依赖包时出现错误,可能是由于网络问题或环境不兼容导致的。可以尝试以下解决方案:

更换国内镜像源:

pip install -r requirements.txt -i https://pypi.tuna.tsinghua.edu.cn/simple

单独安装出错的依赖包,例如:

pip install torch==1.13.1+cu117 -f https://download.pytorch.org/whl/torch_stable.html

检查 Python 版本是否为 3.10+,部分依赖包不支持旧版本 Python。

6.2 文本区域检测不准确怎么办?

如果自动检测的文本区域不准确,可以通过以下方式调整:

手动绘制文本框:点击“手动标注”按钮,在图像上拖拽绘制文本框;

调整文本框大小和位置:选中文本框后,通过控制点调整大小,或直接拖拽移动位置;

删除误检测的文本框:选中不需要的文本框,点击“删除”按钮。

6.3 OCR 识别结果错误较多怎么办?

OCR 识别结果受图像质量、文本清晰度等因素影响,如果错误较多,可以尝试以下方法:

更换 OCR 引擎:例如,日语漫画推荐使用 MangaOCR,中文漫画推荐使用 PaddleOCR;

调整图像预处理参数:在“设置”界面中调整图像的亮度、对比度等参数,提升文本清晰度;

手动修改识别结果:在文本编辑区直接修改错误的识别文本。

6.4 翻译效果不理想怎么办?

翻译效果取决于 AI 引擎和提示词的设置,可以通过以下方式优化:

更换翻译引擎:尝试不同的云服务 API 或本地模型,比较翻译效果;

优化提示词:在“设置”界面中自定义提示词,例如添加“保持漫画风格”“使用口语化表达”等要求;

调整翻译参数:如温度值(temperature),较低的温度值会使翻译结果更稳定,较高的温度值会更具创造性。

6.5 图像修复后有痕迹怎么办?

如果图像修复后仍有痕迹,可以尝试以下方法:

更换修复方式:对于复杂背景,建议使用 LAMA 智能修复,效果比纯色填充更好;

调整修复参数:在“设置”界面中调整 LAMA 模型的参数,如迭代次数、掩码扩展等;

手动修复:使用工具的图像编辑功能,如画笔工具,手动涂抹修复痕迹。

6.6 如何导出多页 PDF 文件?

目前工具支持将处理后的图像导出为 ZIP 压缩包,如需导出为 PDF 文件,可以按照以下步骤操作:

导出所有处理后的图像(JPG/PNG 格式);

使用第三方工具(如 Adobe Acrobat、在线 PDF 转换器)将图像合并为 PDF 文件。

七、相关链接

八、总结

Saber-Translator 是一款功能强大、开源免费的漫画/图像翻译与编辑工具,通过整合先进的 AI 技术(如 YOLOv5 文本检测、多引擎 OCR、AI 翻译、LAMA 图像修复)和人性化的编辑界面,为用户提供了从文件导入到输出的全流程解决方案。该工具支持多种输入格式、多语言识别与翻译,以及高度可定制的文本渲染功能,适用于个人漫画爱好者、专业翻译团队、内容创作者等多种用户群体。无论是漫画本地化、二次创作还是教育研究,Saber-Translator 都能显著提升工作效率,降低操作门槛,是漫画翻译领域的一款优秀开源工具。

版权及免责申明:本文由@人工智能研究所原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/saber-translator.html